最新AIが東大・京大の合格者最高点を大幅に上回る成果を記録

生成AIが難関校合格者最高点を突破

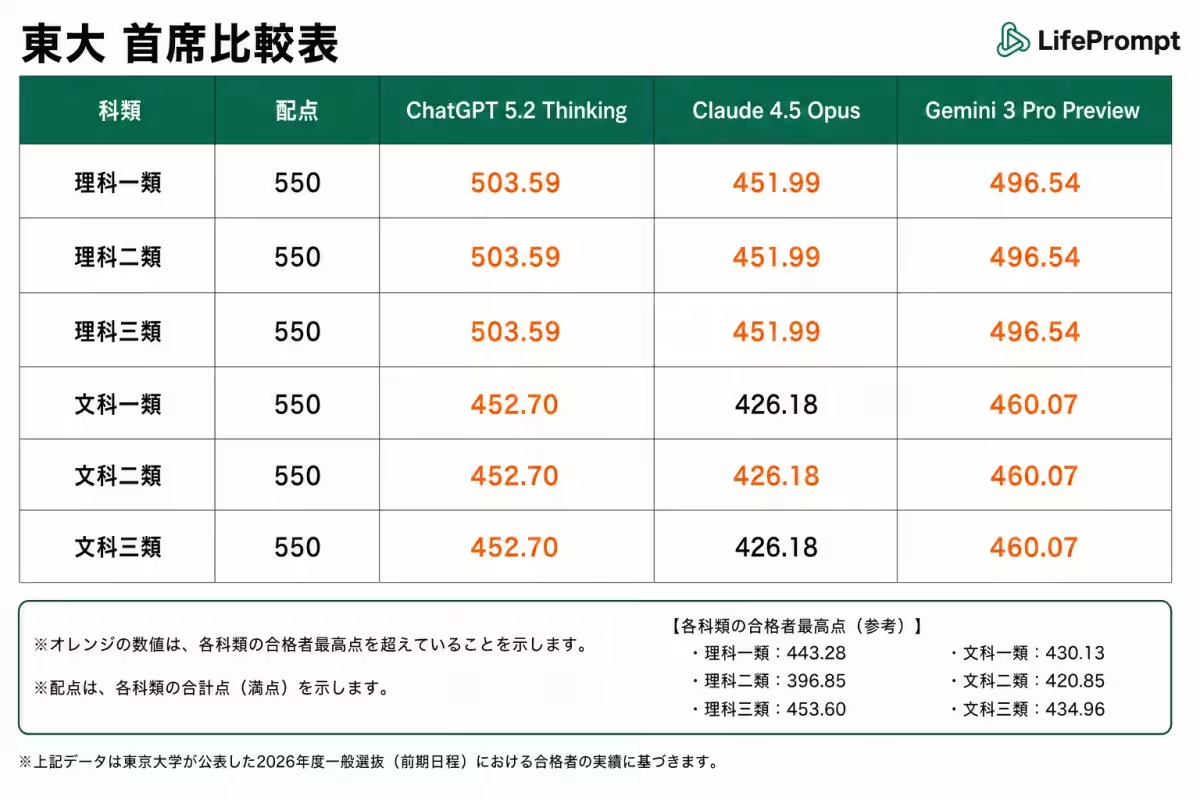

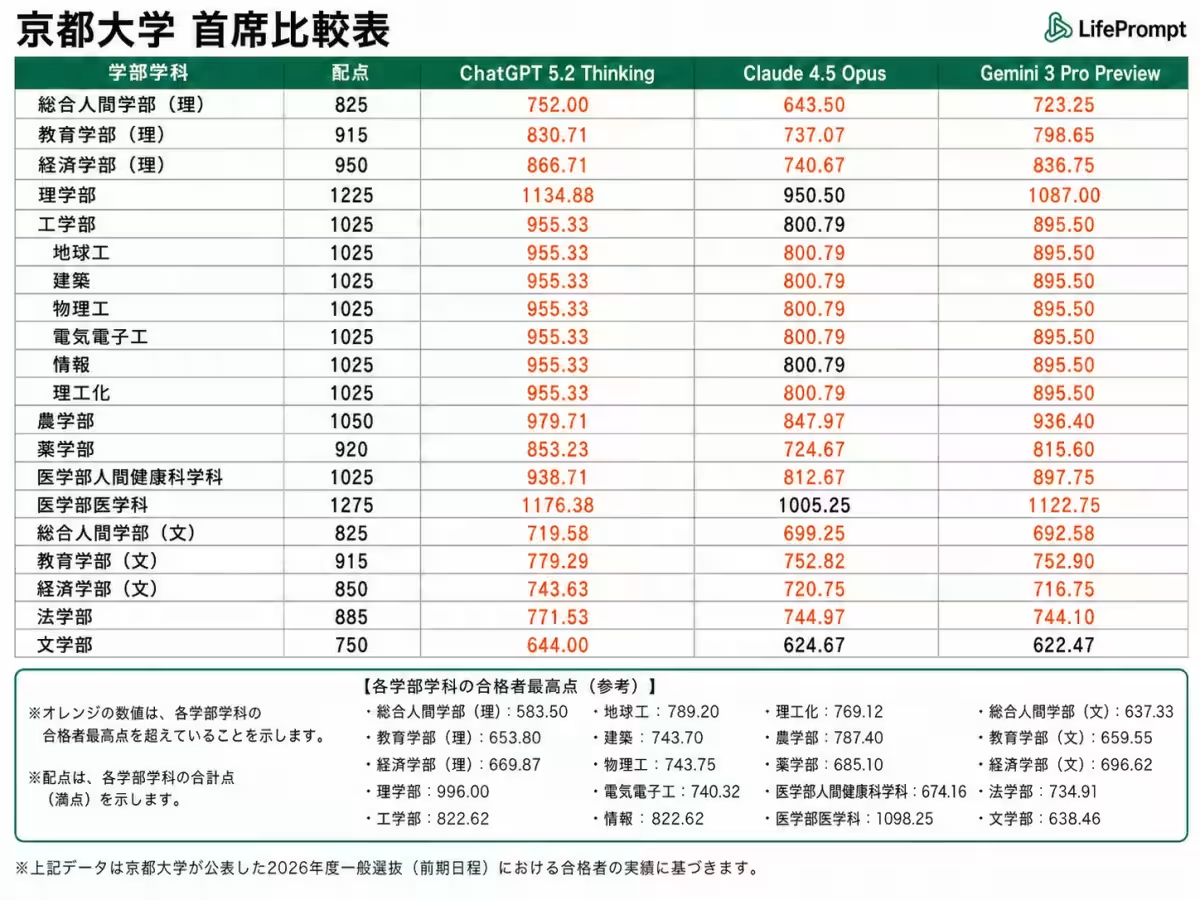

2023年10月、株式会社LifePromptが行った最新の生成AIを用いた大学入試の検証結果が発表されました。この実験では、2026年2月に実施された東京大学と京都大学の二次試験問題に、ChatGPT 5.2 Thinking、Gemini 3 Pro Preview、Claude 4.5 Opusといった生成AIが挑戦しました。その結果、驚くべきことに、これらAIは東京大学および京都大学の合格者最高点を上回る成績を収めたのです。

検証の背景

この検証は、予備校の河合塾の講師や株式会社KIESからの採点協力を得て実施されました。特に注目されたのは、数学において複数の科目で満点をマークしたことです。以下は、各AIモデルの得点と、参考までに合格者最高点です。

東京大学(理科三類)

- - ChatGPT 5.2 Thinking:503.59点

- - Gemini 3 Pro Preview:496.54点

- - Claude 4.5 Opus:451.99点

- - 合格者最高点:453.60点

京都大学(医学部医学科)

- - ChatGPT 5.2 Thinking:1176.38点

- - Gemini 3 Pro Preview:1122.75点

- - Claude 4.5 Opus:1005.25点

- - 合格者最高点:1098.25点

この結果から、特にChatGPTが際立ったパフォーマンスを示したことが分かります。

満点を記録した科目

さらに、以下の科目で満点を記録しました。

- - 東大理系数学(120点):ChatGPT、Gemini

- - 東大文系数学(80点):ChatGPT、Gemini

- - 京大理系数学(200点):ChatGPT、Gemini

- - 京大文系数学(150点):ChatGPT

- - 京大化学(100点):ChatGPT

前年の検証では、東大理系数学のスコアが38点だったことを考えると、わずか1年での劇的な進化を示しています。生成AIが持つ推論能力が、急速に進化していることは明らかです。

検証手法と公平性

今回の検証は、独自に開発された自動受験システムを利用して行われました。具体的な手順は以下の通りです。

- - 入試問題をPDF画像化し、各AIへの送信

- - 直接やり取りを行うことでプライバシーを確保

- - 共通プロンプトを使用し、Web検索を一切使用せずにテスト

- - 河合塾講師による人間受験生と同基準の採点

講師の意見とAIの弱点

採点にあたった河合塾の講師は、一様にAIの実力に驚き、特にChatGPTのパフォーマンスが評価されました。ただし、いくつかの弱点も指摘されました。

- - 画像読み取りに課題:特にClaudeにおいて、構造式やグラフ、地図の認識精度が低下

- - 論文構成力:知識は豊富だが、文章の論理的構成に課題

- - 出力制御の難しさ:指定される字数や物理的制約が守れない場合が多い

- - 慣習依存:英語圏での物理設定が影響、誤りを誘発することも

未来の展望とAIの進化

株式会社LifePromptの代表、遠藤聡志氏は「今回の結果はAIが満点を取れるタスクとそうでないタスクが明確に分かれることを示した」とコメント。特に数学での進化速度は目を見張るものがあります。

「今のAIの限界に合わせた業務運営は賢明ではない。10年後、20年後の視点を持つことが重要」とも語り、長期的な視点でのAI活用を促しています。さらなる進化を見せる生成AIは、今後も教育や様々な分野での役割を担うことでしょう。

さらに詳しく

検証の詳細結果や全分析は、以下のURLで公開されています。

詳細レポート

LifePromptの取り組み

株式会社LifePromptは「志を、自由にする。」というミッションのもと、AIの社会実装に取り組むスタートアップです。AIを単なる業務効率化ツールではなく、「同僚」として迎え入れることを目指し、2026年4月にはAI社員プラットフォーム「AxMates」を正式にローンチする予定です。

- - 会社名:株式会社LifePrompt

- - 所在地:東京都新宿区四谷

- - 設立:2023年5月

- - 代表者:遠藤聡志

- - 事業内容:AI社員プラットフォームの提供、AX推進支援、AI受託開発

- - URL:https://lifeprompt.net/

- - AxMates:https://axmates.com/

本件に関するお問い合わせは、以下までお願いいたします。

E-mail:[email protected]

TEL:03-6899-1960

会社情報

- 会社名

- 株式会社LifePrompt

- 住所

- 東京都新宿区四谷2-2-18VORT四谷9階

- 電話番号

- 03-6899-1960

トピックス(その他)

【記事の利用について】

タイトルと記事文章は、記事のあるページにリンクを張っていただければ、無料で利用できます。

※画像は、利用できませんのでご注意ください。

【リンクついて】

リンクフリーです。