新たに登場したShisa V2シリーズ 日本語特化のバイリンガルLLMを無料公開

次世代バイリンガルLLM「Shisa V2」のリリース

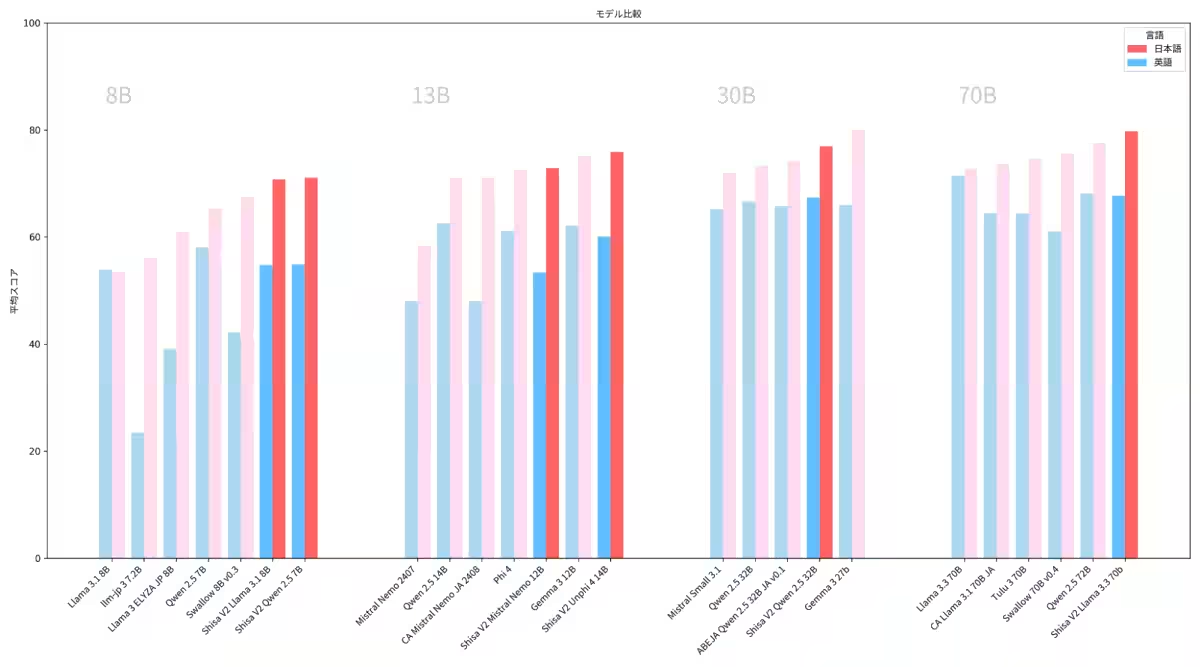

Shisa.AI(本社:東京都港区)は、このたび「Shisa V2」シリーズを正式に発表しました。本シリーズは、日英バイリンガルの汎用チャットモデルであり、日本語に特化した設計が特徴です。業界標準のベンチマークにおいて日本語処理能力で圧倒的な成績をあげており、英語のパフォーマンスもトップクラスを維持しています。特に、コストパフォーマンスに優れた12Bおよび14Bパラメータモデルが新たに追加され、さらに使いやすくなっています。すべてのモデルがApache 2.0やMITライセンスのもとで、HuggingFaceにて無料で利用可能です。

進化したポイント

1. 日本語処理能力の向上

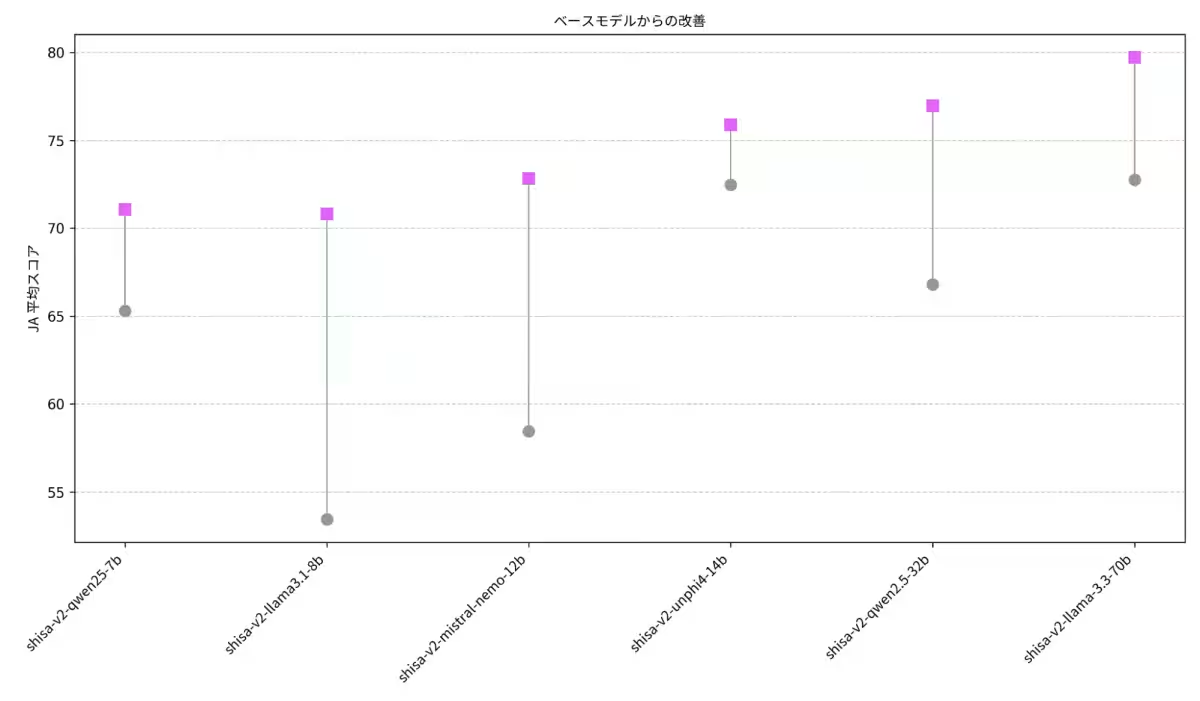

「Shisa V2」は、100万ダウンロードを達成した前のモデル「Shisa V1」と比較して、さらに高性能になりました。業界標準のベンチマークにおいて複数のモデルサイズで1位に輝いており、特に「高コストな事前学習」に頼らず、合成データを駆使した最適化が行われています。これにより、出力の自然さや文脈理解力が大きく向上しました。また、翻訳やロールプレイなど、実用的なアプリケーションにおける性能も向上しています。

2. モデルファミリーの拡充

「Shisa V2」では、7Bから70Bまでの多様なパラメータサイズを展開しています。これにより、日常の業務から専門的なタスクに至るまで、幅広いシーンで活用されることが期待されます。各モデルは、Qwen2.5やLlama3.1などのベースモデルに基づき、日本語処理能力が著しく強化されています。具体的なモデルサイズとそのベンチマーク結果は以下のとおりです。

| モデル名 | パラメータ数 | 日本語ベンチマーク | 英語ベンチマーク |

|---|---|---|---|

| - | - | - | - |

| shisa-v2-qwen2.5-7b | 7B | 71.06 | 54.86 |

| shisa-v2-llama3.1-8b | 8B | 70.83 | 54.75 |

| shisa-v2-mistral-nemo-12b | 12B | 72.83 | 53.33 |

| shisa-v2-unphi4-14b | 14B | 75.89 | 60.10 |

| shisa-v2-qwen2.5-32b | 32B | 76.97 | 67.41 |

| shisa-v2-llama3.3-70b | 70B | 79.72 | 67.71 |

独自ベンチマークの開発

「Shisa V2」は、従来の評価基準だけでなく、実用的なタスクに特化した独自の日本語ベンチマークも開発しています。具体的には、以下の3つのベンチマークを導入しました。

- - shisa-jp-ifeval:日本語の指示追従能力を評価。

- - shisa-jp-rp-bench:ロールプレイ及び複数ターンでの対話能力を評価。

- - shisa-jp-tl-bench:日英翻訳品質を測定。

これらのベンチマークはオープンソースとして公開予定で、日本のAI研究・開発コミュニティに貢献することを目指しています。

Shisa.AIの背景

Shisa.AIはシリコンバレー発の次世代AIスタートアップで、日本語特化のAI技術を持つチームが中心です。シリコンバレーの先端技術と日本の市場に対する深い理解を融合させ、「日本語特化AI」と「データドリブン開発」という2つの柱で進化を続けています。今後、さらなる日本語処理技術の発展を推進し、グローバルなAIイノベーションを発信していく意気込みを持っています。

AKA Virtualとの戦略的提携

また、Shisa.AIは、バーチャルアイドル事業を手がけるAKA Virtualとの戦略的提携を結びました。この提携により、Shisa.AIの言語モデル技術がAKAのAIキャラクターサービス「DE-AI」に統合され、高品質なユーザー体験を提供することを目指しています。

今後の展開が非常に楽しみです。これからもShisa.AIの技術に注目です!

会社情報

- 会社名

- AKA Virtual Inc.

- 住所

- 東京都港区元麻布 3-1-35

- 電話番号

トピックス(IT)

【記事の利用について】

タイトルと記事文章は、記事のあるページにリンクを張っていただければ、無料で利用できます。

※画像は、利用できませんのでご注意ください。

【リンクついて】

リンクフリーです。