大規模言語モデルの新技術がもたらす言語の未来

NTTが切り拓く未来の言語モデル

近年において、大規模言語モデル(LLM)は自然言語処理の分野で著しく進化し、ますます多くの場面での活用が進んでいます。このたび、NTT株式会社が発表した新たな技術により、LLM間の「語彙の壁」を克服する画期的な手法が確立されました。ここでは、具体的な内容とその意義を深掘りしていきます。

新技術の概要

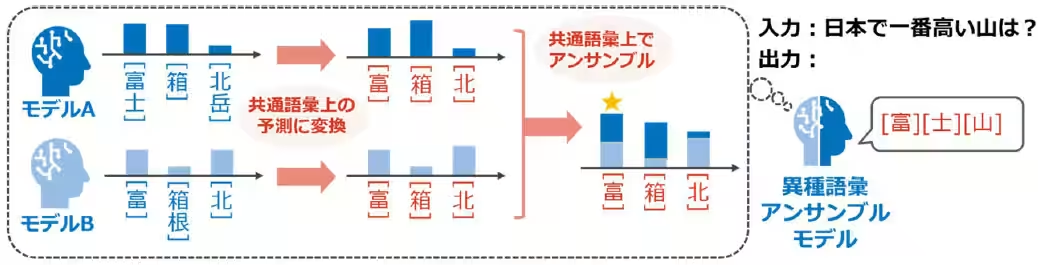

NTTが開発した技術は、推論におけるトークンの語彙集合を精度を損なうことなく、自在に縮小することができる理論とアルゴリズムに基づいています。従来、異なるLLM間ではトークン語彙が一致しないため、互いに情報を参照することが難しかったのですが、この新技術を用いることで、任意の異種LLM間で共通のトークンを通じて推論が可能となります。これにより、アンサンブルやポータブルチューニングなど様々な連携が実現し、量的な知識の統合と質的な精度向上が期待されています。

語彙の壁を超える

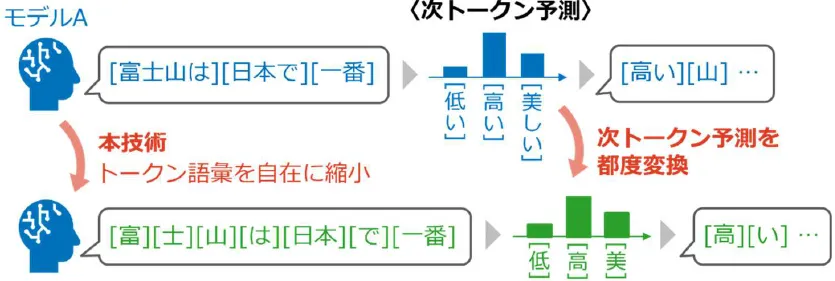

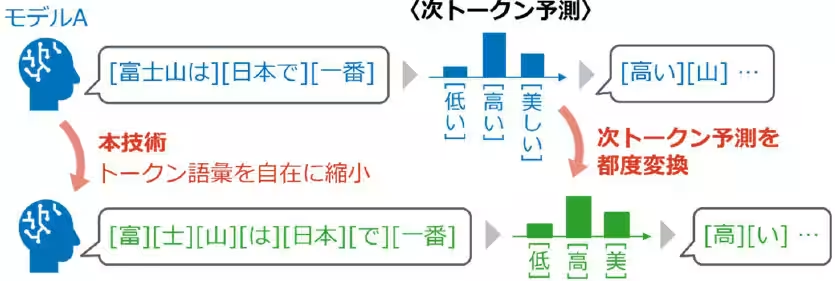

大規模言語モデルはトークンと呼ばれる部分単語の単位で動作し、次に出力されるべきトークン予測を行いながら推論を進めます。しかし、異なる開発時期や団体によって作成されたLLMのトークン語彙はまちまちであり、この「語彙の壁」が推論の精度を制限する要因となっていました。NTTの技術によって、この課題が解消され、異なるLLM間でもスムーズな連携が可能となるのです。

技術のポイント

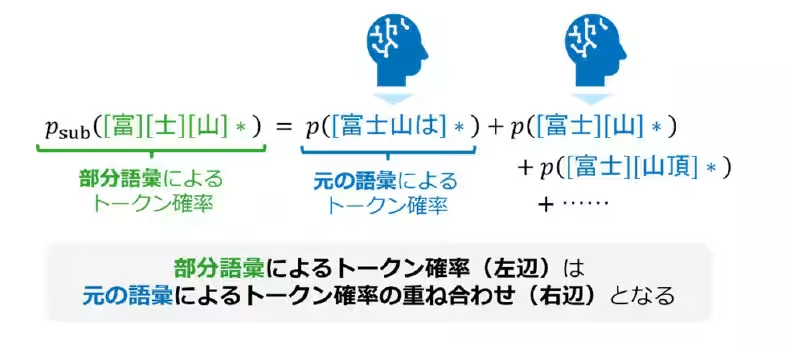

損失なしでの語彙縮小

従来の技術では削減したトークン候補の情報が出力に反映されないことで精度が損なわれていましたが、NTTの新技術は新たな理論フレームワークに基づき、出力する文章の傾向を変えずに部分語彙のみを使用することができます。このことで、高度な推論が可能となるのです。

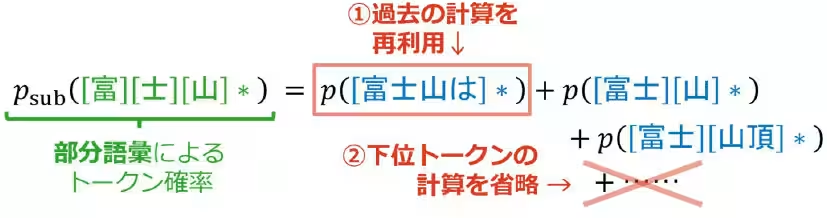

効率的な変換アルゴリズム

この技術による新しいアルゴリズムは、過去の計算結果を再利用することで計算コストを低減し、元の推論時と同程度のコストで動作することを実現しました。これにより、システム全体の操作性が大幅に向上します。

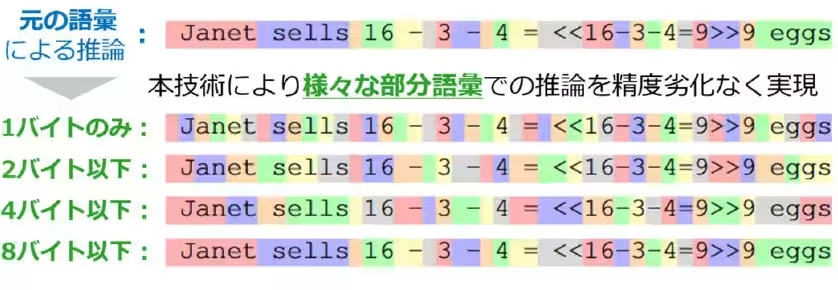

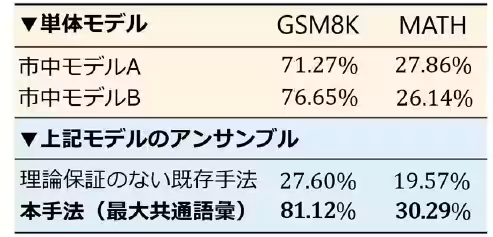

最大共通語彙による知識統合

NTTの技術を用いることで、異なる語彙を持つLLMが共通するトークンで推論を行うことができます。その結果、知識の統合が促進され、数多くの推論時の連携が可能となります。具体的には、実験を通じて異なるLLM同士が協力することで、知識の融合が確認されています。

今後の展開

この新技術の発表により、LLMの推論の枠が大きく広がることが期待されています。特に、NTTの独自モデルである「tsuzumi」など、異なるトークン語彙を有するモデルとの連携が容易になる見込みです。今後、技術の活用により、多様なLLM間での知識の統合や転移が進むことで、より高精度な推論が実現されることでしょう。

発表予定について

本技術は、2026年4月にブラジル・リオデジャネイロにおいて開催される国際会議「ICLR 2026」にて発表される予定です。世界中から注目が集まる中、その影響力が期待されています。これにより、LLMの未来は大きく変わることでしょう。

この技術がどのように実際の応用に結びついていくのか、今後も目が離せません!

会社情報

- 会社名

- NTT株式会社

- 住所

- 東京都千代田区大手町一丁目5番1号大手町ファーストスクエア イーストタワー

- 電話番号

トピックス(IT)

【記事の利用について】

タイトルと記事文章は、記事のあるページにリンクを張っていただければ、無料で利用できます。

※画像は、利用できませんのでご注意ください。

【リンクついて】

リンクフリーです。