英国APRIO TECHNOLOGIESが発表したホワイトペーパーが示すシャドーAIのリスクとは

シャドーAIの新たなリスクとその実態

近年、生成AIが企業の業務プロセスにおいて重要な役割を果たすようになりました。特に、従業員が個別の裁量でAIツールを利用する「シャドーAI」という現象が浮き彫りになってきています。この動向は、組織内部においてもさまざまなリスクを生み出す可能性があります。

シャドーAIとは何か

シャドーAIとは、従業員が正式な承認を受けずに業務にAIを取り入れる行為を指しています。この現象は、従来の「シャドーIT」に非常に似ています。企業のIT部門が把握できない、または監視されていないAIの使用により、多くのリスクが発生します。特に、情報の漏洩やコンプライアンスの違反といった問題が懸念されており、組織のガバナンスが脅かされています。

新たなリスク構造

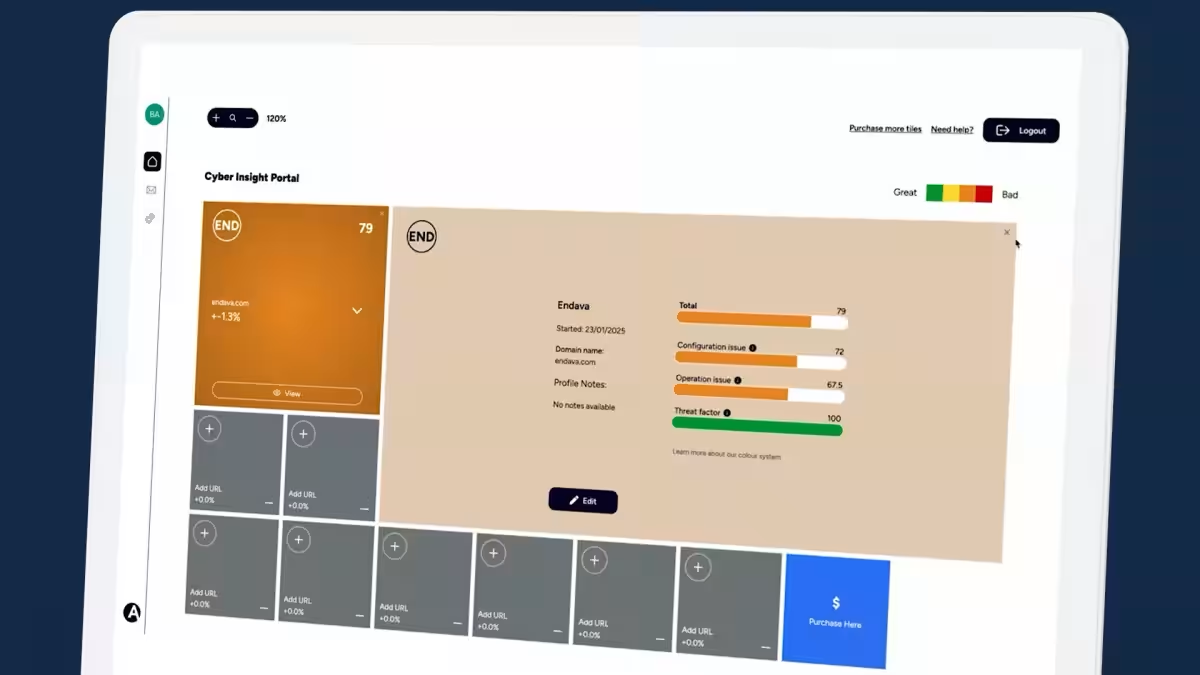

英国ロンドンのサイバーセキュリティ企業APRIO TECHNOLOGIESは、ホワイトペーパー「シャドーAIの実態と新たなリスク」を発表し、この問題についての詳細な分析を行いました。この文書では、生成AIの社内での利用がもたらすリスクについて、具体的な事例を挙げながら解説しています。

情報漏洩のリスク

従業員が個人の判断でAIツールを使うと、重要なデータが外部に流出する危険があります。特に顧客情報や機密データは一度流出すると企業にとって致命的な損失をもたらします。

法的トラブル

また、シャドーAI利用によって法的な問題が発生する可能性も高まりつつあります。企業がAIの監視体制を持たない場合、法令遵守が不十分となり、結果的に法的措置を受けるリスクが増加します。

AIサプライチェーンの脆弱性

AIの利用はサプライチェーンにおける新たな脆弱性も生むことがあります。企業はAI導入に際して、外部のAIサービスプロバイダーとの関係性についても注意しなければなりません。

組織の備えと未来の展望

ホワイトペーパーでは、シャドーAIに対する対策として“禁止”ではなく“安全に使いこなす”ための方針が提案されています。特に、AI利用政策の策定、従業員教育、そしてテクノロジーの可視化に関するアクションプランが計画されています。企業はこの新たな現象に適応する必要があります。

5つのアクションプラン

1. AI利用ポリシーの整備: 明確な方針を定める。

2. 従業員教育: AIに関するリスク意識を高める。

3. 技術的可視化: どのツールが使われているか把握する。

4. 法務連携: 法的遵守を支援するパートナーシップを築く。

5. モニタリング体制の強化: リアルタイムでリスクを評価。

APRIO TECHNOLOGIESについて

APRIO TECHNOLOGIESは、サイバーセキュリティリスク分析に特化した企業であり、重要インフラセクターを中心にサービスを提供しています。急速に進化する技術環境において、企業のAIガバナンスを支援するための革新的なアプローチを提案していることから、その注目度は高まっています。

このホワイトペーパーは、特に日本企業が直面するサイバーセキュリティの現状を知る上でも重要な文献であり、読者にとっても新たな気づきと考慮を促す内容となっています。最新のリスク環境に対して適切な行動を取ることが、今求められています。

会社情報

- 会社名

- APRIO TECHNOLOGIES LIMITED

- 住所

- 71-75 Shelton Street, Covent Garden, London, WC2H 9JQ

- 電話番号

トピックス(IT)

【記事の利用について】

タイトルと記事文章は、記事のあるページにリンクを張っていただければ、無料で利用できます。

※画像は、利用できませんのでご注意ください。

【リンクついて】

リンクフリーです。