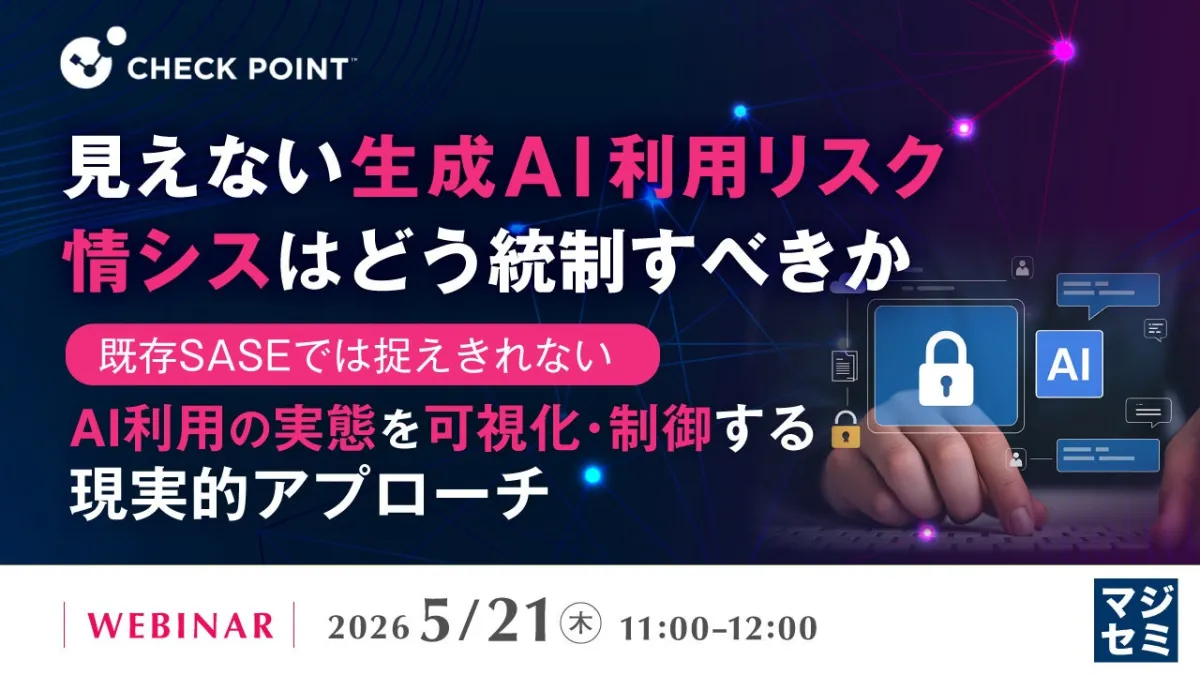

生成AI利用リスクを理解するためのウェビナーが開催されます

生成AI利用リスクを見極めるウェビナー

最近、企業内での生成AIの利用が急速に広がっている一方で、それに伴うリスクが見えにくくなっています。特に、情報システム部門(情シス)は、今後の業務運営においてどのようにこれらのリスクを統制すべきか、重大な判断を求められています。

生成AI活用の現状

業務の効率化を目的に、ChatGPTなどの生成AIが中小企業から大企業まで幅広く導入されつつあります。しかし、従来のセキュリティ設計ではカバーできない新たな利用方法が増えており、既存のSASE(Secure Access Service Edge)環境では十分に暗視化されていないケースが相次いでいます。企業は、特にどのように機密情報を守るべきかという課題に直面しています。

情報漏えいのリスク

生成AIの大きなテクノロジー的課題としては、従業員がどのような情報を入力しているかを把握できない点が挙げられます。業務の効率化に寄与する一方で、意図しない機密情報や個人情報が含まれる可能性があり、そのリスクは“見えないまま”存在しています。また、従来のSASE環境では、「許可するか、遮断するか」という2つの選択肢しかなく、実際の業務要件と乖離しているのが現状です。

このような風潮の中、一部の企業はリスクの判断を定まらないまま、運用を続けているという実情があります。

ウェビナーの内容

今回のウェビナーでは、既存のSASE環境を大きく変更することなく、生成AI利用の実態を可視化と制御する手法について詳細に解説します。Check Point Browser Securityの活用により、ブラウザを起点にAI利用の実態を把握し、適切なポリシーの柔軟な管理を行う方法を紹介する予定です。

具体的には、従来の「許可/拒否」という選択肢に依存せず、セキュリティを保ちながらもAI活用を止めることの無い考え方を整理し、「何を把握すべきか」や「どこまで制御すべきか」という判断軸を提案します。

このウェビナーは、以下のような方に特におすすめです。

- - 生成AIの業務利用が進む中、情シスとしての統制のあり方に不安を感じている方

- - ChatGPTなどへの入力情報を把握できず、情報漏えいに対する課題を持っている方

- - 既存のSASEではAI利用の可視化が不十分だと考える方

- - AI活用を止めずに現実的な統制方法を検討している方

- - SASEを改変せずに追加施策でAI対応を実現したい方

主催・共催

本ウェビナーの主催はチェック・ポイント・ソフトウェア・テクノロジーズ株式会社であり、株式会社オープンソース活用研究所およびマジセミ株式会社と共同で開催されます。詳しい内容や参加申込については、公式ウェブサイトでご確認ください。

マジセミでは、今後も「参加者に役立つ」ウェビナーを続けて開催していきます。過去のセミナー資料や他の募集中のセミナーについては、公式ウェブサイトでご覧いただけます。

会社情報

- 会社名

- マジセミ株式会社

- 住所

- 東京都港区海岸一丁目2-20汐留ビルディング3階

- 電話番号

- 03-6721-8548

トピックス(IT)

【記事の利用について】

タイトルと記事文章は、記事のあるページにリンクを張っていただければ、無料で利用できます。

※画像は、利用できませんのでご注意ください。

【リンクついて】

リンクフリーです。