AI導入の失敗を克服する「EVΛヨ」が目指す透明性ある設計思想

AI導入の失敗とその克服法

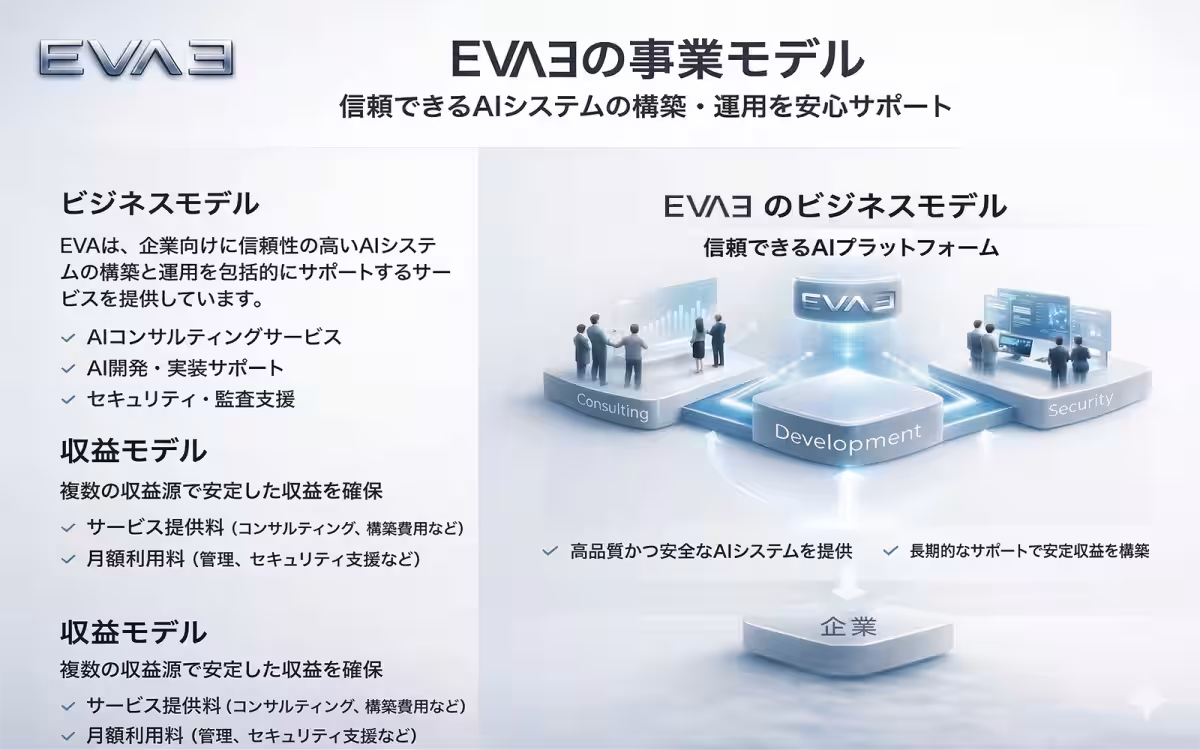

日本のアミュレットプラス合同会社が提案する新しいAI設計指針「EVΛヨ」は、AI導入の際によく見られる問題、特に「説明責任の欠如」や「判断のブラックボックス化」を、事前設計の視点から根本的に解決しようとしています。

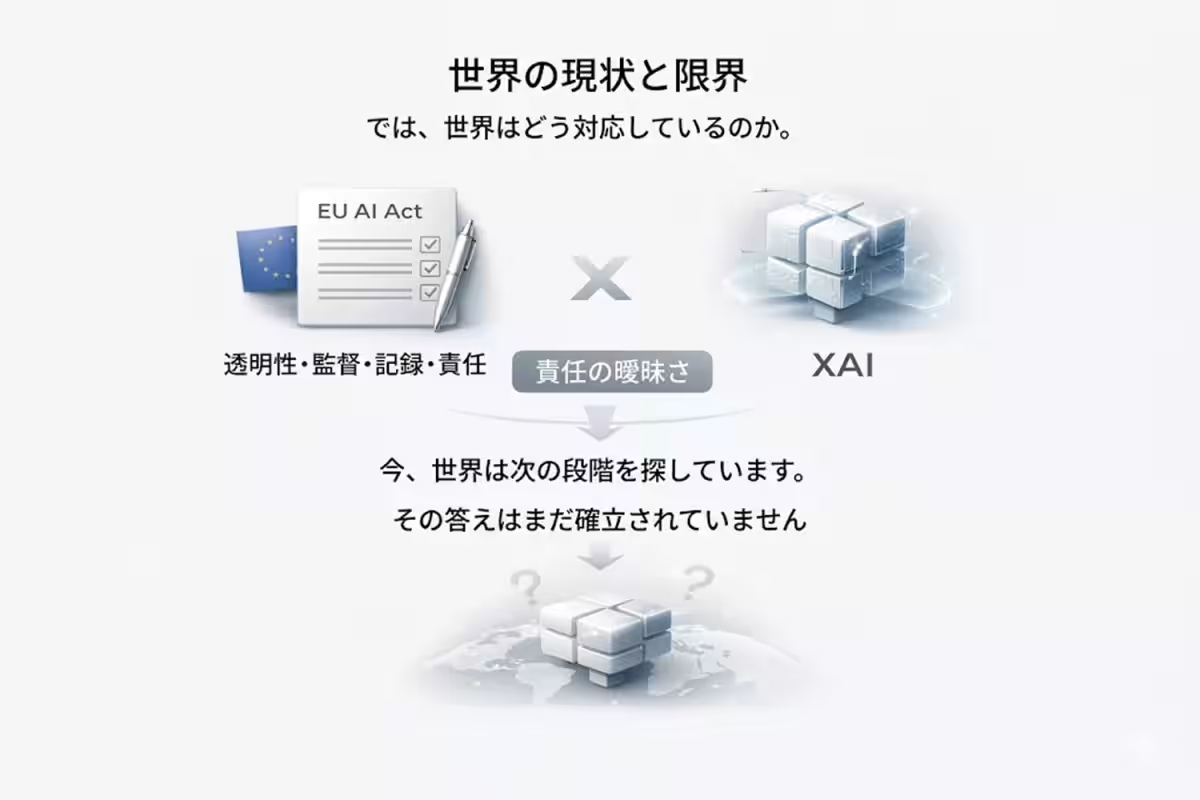

AI導入の現状と課題

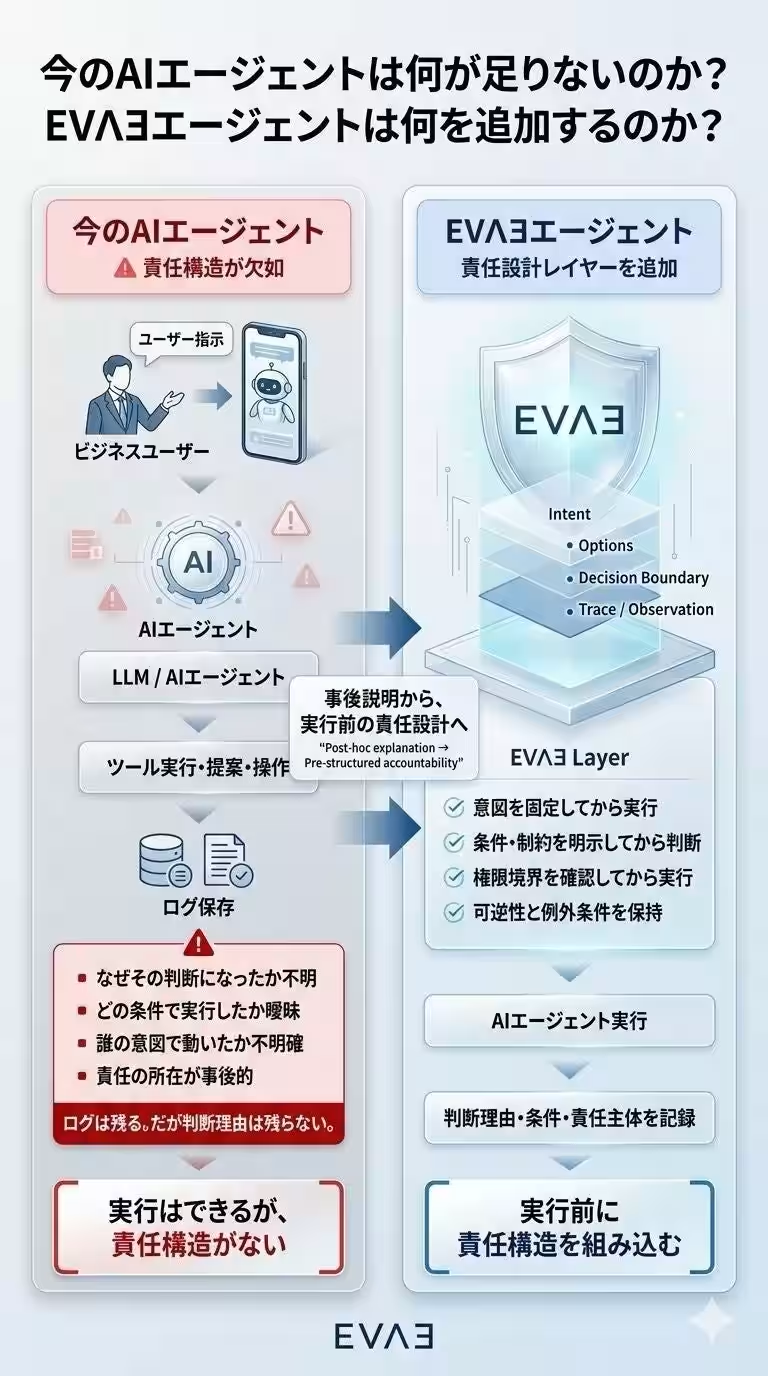

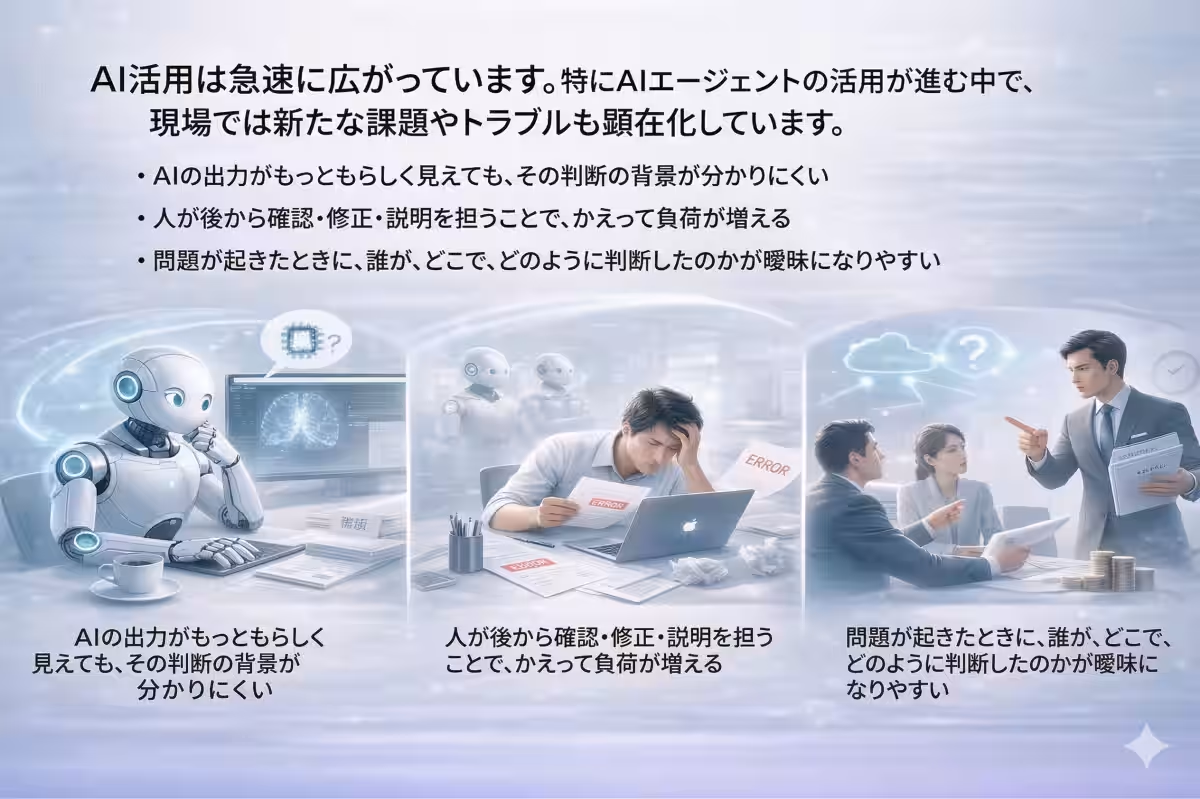

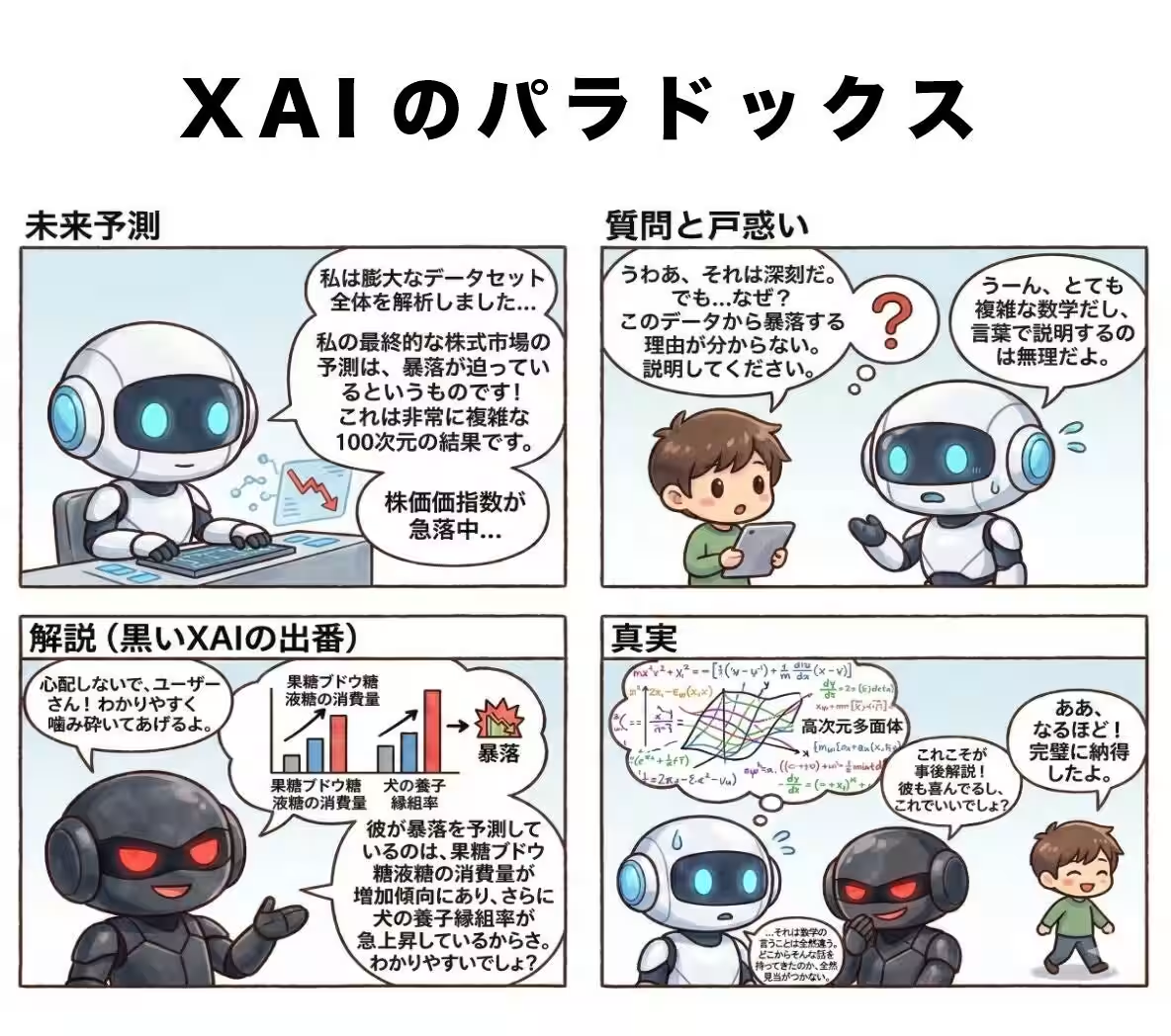

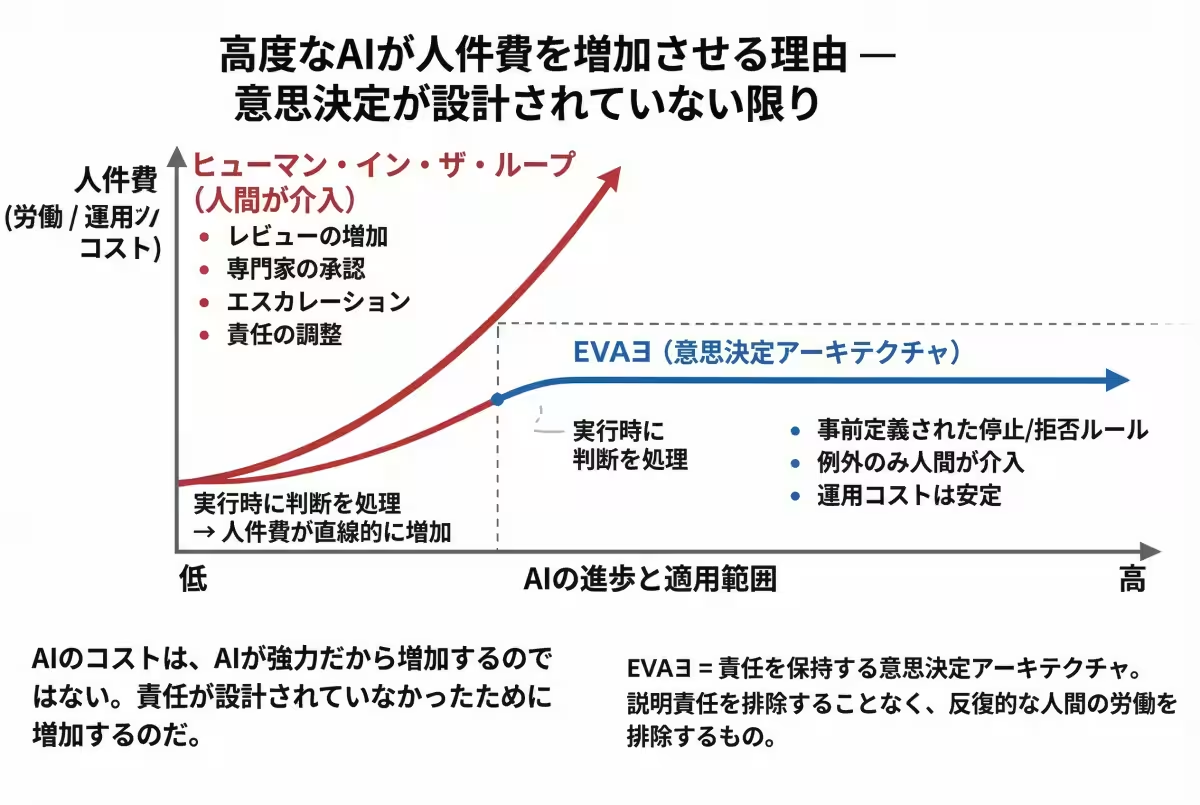

近年、AIが多くの分野で広く活用されるようになりましたが、その一方でさまざまな課題も浮上しています。特に、AIエージェントが生成する出力は、表面的には信頼性が高く見えるものの、その背後にある判断プロセスが不透明であり、実際の責任が誰にあるかが曖昧です。このような状況は、個人や組織がAIを適切に導入する妨げとなる可能性があります。

具体的には、AIの判断がどのように行われたのか人間が理解できず、問題が発生した際に誰が責任を持つのかが明確でないために、現場の負担が増加することが多く見受けられます。中でも、AI社内運用においては、後からの確認や修正が必要となり、結果的に人間が追われることが多くなってしまいます。

「責任の空白」を埋めるEVΛヨのアプローチ

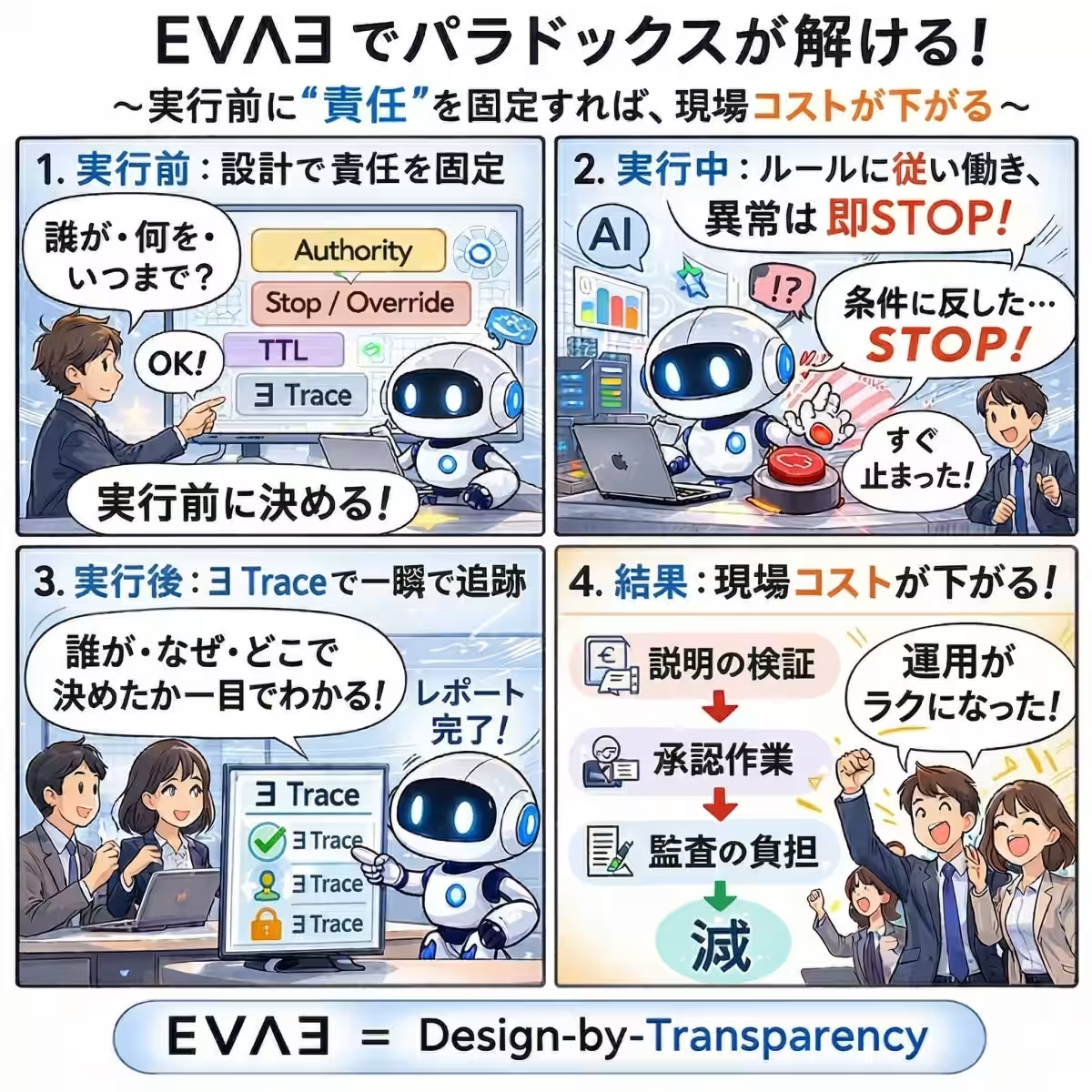

EVΛヨが提唱するのは、AIの意思決定過程を事前に設計する「Design by Transparency(透明性による設計)」の思想です。このアプローチは、AIが実行に移る前に必要な要素を定義し、明確にすることに重点を置いています。

1. 意図(Intent) - 何のために判断するのかを明確にする。

2. 権限(Authority) - 誰が決定権を持つのかを定める。

3. 制約(Constraint) - 何をしてはいけないのかを具体的に示す。

4. 観測(Observation) - 判断の証拠としてどう記録し、責任をどのように残すのかを計画する。

この4つの要素が決まることで、AIが行動する際の責任が明確になり、透明性のある判断を実現することが可能になります。これにより、医療や金融など、高い信頼性が求められる領域でも安心してAIを活用できる環境が整います。

EVΛヨの実装とその意義

EVΛヨの考え方は、単なる理論にとどまらず、実際のアプリケーションでの実装も進んでいます。インタラクティブなシミュレーターを用いることで、様々な領域—医療、教育、自動運転など—における「責任ある意思決定」を体験できます。さらに、金融業界でのAPI連携の実演も行われ、透明性の高い判断プロセスが確認できます。

このように、「Design by Transparency」理念を社会全体に広めることにより、AIが単に便利な道具であるだけではなく、社会の中で信頼され、責任を持つ存在へと進化することを目指しています。

未来へのビジョン

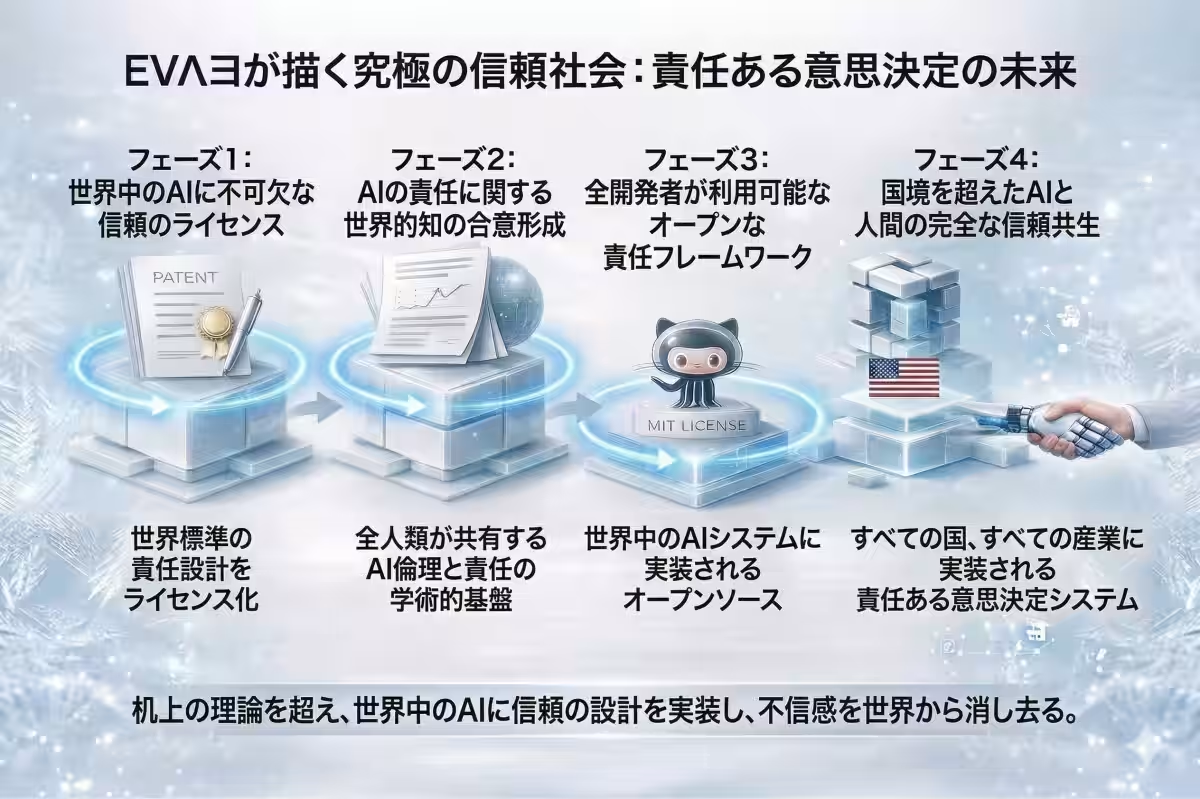

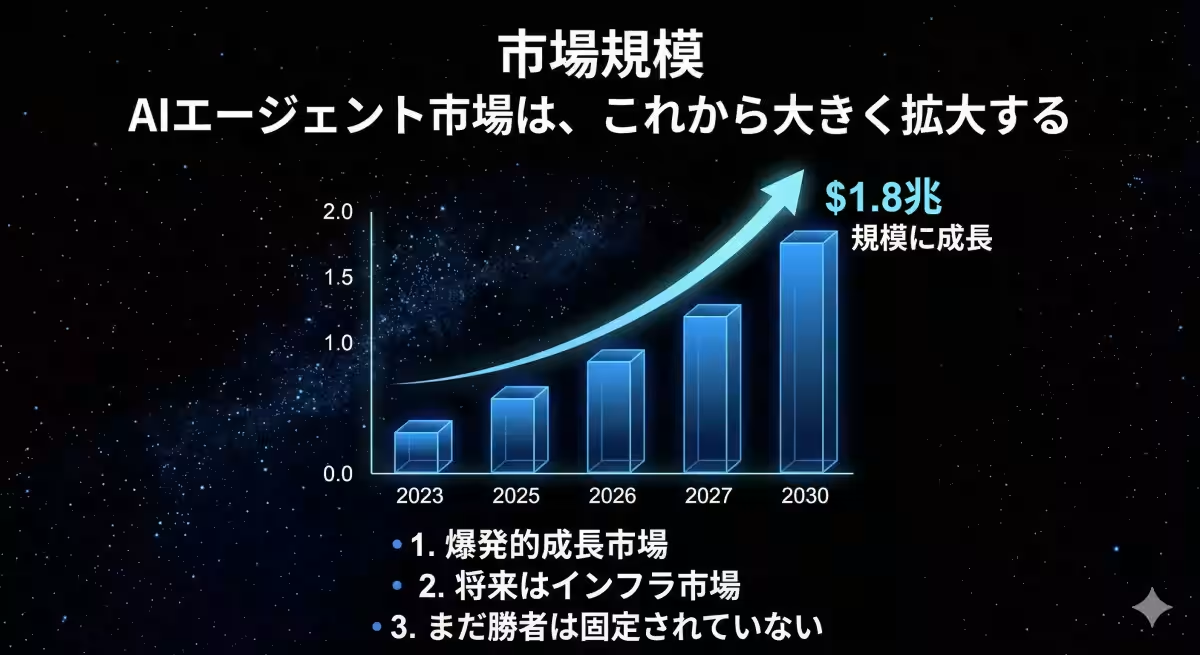

アミュレットプラス合同会社の目標は、2030年までに世界中の主要なAIシステムの50%以上に「Design by Transparency」の思想を浸透させることです。この実現によって、信頼されるAI社会の基盤を構築し、日本から世界に向けてその標準を広めていくことを目指しています。

最終的に、EVΛヨが描く未来は、AIと人間が国境を越えて信頼し合える関係を築くことであり、責任を設計したAIが活躍する社会の実現です。この理念に共感し、共に「信頼の未来」を創造していく仲間を求めています。

会社情報

- 会社名

- アミュレットプラス合同会社

- 住所

- 東京都大田区田園調布1−55−20浅間ビル211号

- 電話番号

トピックス(IT)

【記事の利用について】

タイトルと記事文章は、記事のあるページにリンクを張っていただければ、無料で利用できます。

※画像は、利用できませんのでご注意ください。

【リンクついて】

リンクフリーです。