生成AIに潜むリスク:管理職のシャドーAI利用がもたらすセキュリティ問題とは

生成AIに潜むリスク:管理職のシャドーAI利用がもたらすセキュリティ問題とは

最近、生成AIの使用が企業の業務効率化に貢献する一方で、その影には多くの課題も浮かび上がっています。特にシャドーAIと呼ばれる、企業が把握・許可していないAIを利用するリスクが注目されています。GRASグループ株式会社が運営する女性のキャリア支援媒体「星のまなびカフェ」による調査によって、生成AIの利用実態とその隠されたリスクが明らかになりました。

調査の背景

生成AIはその便利さから、多くの企業で利用されていますが、同時に企業が知らない形で使われる場合もあります。シャドーAIの利用は、企業の情報管理に対する脅威をはらんでいます。この調査では、生成AIを業務で使う478名の会社員を対象に、その実態とセキュリティリスクについて掘り下げることを目的としました。

基本実態

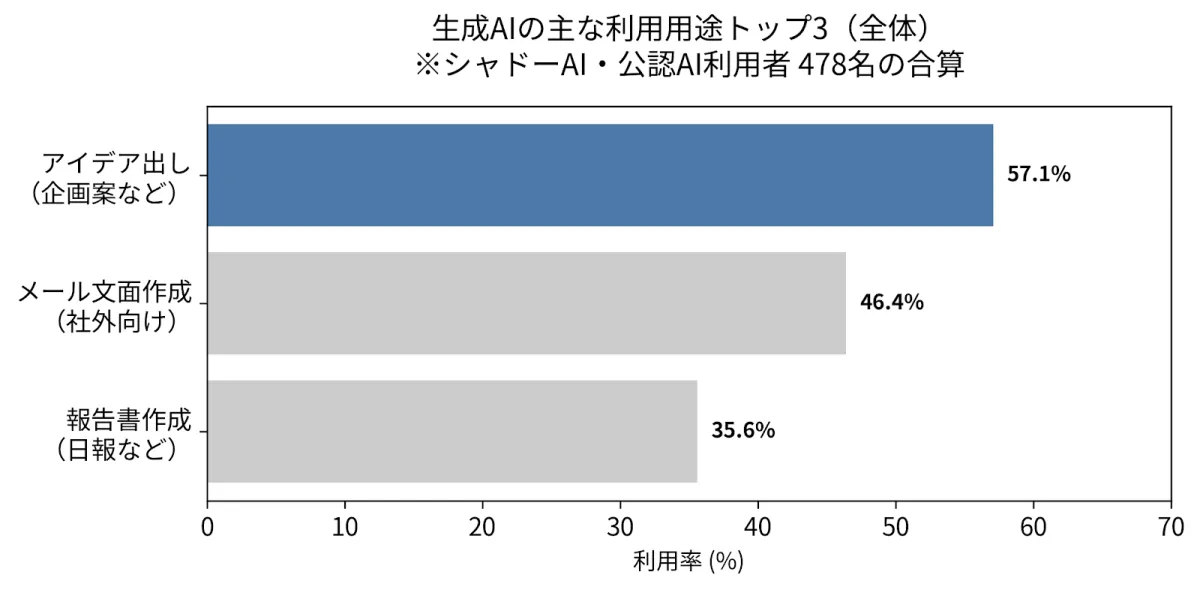

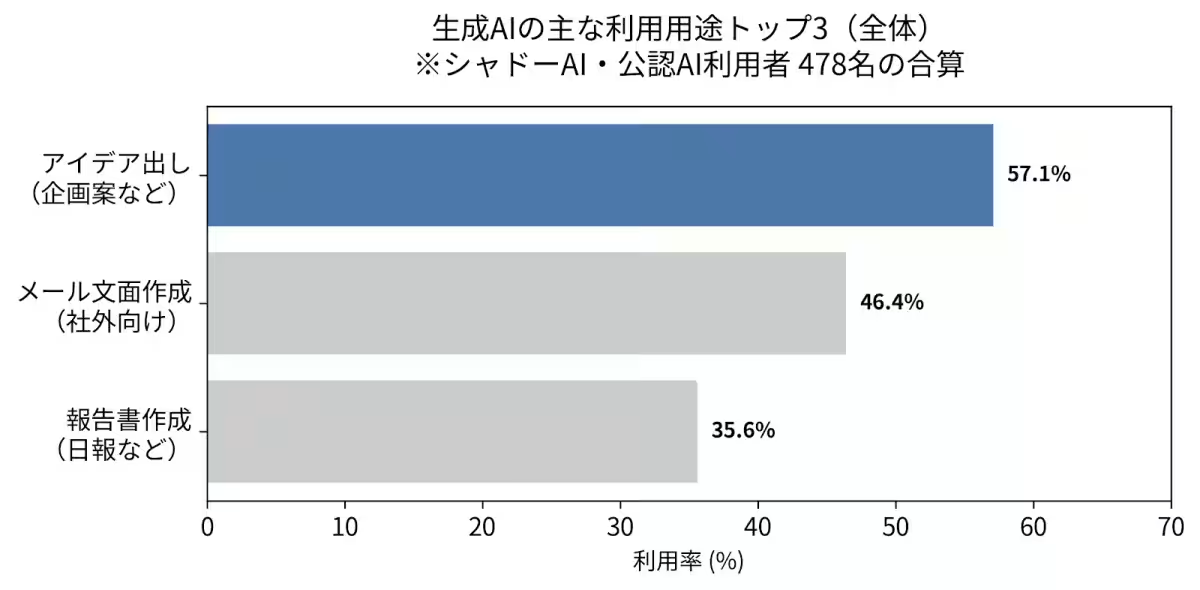

調査の結果、生成AIの主な利用用途は「アイデア出し」が57%、次いで「メール作成」が46%であり、日常業務に深く根付いていることがわかります。このように業務の中で定着している生成AIですが、その良さの裏には見えざる危険が存在します。

シャドーAI利用とリスク

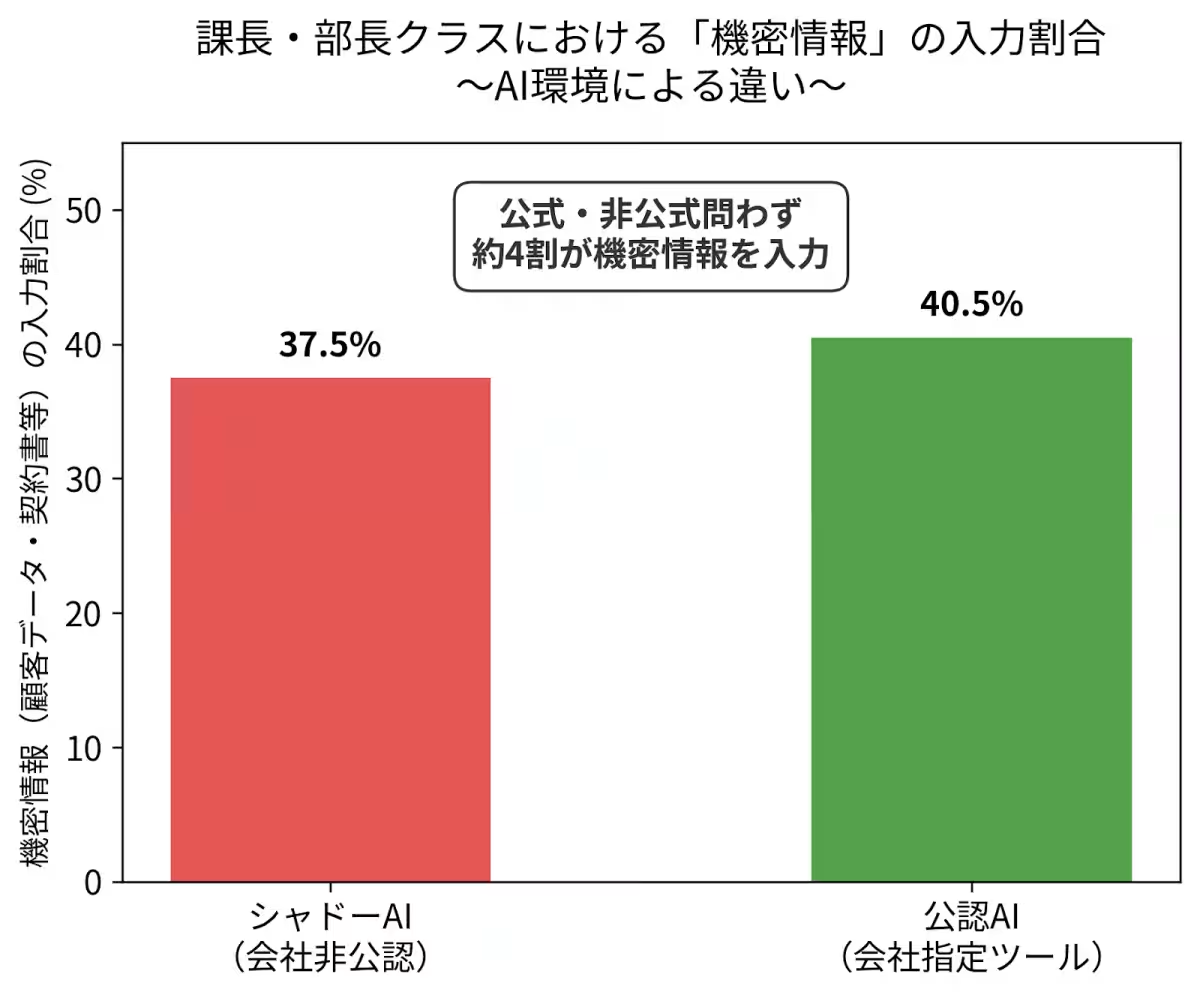

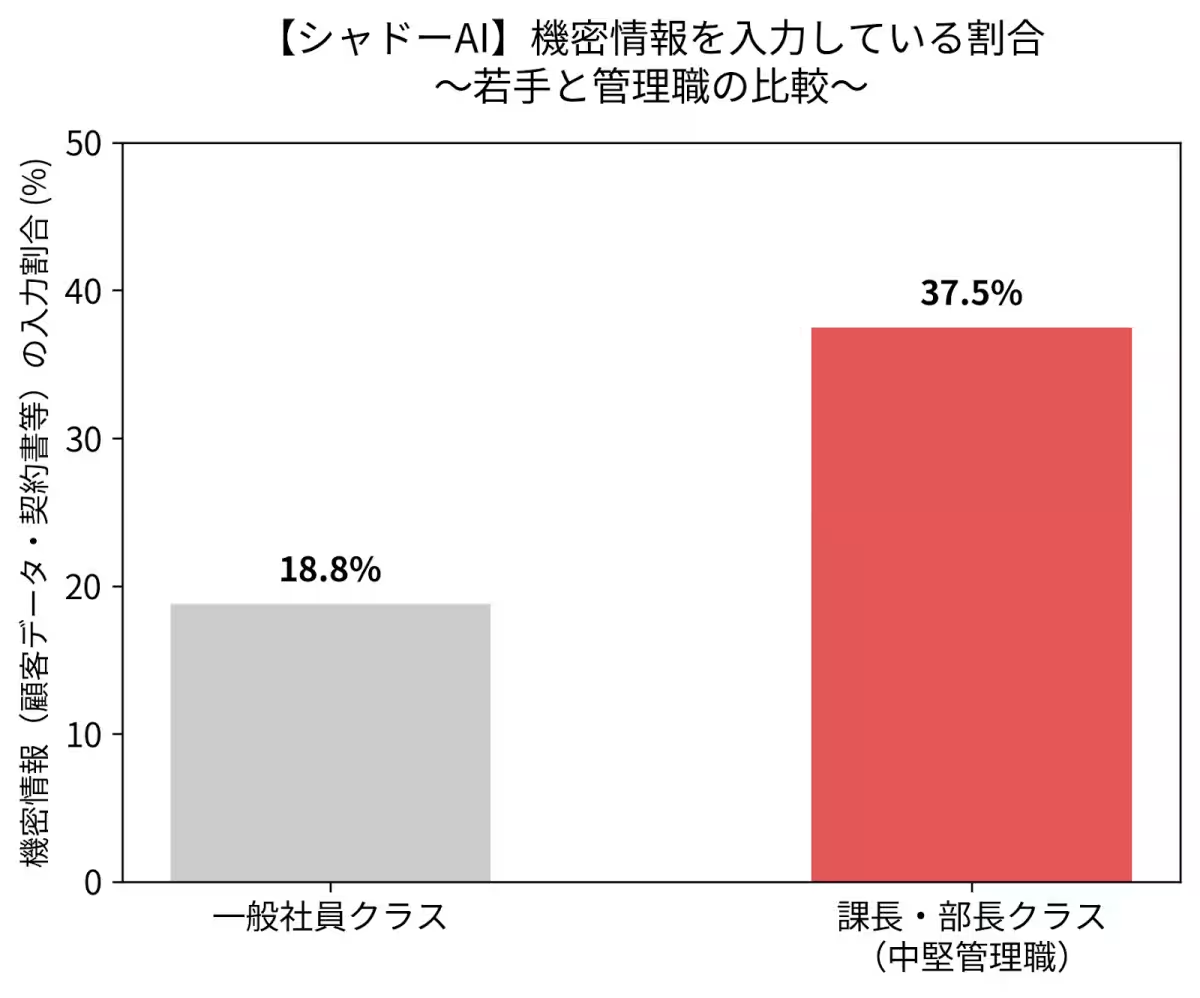

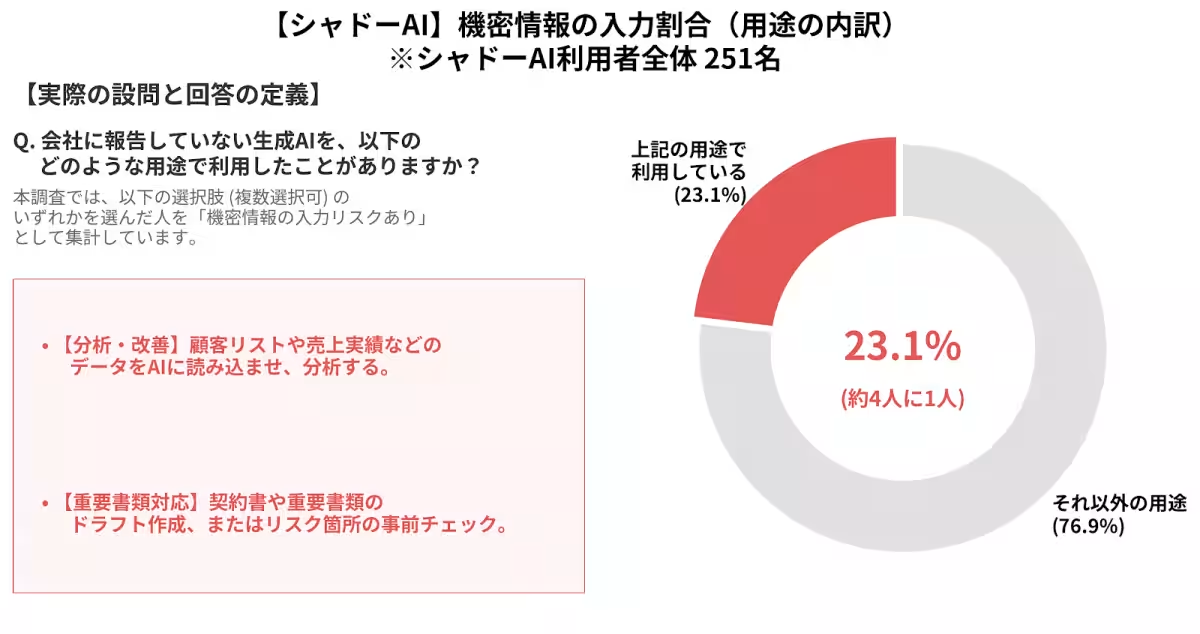

シャドーAIユーザーに対する調査でも、実に23.1%の利用者が機密情報を入力していることがわかりました。特に驚くべきことに、課長や部長クラスといった管理職層でその率は37.5%にも達します。一般社員の18.8%に対し、約2倍の割合です。これは、決裁権を持つ管理職ほど危機感を持たずに情報を扱っている可能性があり、非常に大きな問題です。

ルールの限界

企業が「機密情報をAIに入力することは禁じられている」と定めても、実際にはそのルールを守られていないのです。管理職の約40%が公認AIを使っても機密情報を入力している実態もあり、単に禁止するだけでは解決には至りません。

湧き上がるニーズ

企業側がシャドーAI問題を意識し、ルールを設けたとしても、業務効率化という必要に逆らうことはできません。現に、許可されている公認AIにおいても機密情報を扱う必要性が認識されている結果となりました。これは、システム側でかなりの部分が解決されない限り、ベストな形ではないということを示しています。

NDA違反と信用の失墜

しかし、このシャドーAIによる利用の本当の恐怖は、実際の情報流出そのものではありません。それが契約違反、特にNDA(秘密保持契約)に繋がることが企業にとって致命的な打撃となります。国の方針でも、シャドーAIによる業務利用は許可されておらず、情報漏洩と同じくらいのリスクを含む行為だとされています。

企業が求められる対策

危険性を理解した上で、企業は「ルールで禁止する」という手法を見直す必要があります。問題解決には、安全なAI環境の提供が求められます。社員が安心して機密データを扱える環境を整えることこそが、企業に求められるセキュリティ対策となるでしょう。

この調査結果をもとに、企業は新たなAI環境の整備を急ぐ必要があります。業務効率化とセキュリティの両立が求められる現代において、今後の取り組みが注目されています。

会社情報

- 会社名

- GRASグループ株式会社

- 住所

- 東京都港区芝5丁目14-13アセンド三田7階

- 電話番号

- 03-5432-9906

トピックス(IT)

【記事の利用について】

タイトルと記事文章は、記事のあるページにリンクを張っていただければ、無料で利用できます。

※画像は、利用できませんのでご注意ください。

【リンクついて】

リンクフリーです。