日本における生成AIによるデータポリシー違反の実態と対策

日本における生成AIによるデータポリシー違反の実態と対策

はじめに

Netskope Threat Labsが発表した新たな年次レポートによれば、日本の組織における生成AI関連のデータポリシー違反は、月平均500件を超え、これはグローバル平均の約2倍にあたります。今回の調査は、2025年における日本のAI、クラウド、およびマルウェアの脅威に関するものです。この趨勢は、国内の企業が直面する新たなリスクを浮き彫りにしています。

生成AIの急速な普及

日本では、生成AIの導入が進み、現在80%の組織の従業員がこの技術を利用しています。これは昨年の69%から増加した数字です。また、Netskopeの調査によると、生成AIツールの数は1,800以上に達し、使用可能なツールが急激に増加していることも示されています。

データポリシー違反の現状

生成AIの利用が増える中、機密情報をプロンプトに入力したり、不適切な文書をアップロードするリスクが顕在化しています。具体的には、日本の組織で発生する生成AI関連のデータポリシー違反の内訳は、知的財産やソースコード、個人情報など多岐にわたります。

ドメスティックな必然

実際、知的財産関連のリスクが最も大きく、企業は管理可能な生成AIツールの導入を急がなければなりません。オンラインでの個人アカウント使用を制限し、企業が利用状況を把握することで、データ流出を防ぐセキュリティ対策が求められています。

シャドーAIの排除と企業の対応

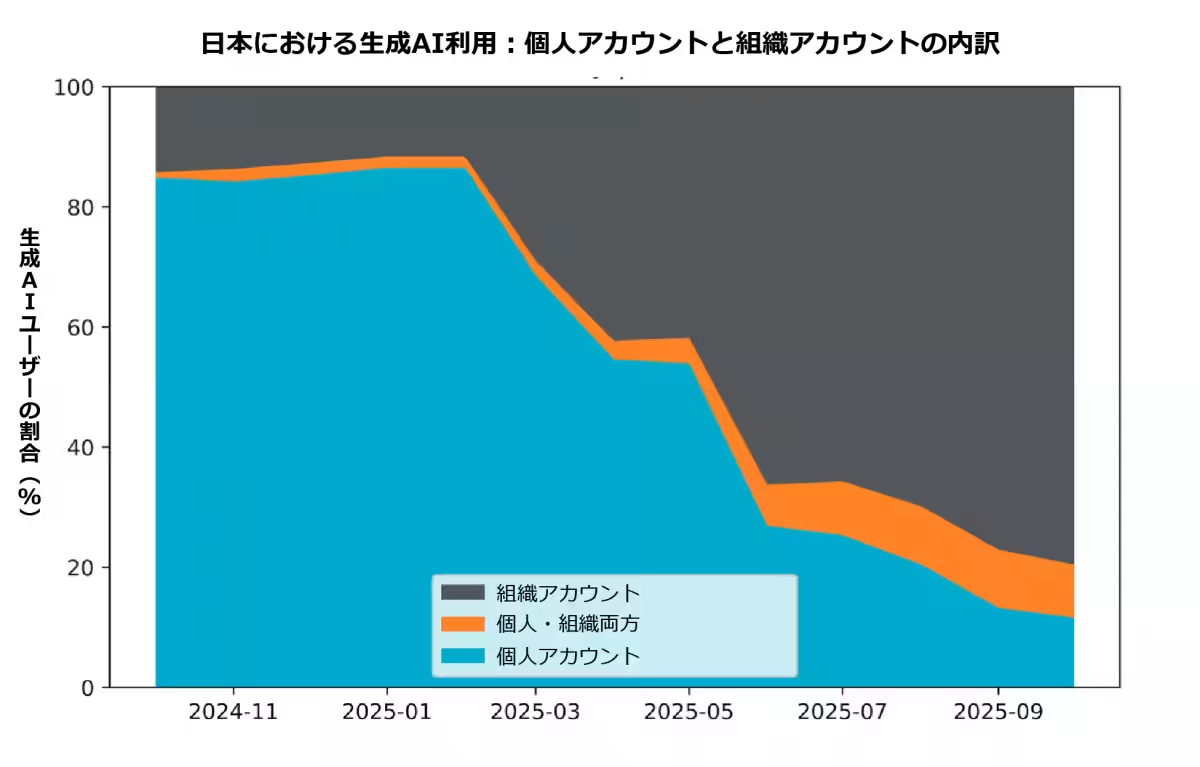

このような流れの中で、昨年比で日本の企業は良い進展を見せており、個人アカウントによる生成AIの使用率は85%から11%に急減しました。一方、企業管理アカウントの利用は15%から79%に増加しています。この成功の背景には、企業が承認済みの生成AIツールを積極的に利用し始めたことが挙げられます。

競争の現状

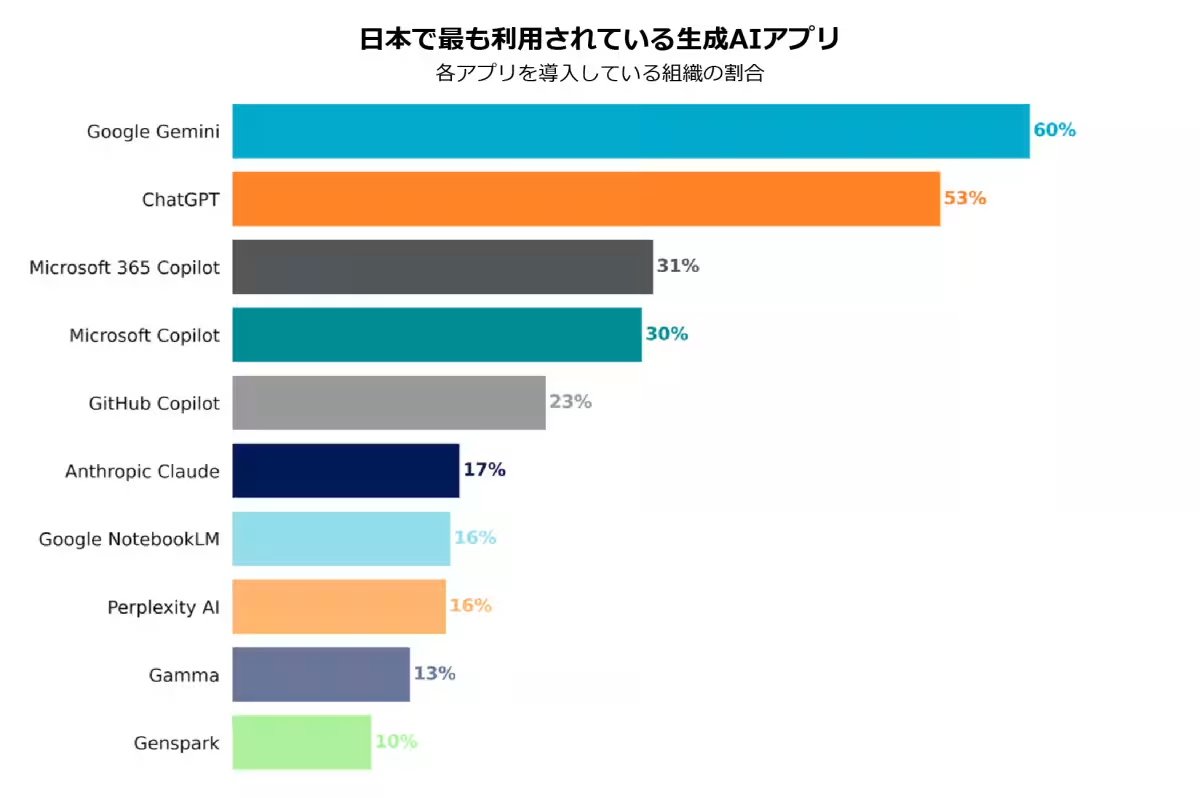

面白いことに、業界の主流であるChatGPTに対抗して、GoogleのGeminiが日本での利用率を上回るという現象が見られました。これは、海外では考えられなかった動きであり、日本特有の市場の特性を示しています。

セキュリティの課題と対策

Netskopeは、悪質なコンテンツやマルウェアから企業を守るため、包括的なセキュリティ機能の導入を推奨しています。特に、無料や未承認のアカウントが脅威の発生源になることが多いため、監視体制の強化が必要です。

クラウドアプリケーションの影響

また、職場でのクラウドアプリケーションの使用がデータ漏えいの一因となっている現状も無視できません。平均して月に約17件のデータポリシー違反が個人用アプリに関連して発生しており、知的財産やパスワード関連が多くを占めています。

今後の展望

Netskope Threat Labsのディレクター、Ray Canzaneseは、企業がセキュリティとイノベーションのバランスを取る難しさを強調しつつ、データ保護策の必要性を訴えています。日本の組織にとって、生成AIの利活用を推進する中で、これらのリスクに真摯に向き合うことが求められています。

結論

データポリシー違反の増加は、直面するリスクを明らかにし、企業は適切な対策を講じなければなりません。より安全なAIの利用が社会全体の利益につながることを期待しています。

今後の詳しい情報や統計については、レポートを確認してください。Netskopeは、クラウドおよびAIの時代における最新のセキュリティ対策で業界をリードしています。

会社情報

- 会社名

- Netskope Japan株式会社

- 住所

- 東京都千代田区丸の内1-5-1新丸の内ビルディング10階 EGG・JAPAN内

- 電話番号

トピックス(IT)

【記事の利用について】

タイトルと記事文章は、記事のあるページにリンクを張っていただければ、無料で利用できます。

※画像は、利用できませんのでご注意ください。

【リンクついて】

リンクフリーです。