AIの未来を切り拓くNVIDIAのVera Rubinプラットフォームが輝く新チップ群

NVIDIAが切り拓くAIの未来

NVIDIAが新たに発表したVera Rubinプラットフォームは、次世代のエージェント型AIを実現するための画期的な技術を導入しています。2026年3月に行われたGTCにおいて、同社はAIファクトリーを支えるための7つの新しいチップの量産を発表しました。これにより、AIの全てのフェーズをサポートするように最適化されたシステムが実現します。

進化するAIインフラ

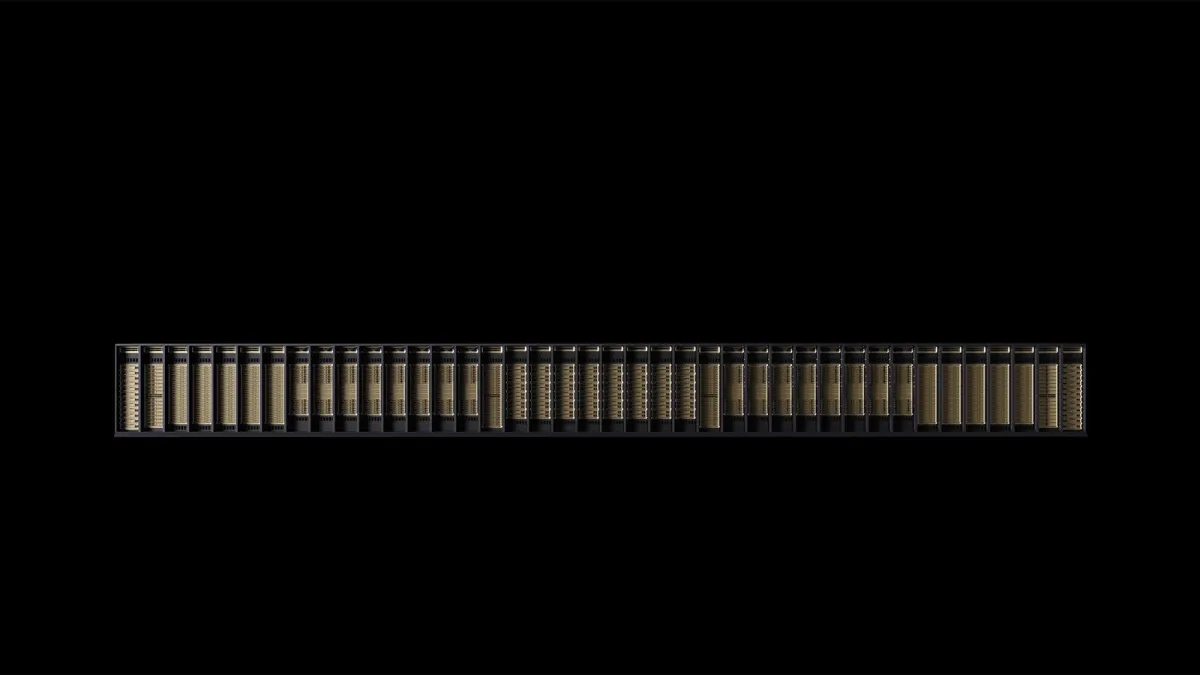

これらの新しいチップは、Vera CPUラック、Vera Rubin NVL72 GPUラック、NVIDIA Groq 3 LPX推論アクセラレーターラックなど、さまざまなラックに組み込まれています。これにより、事前トレーニング、ポストトレーニング、テストタイムスケーリングからリアルタイム推論に至るまで、AI関連の処理を一貫して行うことが可能です。NVIDIAのCEO、ジェンスン・フアン氏は、「Vera Rubinは世代を超えた飛躍です」と述べ、AIインフラの新たなステージが始まったことを示唆しました。

チップの魅力

新たに追加されたVera CPUやRubin GPU、NVLink™ 6 Switchなどのチップは、AIモデルのパフォーマンスを劇的に向上させるために連携して機能します。それぞれのチップは、特にエージェント型AIや強化学習のニーズに対応するために設計されており、従来のシステムに比べて効率とスループットを大幅に向上させることが期待されています。

特に注目されるのは、Vera Rubin NVL72ラックです。このラックは、72基のRubin GPUと36基のVera CPUを接続し、驚異的な処理能力を誇ります。これにより、トークンあたりのコストが10分の1に削減され、推論スループットが10倍も高まるという結果が出ています。

エコシステムの拡張

NVIDIAの新たなプラットフォームは、80社以上のパートナー企業とともに構築されたエコシステムに支えられています。これにより、各種業種や規模の企業が活用できるように設計されています。AIファクトリーへのアクセスが容易になり、より多くの企業がAIテクノロジーを取り入れることが可能になります。また、様々なクラウドプロバイダーやデータセンターインフラパートナーも新たなサービスを展開予定です。

AIインフラはこれまで、ディスクリートチップやスタンドアロンのサーバーから、ラックスケールの統合型システムへの移行が進んでいます。これにより、業種を問わずパフォーマンスが向上し、コストを抑えることができるようになっています。

低レイテンシと高効率

NVIDIA Groq 3 LPXラックに搭載されているLPXプロセッサは、エージェント型システムにおける低レイテンシと大規模なコンテキストを実現するために特化しています。これにより、1兆パラメータモデルにおいて、メガワットあたりの推論スループットを35倍に向上させることが可能になります。また、50%のコスト削減も期待されています。

さらに、NVIDIA BlueField-4 STXラックは、AIワークフローで生成されるデータの効率的な保存と取得を支援するAIネイティブなストレージインフラを提供。これにより、エージェントとのインタラクションが急速に行えるようになるでしょう。

未来の展望

今回の新技術は、AIファクトリー全体の構成要素が協調して働くことで、エネルギー効率やシステム全体の稼働率を向上させることを可能にします。長期的に見れば、これによりAI産業の成長が加速し、全体的なAIの普及が促進されることでしょう。

NVIDIAは今後もAIとアクセラレーテッド・コンピューティングのリーダーシップを強化し、業界全体に持続可能な成長をもたらすことが期待されています。新たに発表されたVera Rubinプラットフォームとその周辺技術は、AIの未来をさらに広げる重要な一手となるでしょう。

会社情報

- 会社名

- NVIDIA

- 住所

- 東京都港区赤坂2-11-7ATT New Tower13F

- 電話番号

トピックス(IT)

【記事の利用について】

タイトルと記事文章は、記事のあるページにリンクを張っていただければ、無料で利用できます。

※画像は、利用できませんのでご注意ください。

【リンクついて】

リンクフリーです。