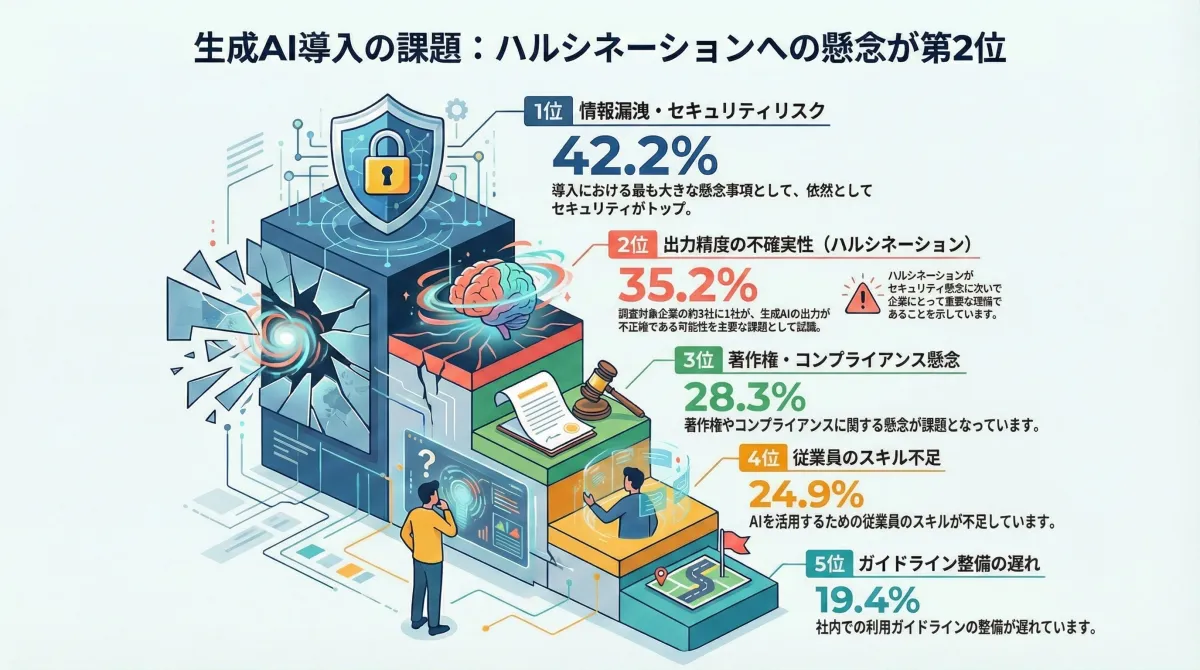

企業の生成AI活用における課題認識と有効な対策とは

企業の生成AI活用における課題と対策

ラーゲイト株式会社が実施した調査によると、生成AIを業務で活用する企業の中で約35.2%が『ハルシネーション』を課題として認識しているという結果が出ました。これは、生成AIが正確な情報を出力することを保証していないため、多くのビジネスパーソンが『AIが自信を持って誤った情報を提供した』という経験を持っているからです。

調査の実施背景

近年、生成AIの導入が加速する中で、意思決定に不可欠な情報を提供するAIが誤った情報を出力するリスクが顕在化しています。特に、情報収集や市場分析といった業務領域においてハルシネーションがもたらすリスクは高まっており、企業に深刻な影響を与えているのが現状です。

調査の結果、情報システム部門やDX推進室に所属する505名を対象に、ハルシネーションに対する対策として『RAG(Retrieval-Augmented Generation)』の導入が推奨されることが分かりました。

調査結果の概要

1. ハルシネーションを課題視する企業は35.2%

調査により、ハルシネーションを課題として捉えている企業は35.2%に達し、これはセキュリティリスクに次ぐ第2位の重要課題として位置付けられました。

2. 情報収集・分析が最高リスク領域

加えて、業務別のリスク分析では、情報収集や調査を行う業務が39.2%と最高のリスクを持つことが明らかになっています。誤った情報に基づく意思決定は直接的な損失を引き起こしかねません。

3. RAG導入が最も効果的な対策

ハルシネーションの低減にはRAGの採用が最も根本的かつ効果的な手法であり、社内のナレッジベースや信頼できる情報源と連携することで、事実に基づいた回答を実現することが期待されています。

RAG導入の具体的なメリット

RAG導入によって考えられる主な利点は次の通りです。

- - ファクトチェック体制の構築:AI出力後に自動検証を行い、人間がレビューする段階を設けることで、誤情報のリスクを軽減できます。

- - プロンプトエンジニアリングの最適化:AIが不明な情報に対しては『分からない』と回答させるなど、明確な条件を設けることが重要です。

- - 用途別のモデル選定:使用目的に応じたモデル選定を行うことで、効率的な活用が可能です。

- - 継続的なモニタリング:ハルシネーションの発生率を指標として、常に改善を図る体制が求められます。

今後の展望

ラーゲイトの調査結果は、ハルシネーションは完全には排除できませんが、適切な管理を通じて許容範囲内に収めることが可能であることを示しています。業務における生成AIの活用が進む中、出力品質の監視はITの問題から経営課題へと移行することが予測されます。特に、情報システム部門では管理体制の早期構築が重要な競争要因となるでしょう。

ラーゲイトでは、企業のAI活用をサポートするために、専門的なチームがRAG環境の構築を支援していますので、ぜひお問い合わせください。

会社情報

- 会社名

- Ragate株式会社

- 住所

- 東京都中央区日本橋富沢町6-4WORK EDITION 4B

- 電話番号

- 050-5527-2670

トピックス(IT)

【記事の利用について】

タイトルと記事文章は、記事のあるページにリンクを張っていただければ、無料で利用できます。

※画像は、利用できませんのでご注意ください。

【リンクついて】

リンクフリーです。