会社の許可を得ていない生成AI利用実態とそのリスクを探る

会社の許可を得ていない生成AI利用実態とそのリスクを探る

生成AIの技術の進展により、業務で生成AIを利用するケースが急増しています。コーレ株式会社が実施した調査によると、約半数のビジネスパーソンが会社の許可なく生成AIを使用している実態が明らかになりました。今回は、その実態と潜在的なリスクについて詳しく見ていきます。

調査の概要と結果

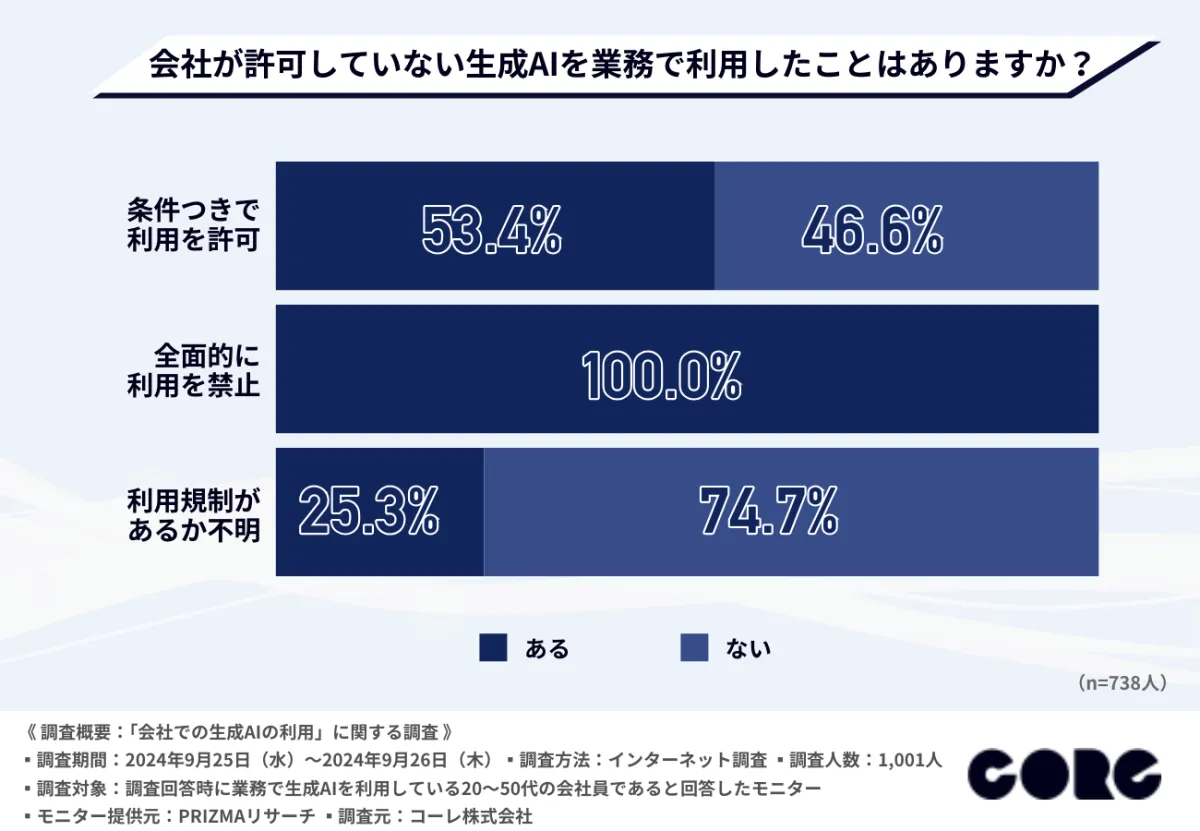

この調査は、業務で生成AIを活用している20代から50代の会社員1,001名を対象に行われました。調査期間は2024年9月25日から26日まで。結果として、調査対象者の約53.4%が、所属する会社が許可していない生成AIを利用した経験があると回答しています。これは、情報漏洩やリスク管理が不十分であることを示唆しています。

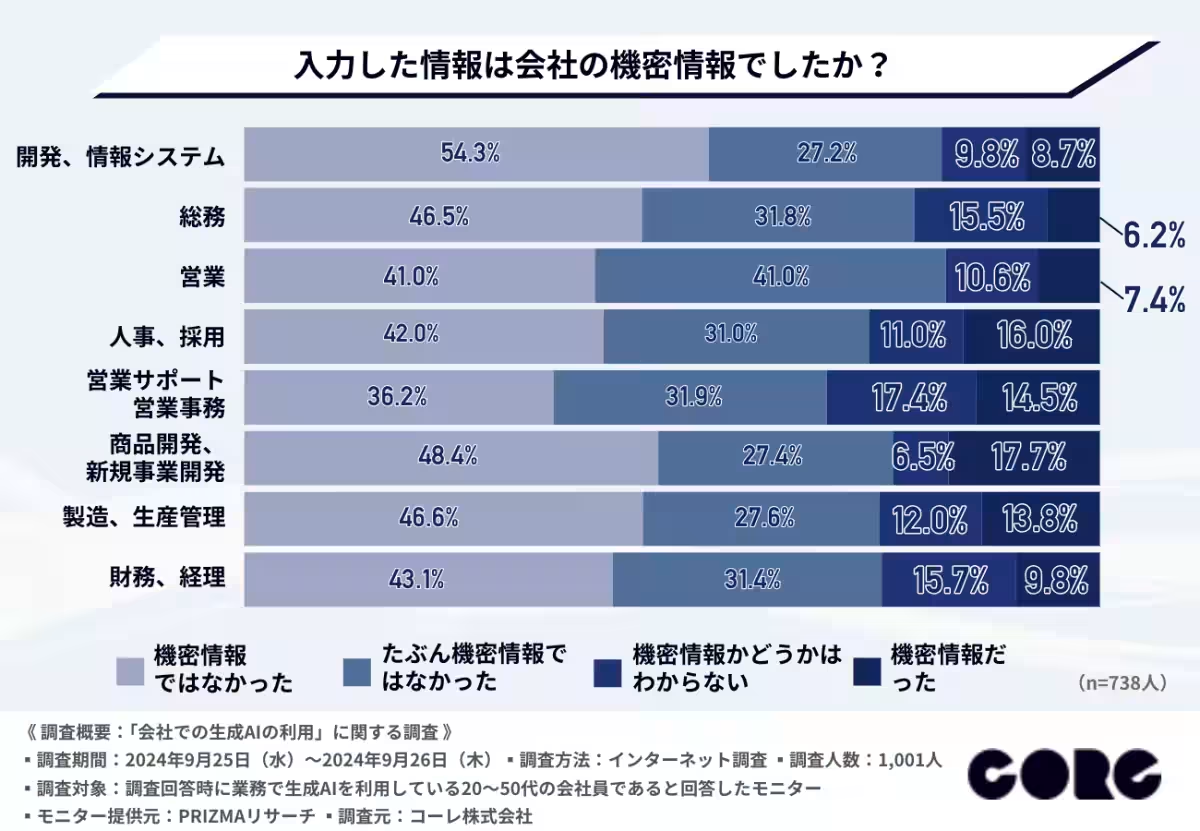

従業員規模と職種の傾向

調査結果によると、業務で生成AIを利用している方は主に「開発、情報システム」「総務」「営業」などの職種に集中していることがわかりました。特に、会社員の従業員数が多い企業(5,001人以上)からの回答が目立ち、リスク管理体制の強化が急務であることを示しています。

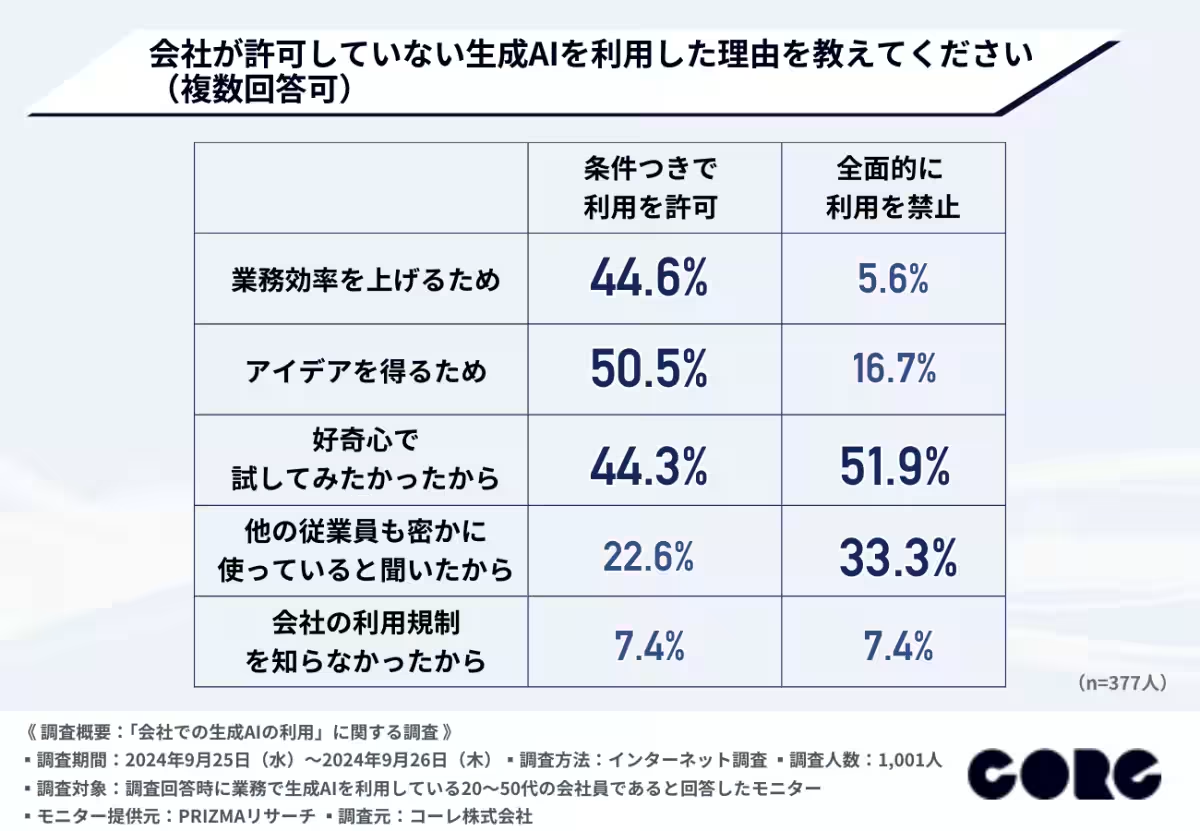

シャドーAIとその理由

シャドーAIとは、公式に認められていない生成AIを勝手に使用することを指します。この不正使用は、特に業務効率の向上やアイデア取得を目的としています。調査結果では、約47%の回答者が「アイデアを得るため」、42.9%が「業務効率を上げるため」といった理由でシャドーAIを活用していると回答しています。こうしたことが、従業員が生成AIの利用に際して抱えるリスクや懸念を裏付ける結果です。

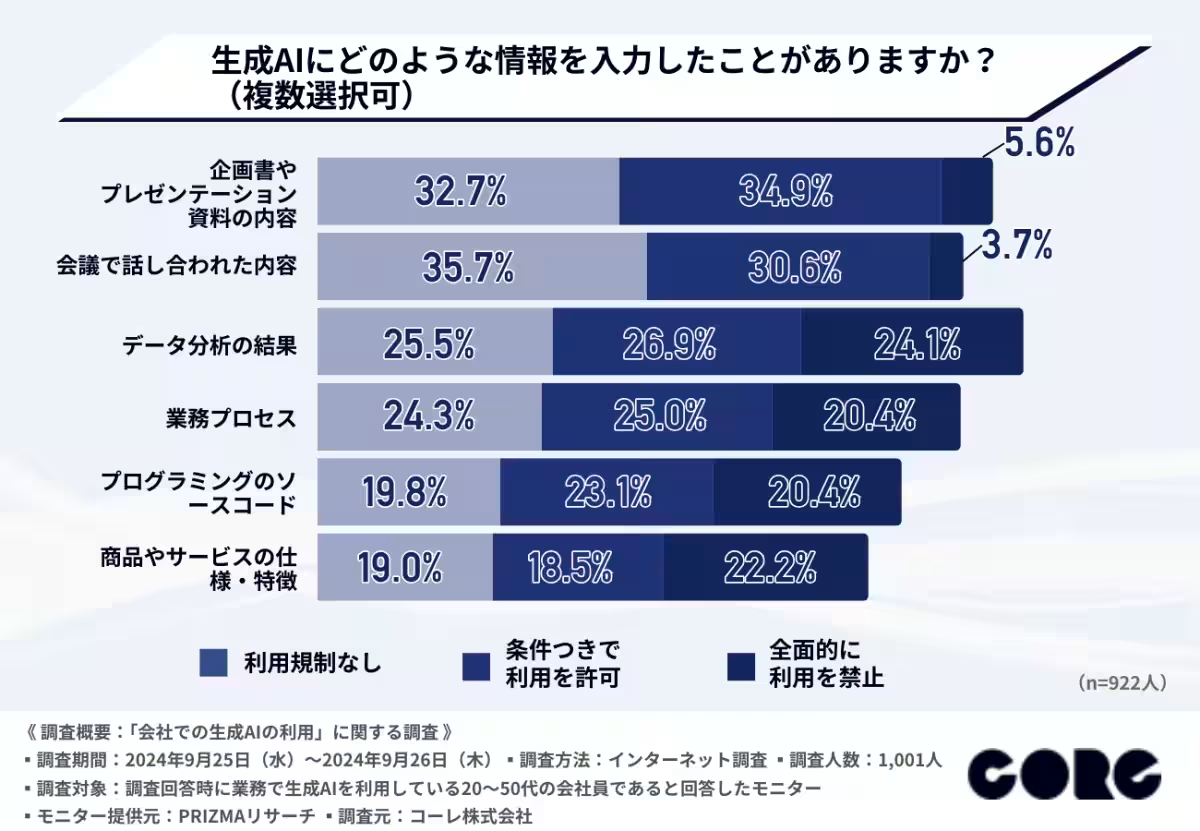

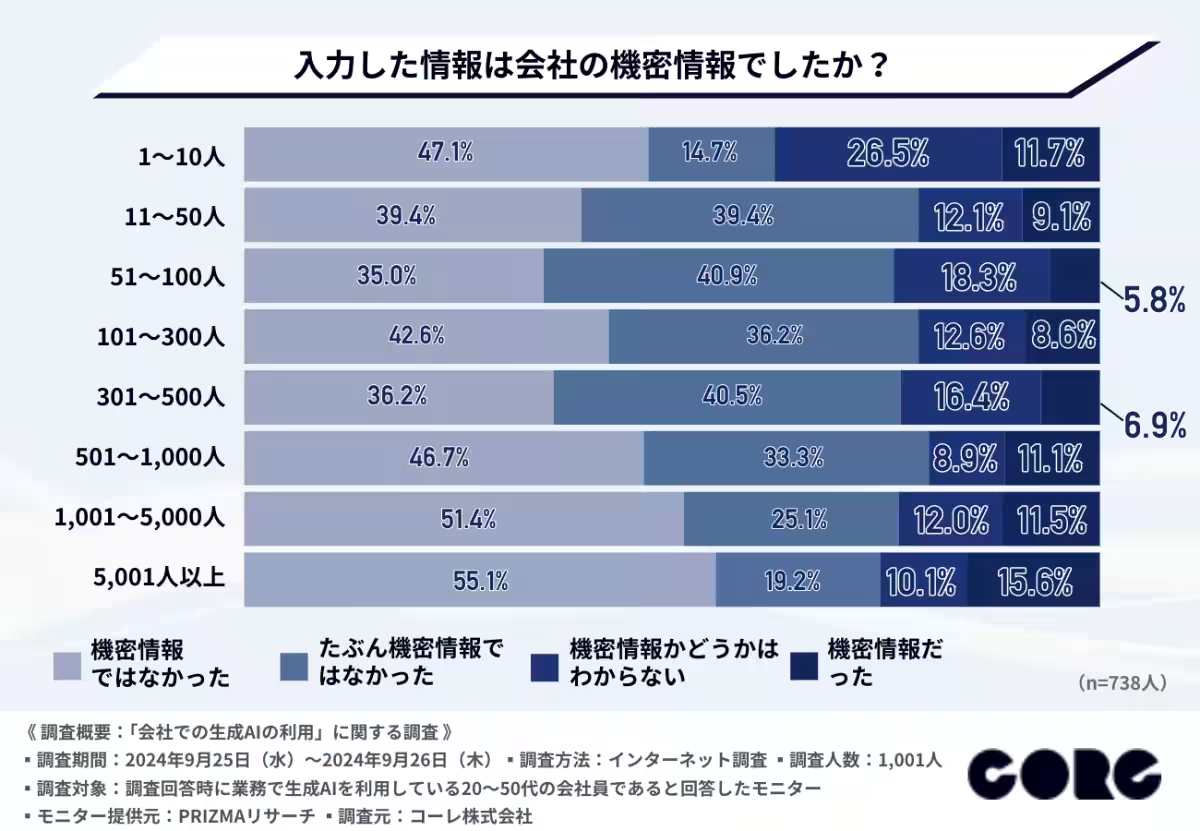

入力される情報の内容

さらに、生成AIに入力された情報の中には、機密性の高い内容が含まれていることが懸念されます。調査によると、約1割の従業員が自らの入力情報が機密情報であると認識しつつ、生成AIに情報を入力したと答えています。これは情報管理上の重大なリスクであり、企業には従業員への教育やガイドラインの強化が必要です。

生成AIを使った主な業務内容

- - 文章作成や調べ物

- - プレゼン資料作成のためのたたき台

- - 商品開発のアイデア

- - 経理に関する計算業務

こうした業務は、密かに生成AIを利用することで生じるリスクをさらに高めています。

企業におけるリスクの認識

調査では、生成AI利用に伴うリスクとして「情報漏洩」が48.7%、次いで「権利侵害」が43.3%、さらには「事実とは異なる情報の生成(ハルシネーション)」が41.4%となりました。これらのリスクは、企業全体のセキュリティ意識向上に直結しており、企業はより強固なコンプライアンス体制を構築する必要があるといえます。

今後の企業の取り組み

生成AIは今後も企業の業務改善の中核を担うと考えられます。しかし、シャドーAIの実態を無視することはできません。企業は、生成AIの利用に対するガイドラインを策定しつつ、従業員が自発的に生成AIを善用できる環境を整えることが求められます。そのために、生成AIリテラシーの向上とともに、実際の利用状況を見据えた柔軟な対応が重要です。

今後も多くの企業が生成AIの導入を進めていく中で、しっかりとした規制や教育がなければ、情報の漏洩や不正使用のリスクは高まる一方です。したがって、管理体制の整備や従業員教育が、会社の成長に不可欠なのです。

会社情報

- 会社名

- コーレ株式会社

- 住所

- 東京都新宿区新宿4-1-6JR新宿ミライナタワー18階

- 電話番号

- 050-5276-8115

トピックス(IT)

【記事の利用について】

タイトルと記事文章は、記事のあるページにリンクを張っていただければ、無料で利用できます。

※画像は、利用できませんのでご注意ください。

【リンクついて】

リンクフリーです。