生成AIの利用に潜むリスクとセキュリティ意識を探るNordVPNの調査

生成AIの利用に潜むリスクとその対策

最近、生成AIの利用が急速に広がっています。しかし、その一方で、そのリスクを理解している人は少ないという報告があります。特に、日本国内では生成AIの使用に関するプライバシーリスクへの認識が乏しく、個人情報の漏洩が懸念されています。ここでは、NordVPNが実施した調査をもとに、生成AIのリスクとその対策について詳しく見ていきます。

生成AI利用者の実態

世界で約10%、8億人以上がChatGPTなどの生成AIを利用している現状、日々多くのユーザーがその便利さを享受しています。しかし、同時に多くの人が情報漏洩というリスクを無自覚に抱えていることが主な問題です。特に、プライバシーの保護が求められる中、個人情報を含む情報をAIに提供している実態が浮き彫りになりました。

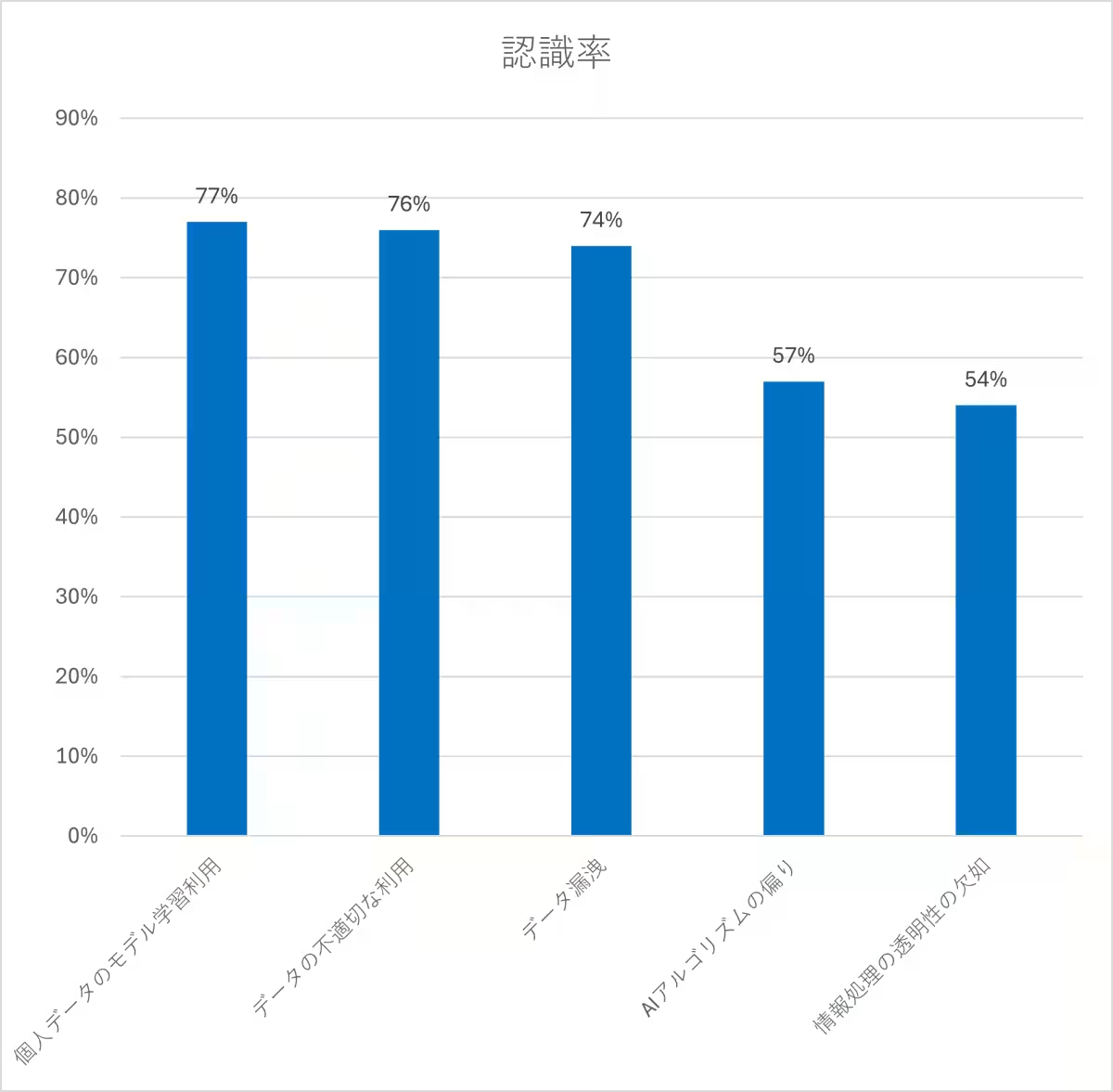

調査の結果

NordVPNの調査では、526人の日本人を対象に、生成AIのセキュリティ意識について分析しました。驚くべきことに、「業務でAIを活用する際のプライバシーリスクを理解している」と答えたのはわずか10%。ただし、個々のリスク項目については認識が高く、「個人データがAIの学習に利用されるリスク」が77%、「提供データの不適切利用」が76%、「データ漏洩の可能性」が74%といった結果が出ました。これにより、ユーザーはリスクの存在を認識しているものの、具体的にはどのように対処すべきかについての理解が不足していることが分かります。

ChatGPTが「相談窓口」に

生成AI、特にChatGPTは多くのユーザーにとって「デジタル生活の相談相手」となっています。ユーザーは、位置情報やSNSのプロフィール、氏名、金融情報などをAIに入力することが多いことが調査によって判明しました。そのため、一見無害に思える質問が、サイバー犯罪のターゲットとなるリスクを抱えることもあります。

セキュリティに対する関心

調査の中で、ユーザーがAIに寄せる質問にはフィッシング詐欺やスミッシングへの対処法、公共Wi-Fiの安全性、LINEアカウントのハッキング対策など、実生活に密着した具体的なセキュリティ関連の内容が多く見られました。AIの利便性は高いものの、情報漏洩リスクへの理解が十分でないことが、今後の大きな課題として浮かび上がっています。

セキュリティ対策の提案

NordVPNの最高技術責任者であるマリユス・ブリエディス氏は、生成AIを安全に活用するために、以下の3つの対策を推奨しています。

1. 個人情報を含む質問を避けること

生成AIは外部サービスであるため、個人情報を入力しない意識が重要です。対策として、送信前に内容を見直し、意図せずに自分や他人の情報が含まれていないか確認することが大切です。

2. 学習利用設定の変更

多くの生成AIツールには、情報を学習に活用する設定があります。この設定はできるだけオフにし、機密性の高い内容はAIに相談しないことが望ましいです。

3. VPNを活用して通信を暗号化する

公共Wi-Fiやセキュリティが不十分なネットワークを利用する際には、VPNを使用することで通信内容を暗号化し、第三者からの傍受を防ぐことが可能です。これにより、IPアドレスや位置情報も保護され、より安全にAIツールを利用できます。

まとめ

生成AIの活用が進む中で、プライバシー意識の教育と適切なセキュリティ対策が求められます。NordVPNの調査結果を踏まえ、今後はより多くの人々がデジタル情報の処理におけるリスクを意識し、 saferな利用法を実践していくことが必要です。利用者としての自覚を持ち、情報を守るための行動を心がけることが、あらゆるリスクを軽減する第一歩です。

会社情報

- 会社名

- Nordvpn S.A.

- 住所

- Fred. Roeskestraat 115 1076 EE Amsterdam, The Netherlands

- 電話番号

トピックス(IT)

【記事の利用について】

タイトルと記事文章は、記事のあるページにリンクを張っていただければ、無料で利用できます。

※画像は、利用できませんのでご注意ください。

【リンクついて】

リンクフリーです。