ストックマークが日本語特化型LLM「Stockmark-2-100B-Instruct-beta」を発表

ストックマーク、1,000億パラメータの日本語特化型LLMを発表

ストックマーク株式会社は、経済産業省とNEDOの支援を受けて、1,000億パラメータの大規模言語モデル「Stockmark-2-100B-Instruct-beta」を発表しました。このモデルは日本語に特化しており、国内の生成AI開発力向上を目指す取り組みの一環として開発されました。

開発背景

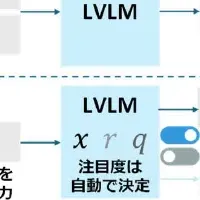

本モデルの開発は、プロジェクト「GENIAC」に基づくもので、国内の企業が生成AIの開発に必要なリソースを得られるよう支援が行われています。ストックマークは、同プロジェクトの第1期と第2期の両方で採択され、特に第1期では、ハルシネーションを大幅に抑止した「Stockmark-LLM-100b」を開発。これに続く第2期では、複雑なビジネスドキュメントの理解を可能にするマルチモーダルモデルの開発が進行中です。

「Stockmark-2-100B-Instruct-beta」はその第2期の成果の一つで、信頼性と高精度を持った日本語対応のモデルとして位置付けられています。特に、ビジネスドメインでの利用を想定し、高度な日本語能力とビジネス知識を兼ね備えています。

モデルの特徴

この新たに公開されたモデルは、フロムスクラッチで開発が行われております。従来のモデルを基にするのではなく、自社独自の手法で設計されたことが大きな特徴です。また、商用利用も可能として、オープンソースで利用できることから、多くの企業での導入が期待されています。

当モデルは、既存の日本語対応LLMと比較して高い性能を有しており、日本のビジネスに特化した知識保持度についても評価が行われました。実際、当社が開発した「Stockmark Business Questions」を使った評価では、正解率が90%に達し、同等のモデルであるGPT-4oを上回りました。

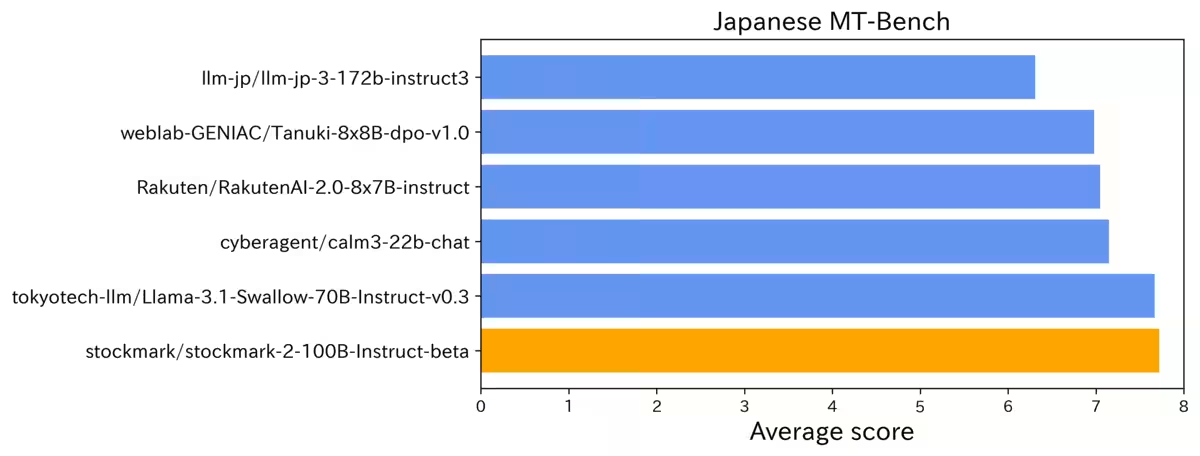

性能評価

モデルの性能は、日本語MT-Benchを使用して評価され、国内の他のフロムスクラッチ開発モデルと比較して一定の差を持って高い性能を示しました。また、Meta社の「Llama3.1 Swallow」との比較でも「Stockmark-2-100B-Instruct-beta」が優れた結果を示しています。

今後の展望

今後、ストックマークはこのモデルの精緻化を進めるとともに、企業が扱う複雑なドキュメントに対する理解を深めるためのマルチモーダル学習にも注力します。さらに、産業技術総合研究所とも共同研究を行い、AI技術の発展に寄与することを目指しています。

まとめ

ストックマーク株式会社は、「価値創造の仕組みを再発明し、人類を前進させる」というミッションのもと、AI技術を駆使して企業変革を支援しています。今回発表された「Stockmark-2-100B-Instruct-beta」は、ビジネス界でのAI活用に新たな可能性を秘めたモデルです。この優れたパフォーマンスを持つLLMが、今後どのように企業の現場で活躍するのか、期待が寄せられます。

会社情報

- 会社名

- ストックマーク株式会社

- 住所

- 東京都港区南青山 1 丁目12-3LIFORK MINAMI AOYAMA S209

- 電話番号

トピックス(IT)

【記事の利用について】

タイトルと記事文章は、記事のあるページにリンクを張っていただければ、無料で利用できます。

※画像は、利用できませんのでご注意ください。

【リンクついて】

リンクフリーです。