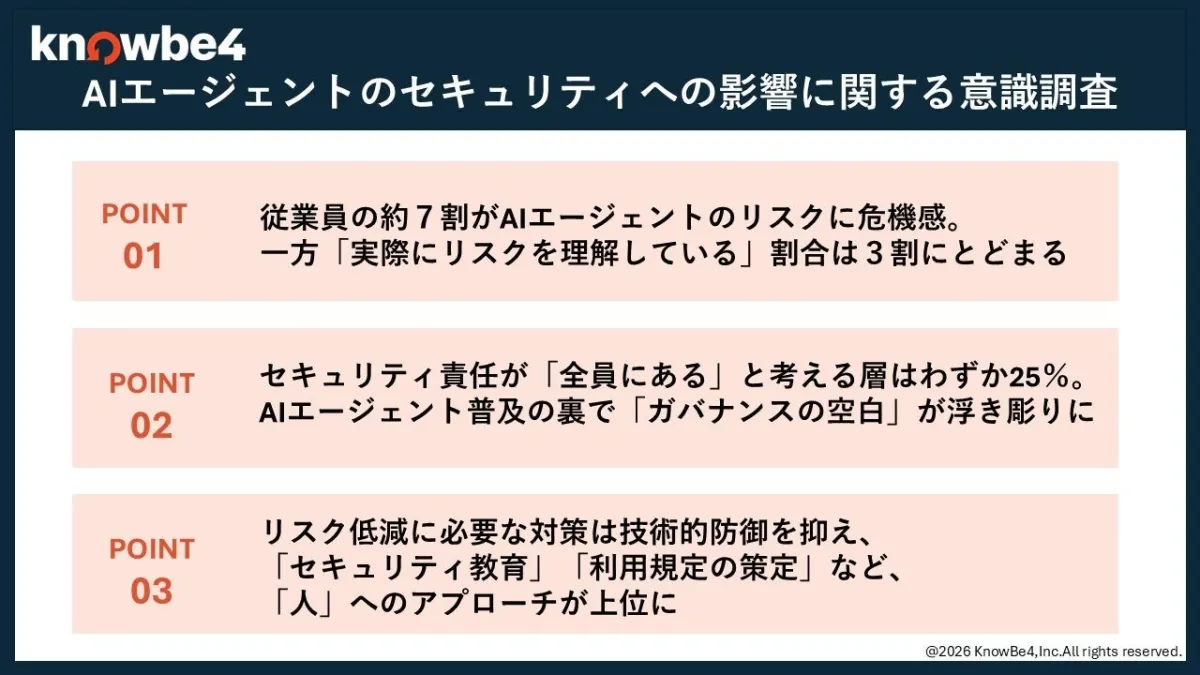

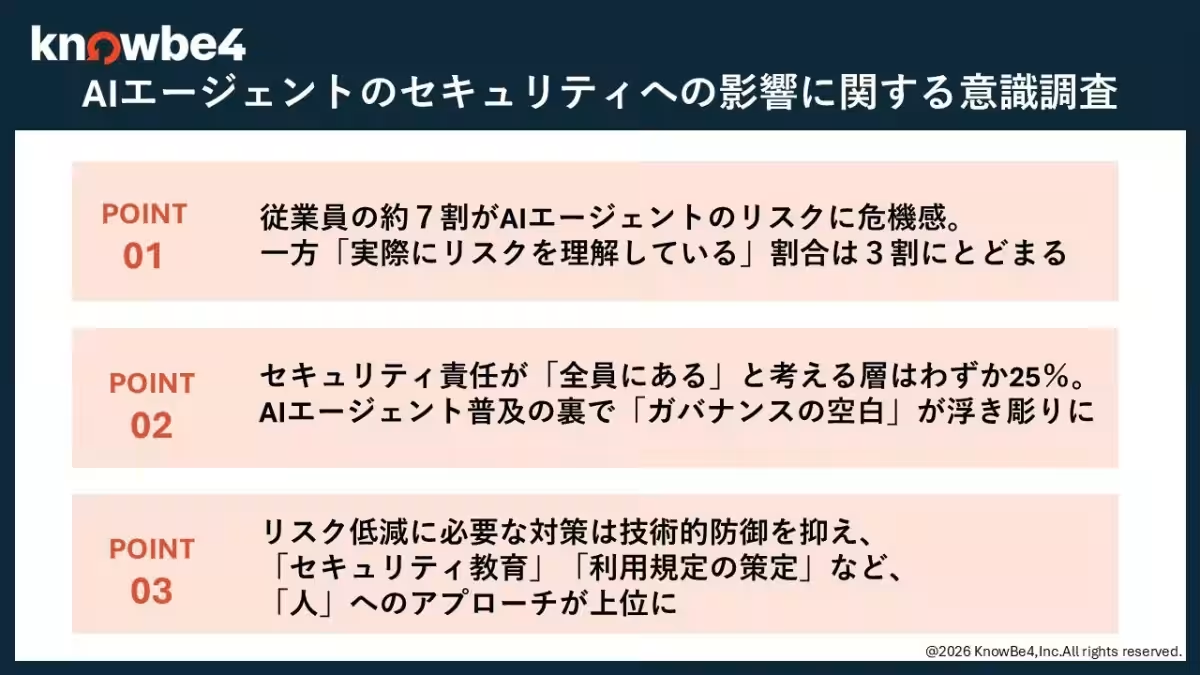

AIエージェントによるセキュリティリスクとその理解の現状は?

AIエージェントの普及とリスク意識の現状

はじめに

デジタル化の波が押し寄せる中で、AIエージェントの利用が急速に進展しています。しかし、その普及に伴い、セキュリティの懸念も高まっています。KnowBe4 Japanが実施した最新の調査によると、従業員の間でのAIエージェントに対するセキュリティ意識には課題が見えてきました。ここではその調査結果を基に現状を考察します。

調査の背景

これまでの調査では生成AIに関するセキュリティの影響が議論されてきましたが、AIエージェントはさらに自律的にタスクを遂行するツールとしてその存在感を高めています。今回の調査は、企業や団体に勤務する従業員を対象に、AIエージェントに対するセキュリティ意識と実態を探ることを目的に実施されました。

AIエージェントの利用状況

調査において、回答者の40%が自組織にAIエージェントを既に導入していると報告。また、70%が今後の導入が拡大すると予測しており、これらの結果は実に積極的な利用意向を示しています。しかし、昨年の生成AI調査と比較すると、専門性や自律性の高いAIエージェントは慎重に導入が進められていることも分かりました。

セキュリティリスクへの意識

AIエージェント利用に伴うセキュリティリスクについて、68%の回答者が「大きい」と認識しているとしています。特に懸念されるのは「機密情報の漏洩」や「著作権侵害」であり、これらはヒューマンリスクとも言えるもので、根本的には人の判断や操作に依存しているのが現状です。この事実は、AI技術が進化してもなお、「人」によるリスク管理が重要であることを示しています。

リスク理解の停滞

興味深いことに、AIエージェントを使う従業員のセキュリティリスクに関する理解度は、わずか30%にとどまります。前年の調査結果と大差ないことから、リスクに対する認識が追い付いていないフラストレーションが感じられます。これは、組織全体における教育体制の充実が必須であることを物語っています。

セキュリティ責任の分配

AIエージェント使用時のセキュリティ責任を「全員にある」と考える回答者は25%に過ぎません。これは、「責任の所在」が曖昧であることを示しており、業務の自律化に伴う「ガバナンスの空白」が顕在化しています。この空白が事故や問題を引き起こしやすくなる危険性があるため、役割分担や責任の明確化が求められます。

AI悪用の潜在的脅威

AIを悪用した攻撃の脅威を「感じる」と回答した人は83%に達しました。特に「フィッシングメール」や「ランサムウェア」など、サイバー攻撃の高度化への警戒が強まりつつあります。これらは、ソーシャルエンジニアリング手法によるもので、AIの進化とともにその威力が増す傾向が見受けられます。

強化すべき対策

調査では、AIエージェント利用に対するリスク低減策として、「セキュリティ教育やリテラシー教育の実施」が最も多く選ばれました。続いて「利用規定の策定と周知」が重要視されています。これは、技術的対策だけでなく、人間への教育と意識向上が重要であることを強調しています。

まとめ

KnowBe4 Japanの力 一浩社長は、従業員のリスク理解が弱い現状を憂慮し、正しいルールを理解しないままリスクに直面する“ガバナンスの空白地帯”の危険性を指摘しています。今後は、安易なシステム依存からの脱却と、組織全体での倫理観や判断力を高める必要があります。セキュリティは「やらされるもの」ではなく「組織の当たり前」として根付かせることが求められます。

教育体制の見直しと、正しいリスク管理のためのガイドライン策定が急務であり、これが2026年までの重要課題となるでしょう。AIエージェントの進化が進む中で、より強固なヒューマン・ファイアウォールを築くための努力が求められます。

会社情報

- 会社名

- KnowBe4 Japan 合同会社

- 住所

- 東京都港区赤坂9-7-1ミッドタウン・タワー 18F

- 電話番号

関連リンク

サードペディア百科事典: 東京都 港区 AIエージェント セキュリティリスク KnowBe4 Japan

Wiki3: 東京都 港区 AIエージェント セキュリティリスク KnowBe4 Japan

トピックス(IT)

【記事の利用について】

タイトルと記事文章は、記事のあるページにリンクを張っていただければ、無料で利用できます。

※画像は、利用できませんのでご注意ください。

【リンクついて】

リンクフリーです。