生成AI利用に潜む危険:35%の利用者がヒヤリハットを経験

生成AI利用に潜む危険:35%の利用者がヒヤリハットを経験

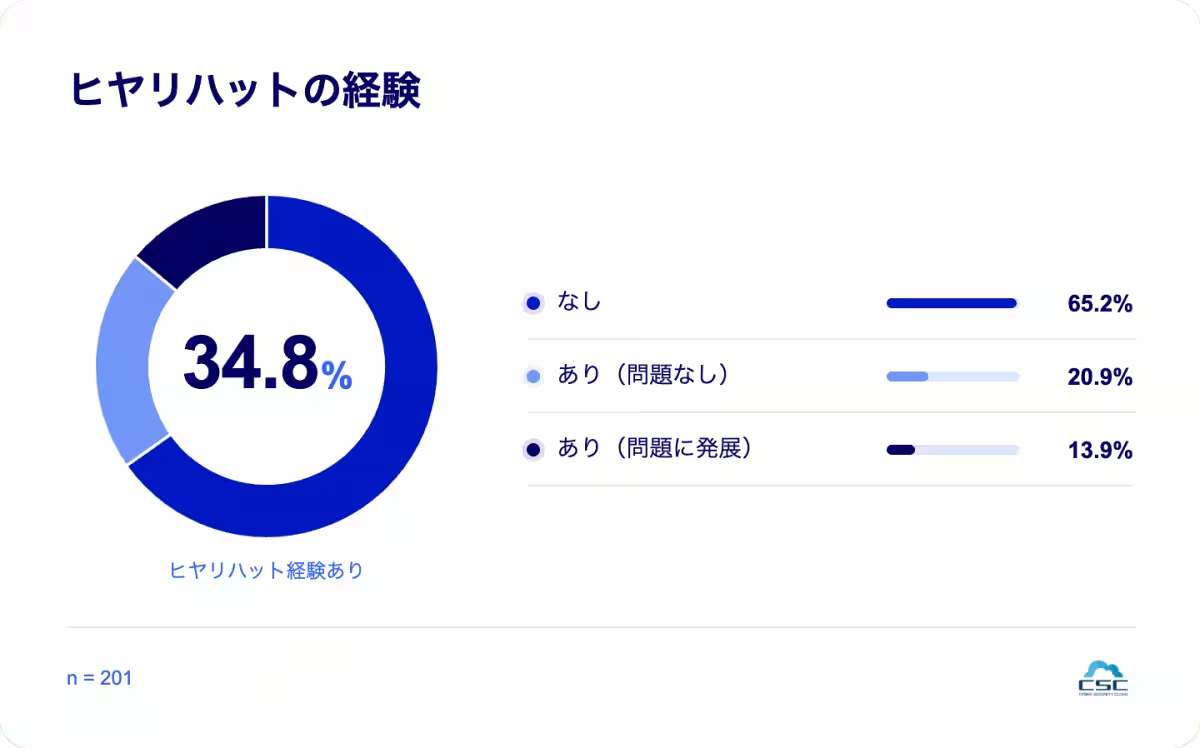

最近、株式会社サイバーセキュリティクラウドが実施した調査によると、業務で生成AIを活用する会社員の35%が「ヒヤリハット」を経験していることが分かりました。この数字は、急速に普及している生成AIの業務利用に伴うリスクを浮き彫りにしています。特に、企業側のガバナンス整備が追いついていない現状が影響しています。

調査の背景と目的

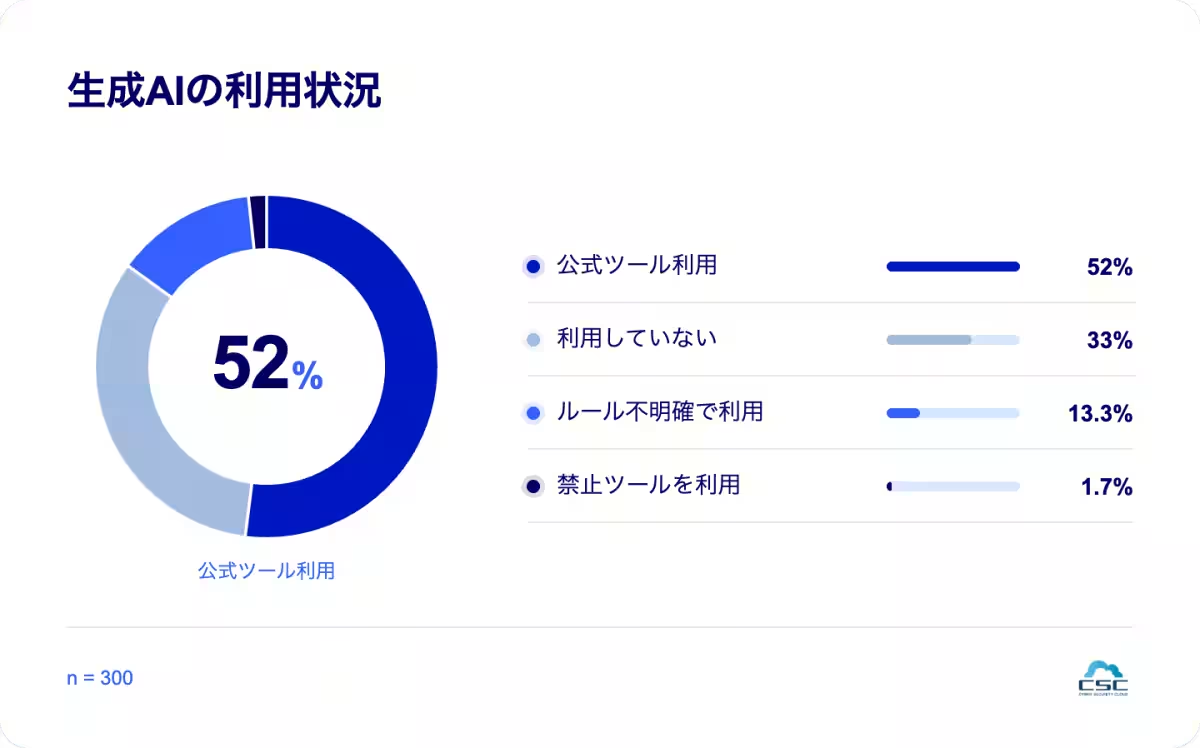

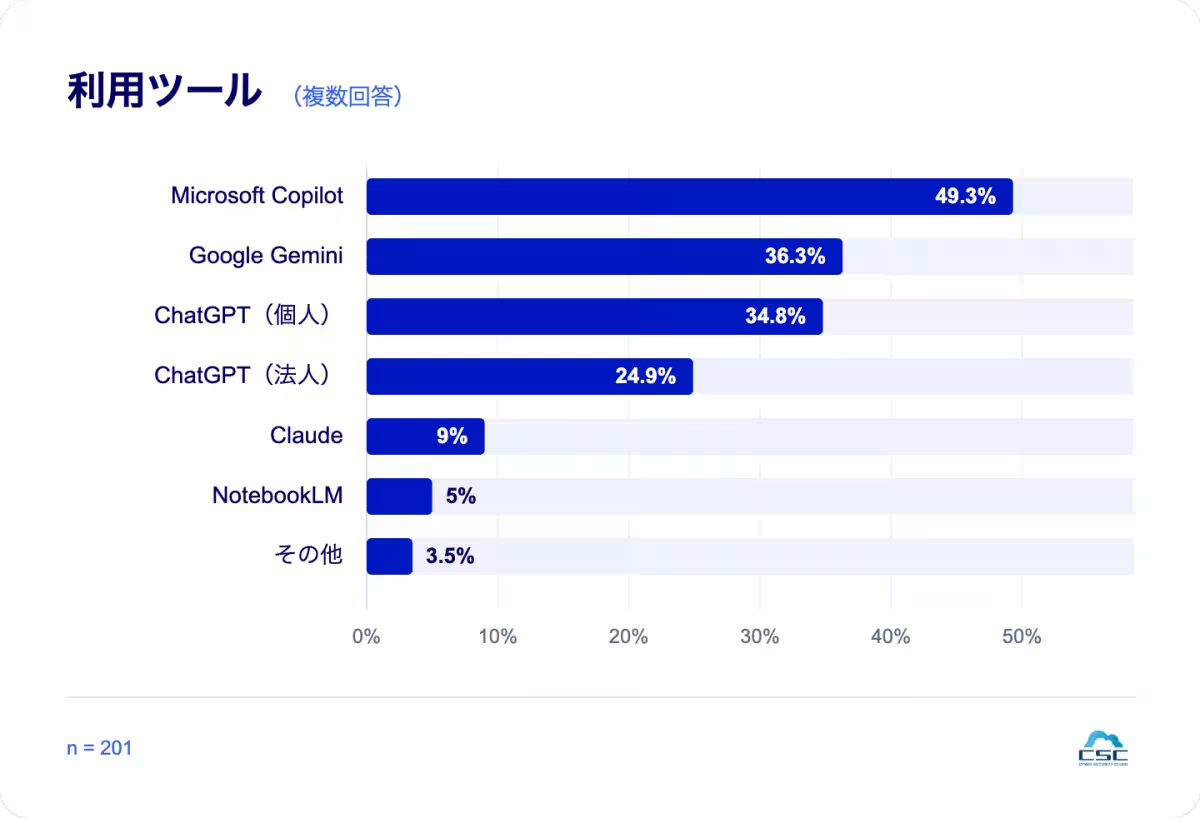

2026年4月、株式会社サイバーセキュリティクラウドは、PCを仕事で毎日使用する会社員300名を対象に生成AIの業務利用実態についての調査を実施しました。その結果、約67%の会社員が生成AIを業務利用していることが明らかになり、特にこの中で、企業が公式に認めているツールを使用しているのはわずか52%に過ぎない結果が浮かび上がりました。

このような状況下、多くの実務者が「シャドーAI」と呼ばれる、企業の管理下にないAIツールを使う実態が見られ、約15%の利用者がその状況にあります。

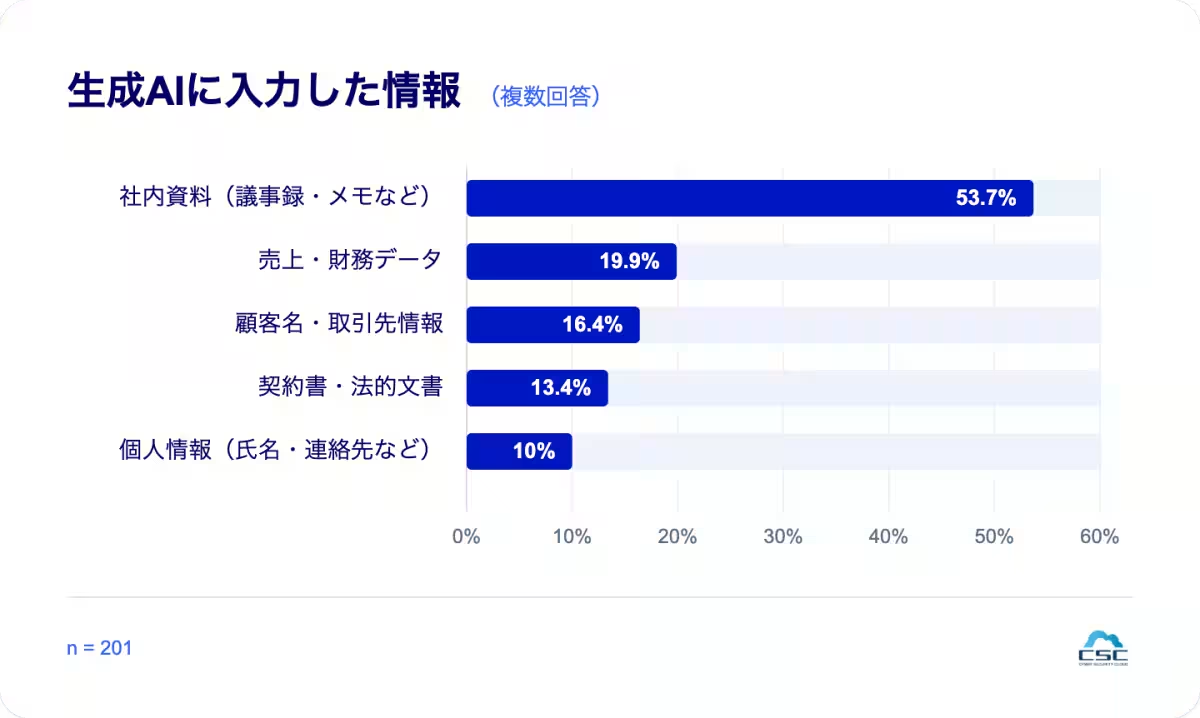

利用内容は機密情報が中心

また、調査によると、生成AIを利用している社員の半数以上が社内の機密情報や財務データをAIに入力した経験があることが分かりました。具体的には、約20%が財務・売上データを、約16%が顧客情報を入力したことがあると回答。さらに、契約書や法的文書に関しても約13%の社員が利用した実績があることが明らかになりました。このような機密情報を扱う際のリスク認知が不足している実態が浮かび上がっています。

ヒヤリハットとは何か

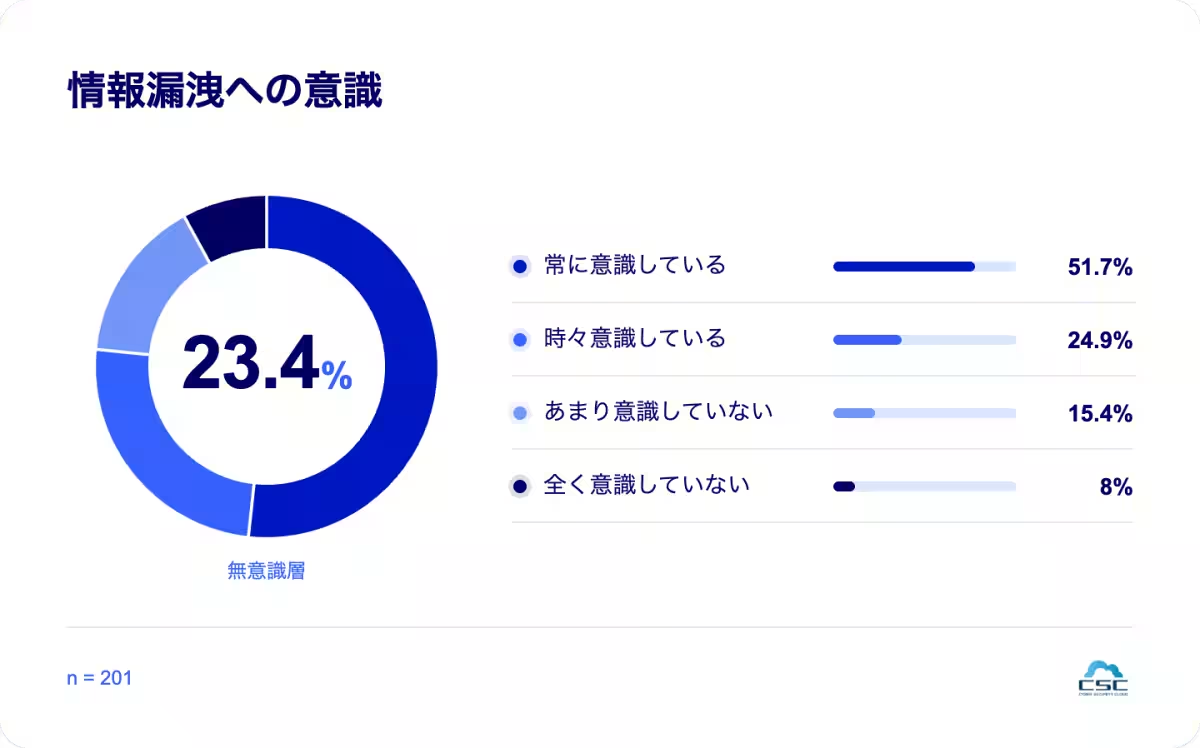

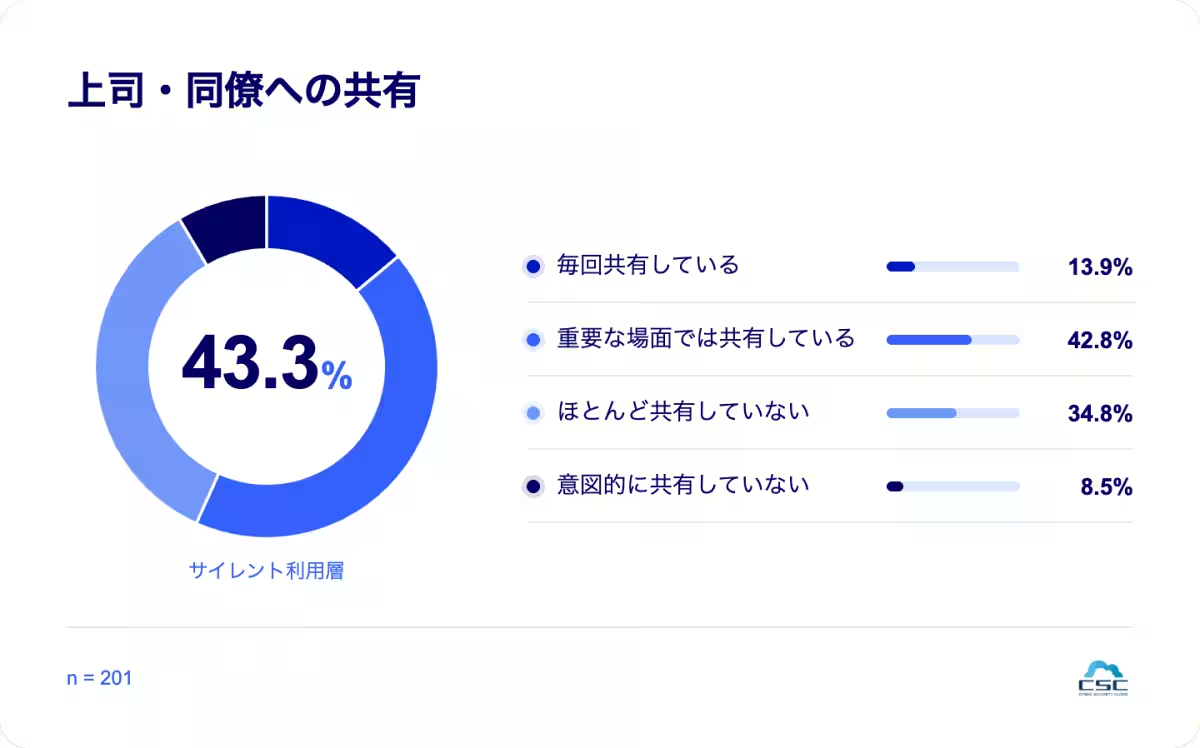

調査に参加した中で約35%の利用者が「ヒヤリとした経験」を持っており、このうち14%がその問題が実際に形になった事例を有しています。出力内容の確認や修正を行うことなく生成AIの成果物を業務で使用している割合は約37%に達し、生成AIへの過信がリスクを引き起こしている可能性があります。 AIを業務活用した実績を「ほとんど、または意図的に共有していない」と答えた割合は約43%で、こうした透明性の欠如はさらなるリスクを生む源となっています。

業務利用ルールの不備

調査結果から、約45%の社員が企業のAI利用ルールが「ない」または「わからない」と思っていることも判明しました。これにより、業務の現場で個人の判断に依存した運用が進み、致命的な失敗に発展する危険性が高まっています。

今後の対策

生成AIの業務利用を進める中で、企業側にはルールの整備と従業員への教育が不可欠です。これまでの調査は、生成AIの利用が急速に増加する一方で、企業がそれに伴うガバナンスを整備できていないことを示しました。安全な生成AIの利用を促進するためには、利用実態を可視化し、ルールを整え、従業員教育を行っていく必要があります。ガバナンスの不備から生じるリスクを軽減するため、企業は積極的に対策を講じる必要があります。

まとめ

この調査を通じてわかったのは、生成AIの利用は今後さらに広がる可能性が高いが、それに合わせたガバナンスやリスク管理の整備が不可欠であるということです。企業はリスクを認識し、効果的に生成AIを業務で活用するための環境整備を進める必要があります。こうした課題をクリアにすることが、安心安全な業務環境を作る一歩となるでしょう。

会社情報

- 会社名

- 株式会社サイバーセキュリティクラウド

- 住所

- 東京都品川区上大崎3-1-1JR東急目黒ビル 13階

- 電話番号

- 03-6416-9996

トピックス(IT)

【記事の利用について】

タイトルと記事文章は、記事のあるページにリンクを張っていただければ、無料で利用できます。

※画像は、利用できませんのでご注意ください。

【リンクついて】

リンクフリーです。