生成AIの利用に潜む不安と現状、業界の課題を探る新たな調査結果

生成AIの利用に潜む不安と現状、業界の課題を探る新たな調査結果

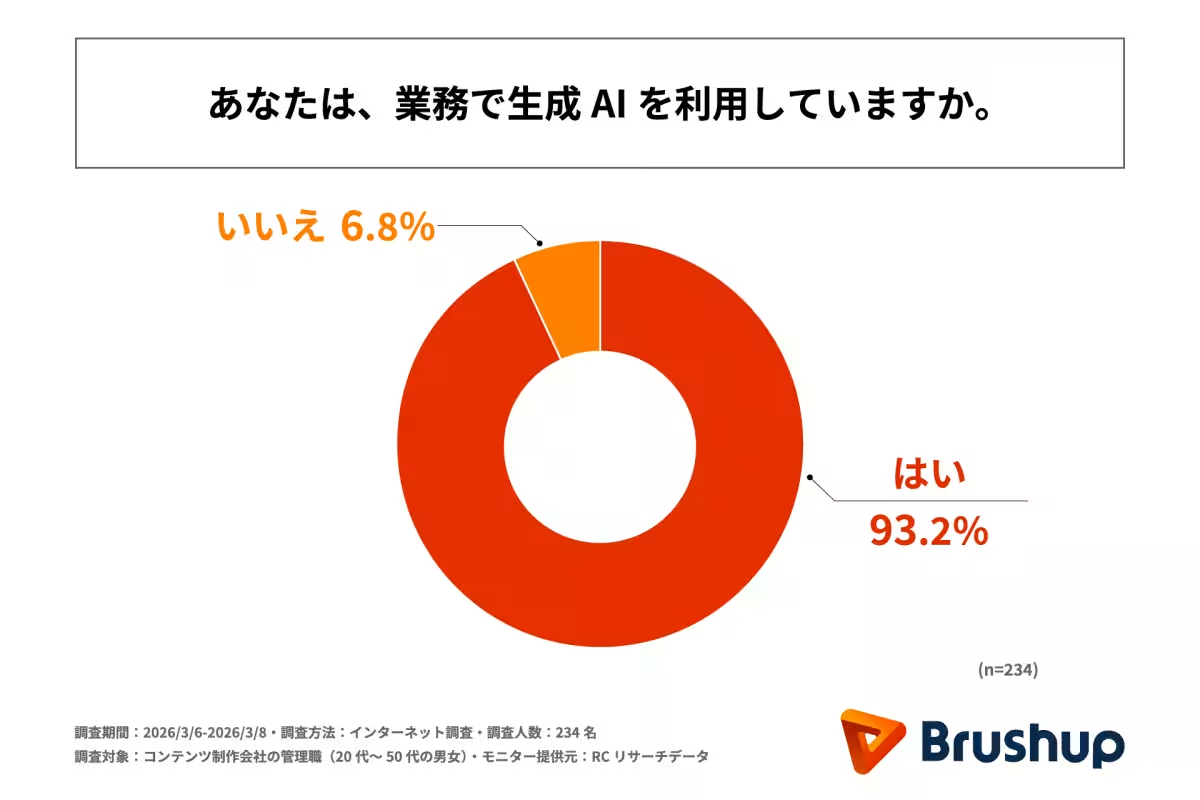

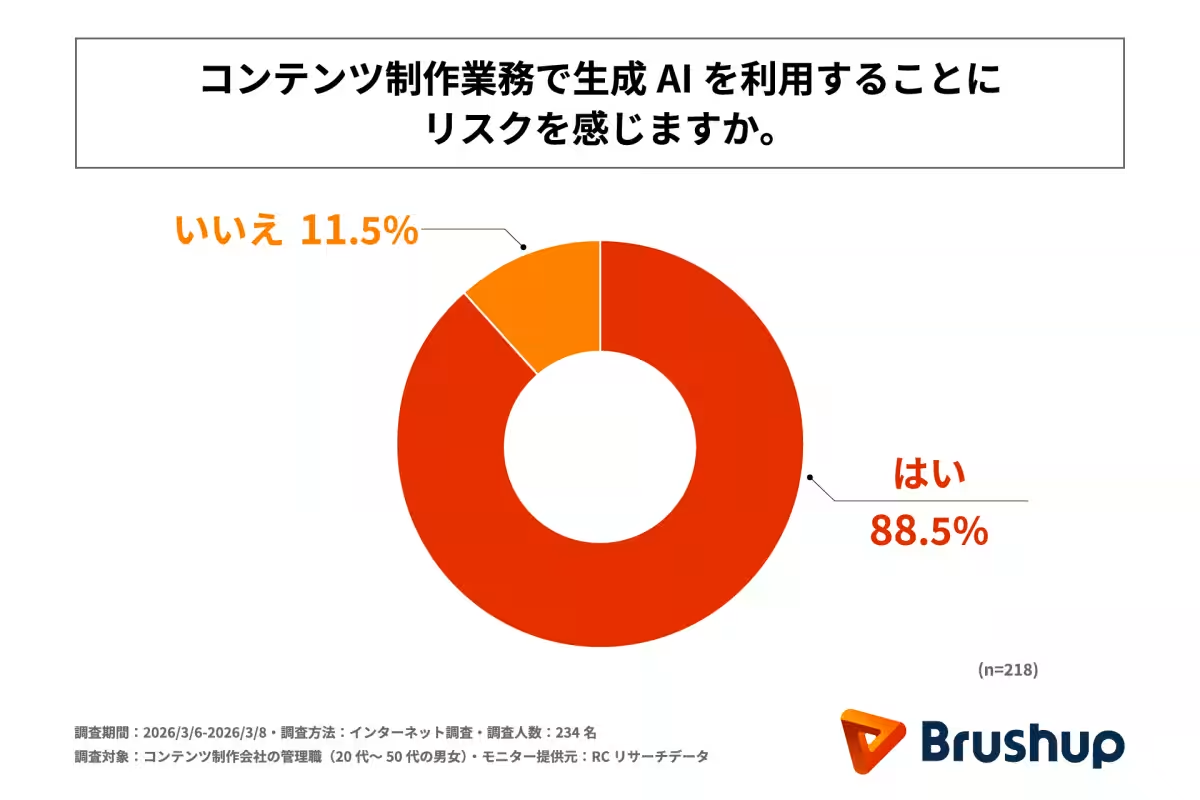

株式会社Brushupが施工した調査から、コンテンツ制作会社の管理職の約90%以上が業務で生成AIを利用していることが明らかとなりました。しかし、その一方で多くの人がリスクを感じているという実態が浮き彫りになっています。本記事では、調査結果を基に業界の現状と今後の展望について考察します。

調査背景と目的

新年度を迎え、企業の業務効率化やデジタル・トランスフォーメーション(DX)推進の一環として、生成AIの導入が急速に進んでいます。特にコンテンツ制作分野においては、その活用が著しく増えていますが、著作権や情報漏えいといったリスク管理の重要性も高まっています。しかし、現場における生成AIの実際の利用状況や管理体制がどのようになっているのかは未だ不明確な部分が多く存在します。そこで、Brushupはコンテンツ制作の管理職を対象に、「コンテンツ制作現場における生成AI運用体制に関する実態調査」を実施しました。

調査結果の概要

調査は2026年3月6日から8日の期間にインターネットを利用して行われ、234名の管理職が対象となりました。以下は調査結果の主なサマリーです:

- - 生成AIの利用率

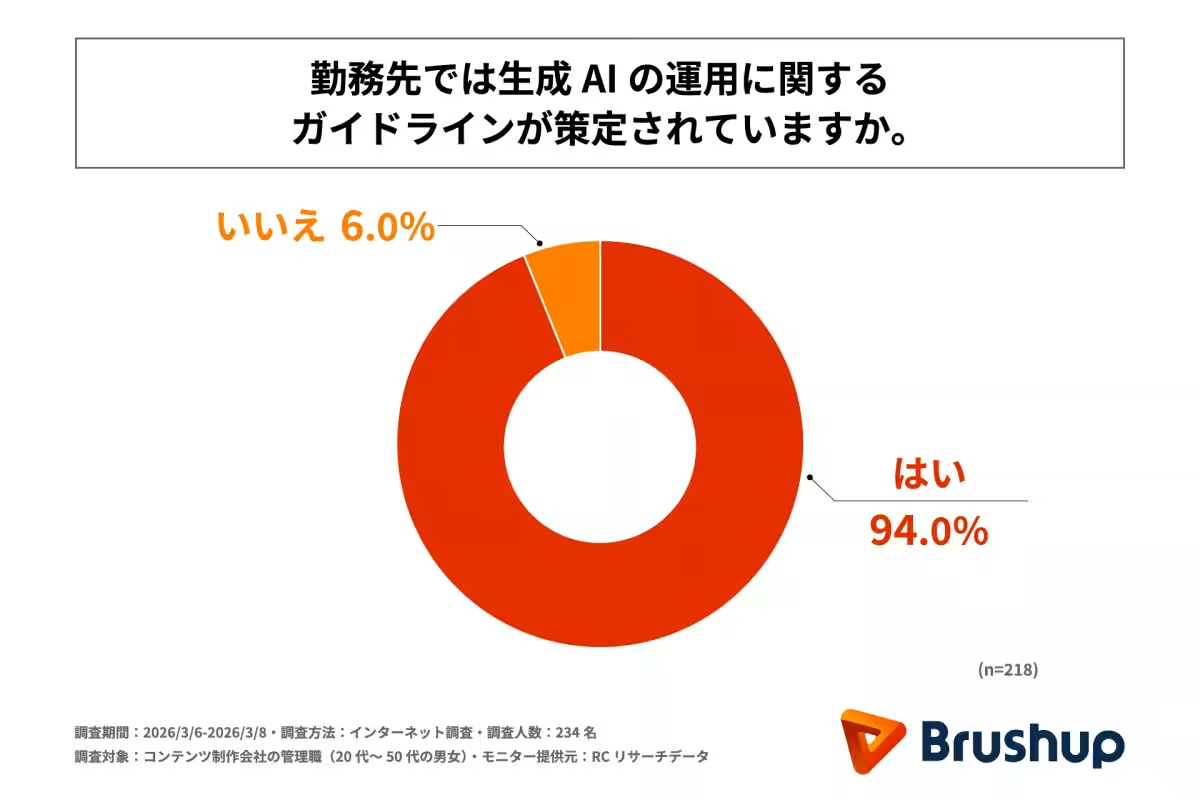

- - 運用ガイドラインの有無

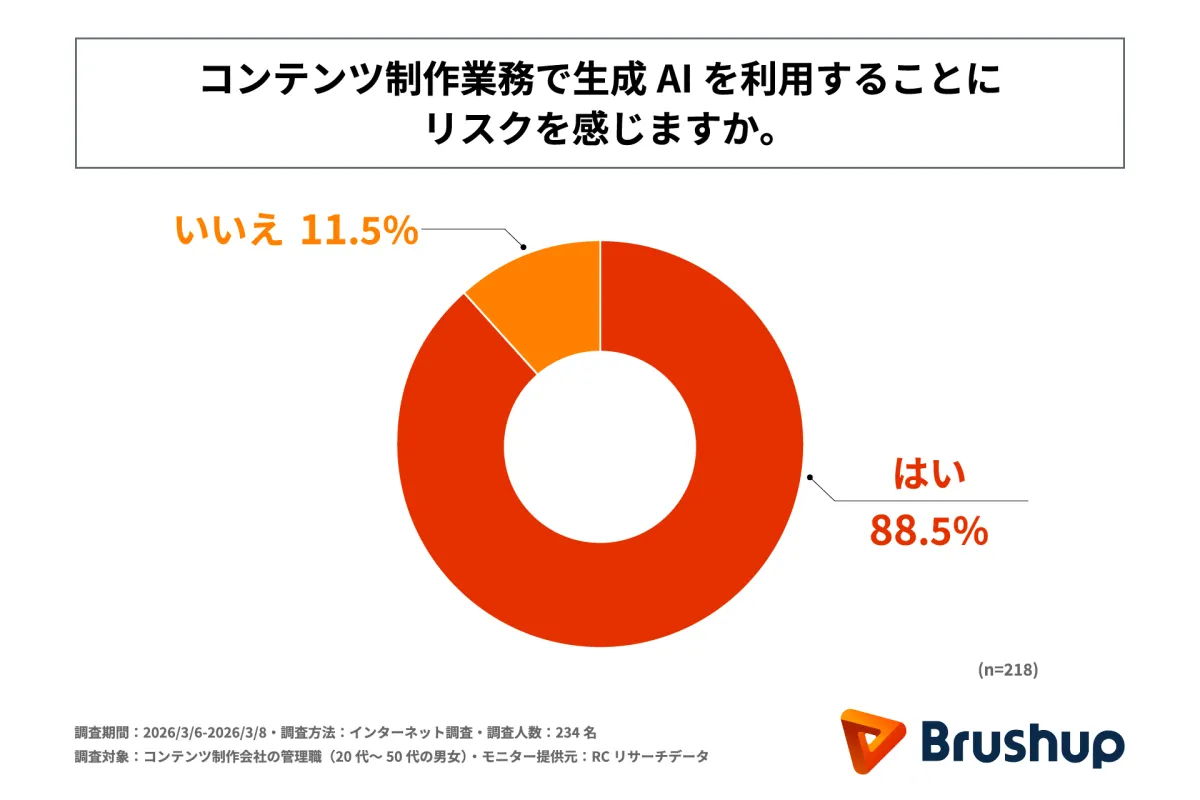

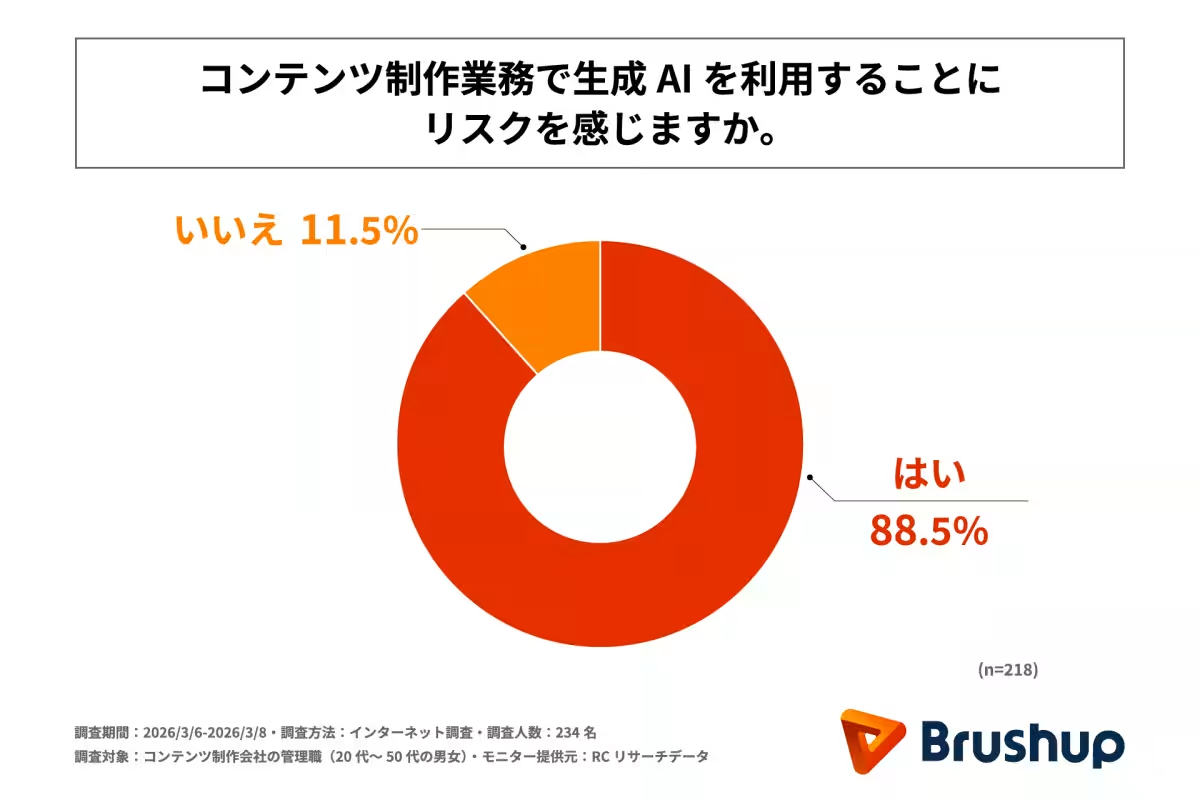

- - リスクの認識

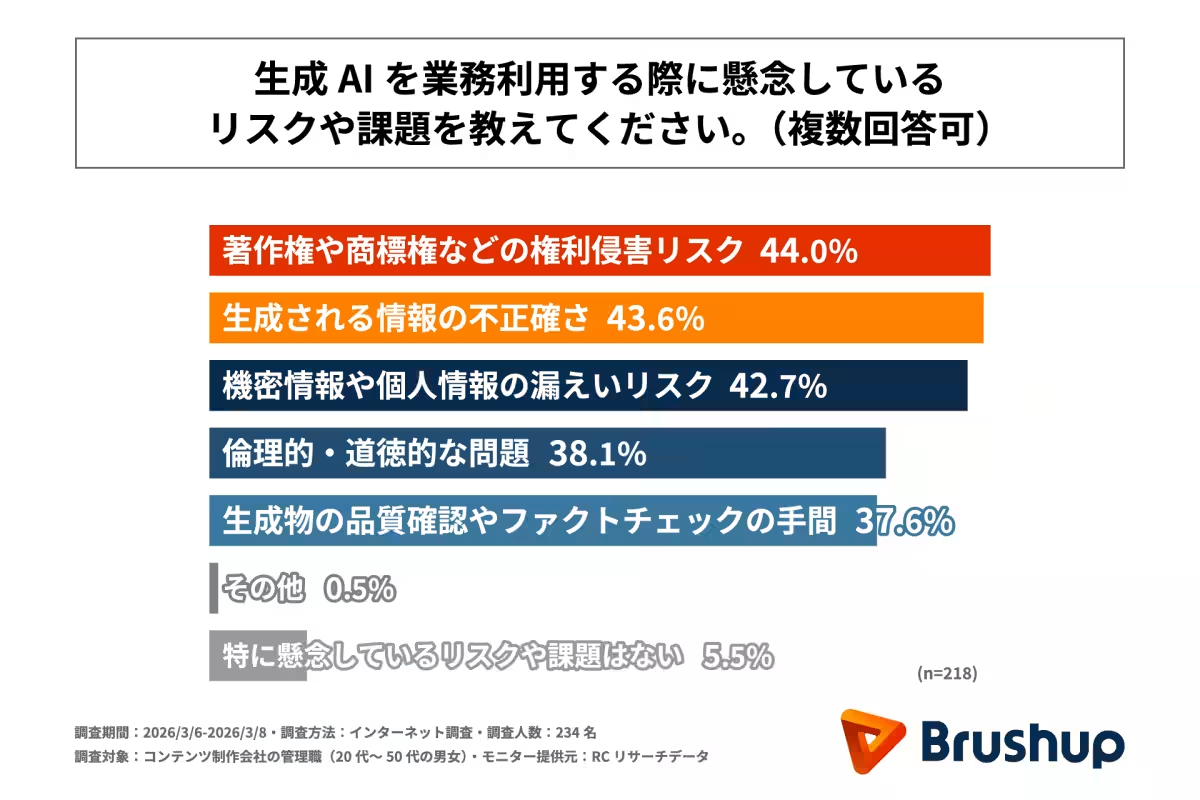

トップ3の懸念リスクとしては、著作権や商標権の侵害が最も多く、続いて情報の不正確さや機密情報の漏えいリスクが続きます。これらのリスクは、業務運用にどのような影響を及ぼし、どのように対応しているのか、さらなる分析が求められます。

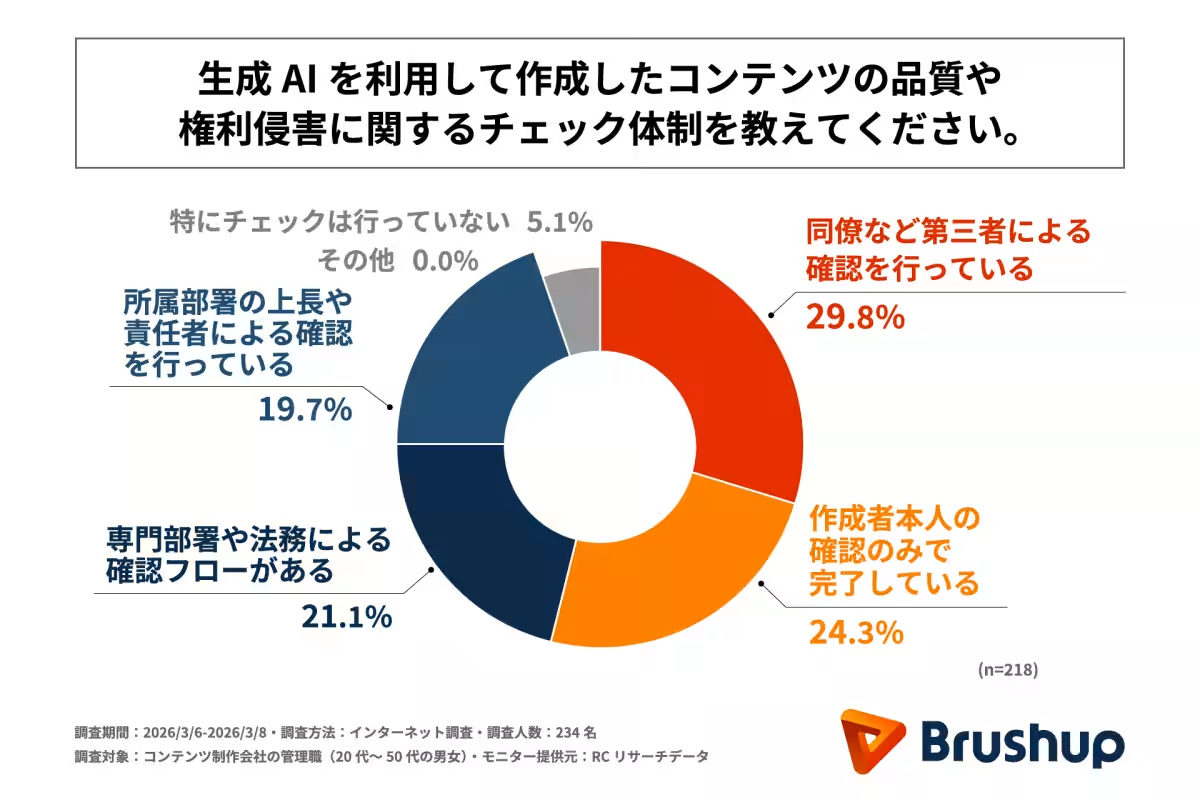

コンテンツ品質チェックの実態

調査によると、約30%の管理職が生成AIで作成したコンテンツの品質管理や権利確認は「制作者本人の確認のみ」または「行っていない」と回答しています。これは、チェック体制が十分に整っていないことを示す指標です。これに対し、「第三者による確認」や「専門部署による確認」が行われている場合も多く、実際にどう運用すべきかの模索が続いています。

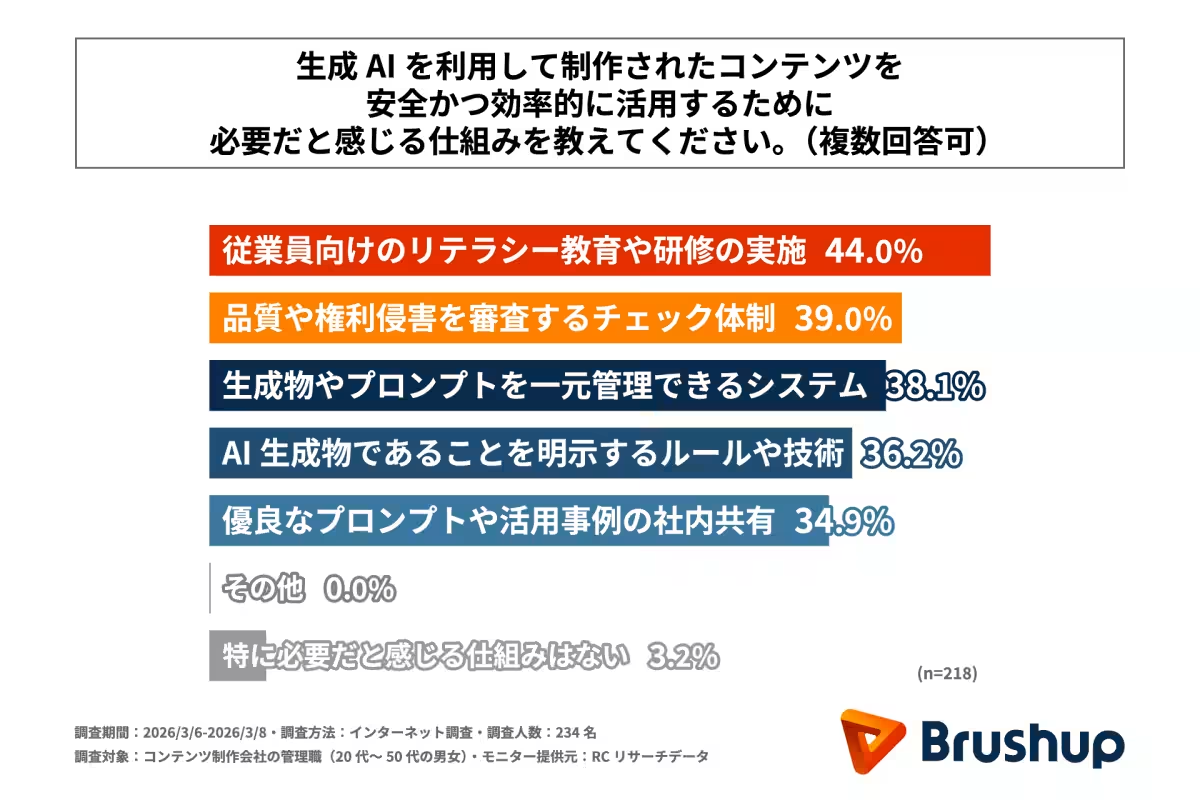

安全かつ効率的な生成AI利用に向けて

管理職の中で、生成AIを安全に活用するために欠かせないと感じている主な施策は二つに集約されました。第一は、従業員向けのリテラシー教育や研修の重要性、そして第二は品質や権利侵害をチェックする体制の整備です。このような仕組みを通じて、業務の効率性を高めると同時に、リスクを低減することが期待されています。

まとめ

調査からは、コンテンツ制作会社の管理職の大多数が生成AIの利用を行っているが、同時にリスクに対する強い不安を感じていることが明らかになりました。今後、まずは業界全体でのガイドラインの確立やスタッフの教育が重要であると指摘されます。Brushupの提供するプラットフォームは、こうした課題に対し効果的な解決策となる可能性があります。しっかりとしたチェック体制と安全な利用促進が、生成AI時代における新しいコンテンツ制作のプロセス確立においてますます重要な要素となるでしょう。

会社情報

- 会社名

- 株式会社Brushup

- 住所

- 大阪府大阪市北区曽根崎新地1-13-22御堂筋フロントタワー WeWork御堂筋フロンティア

- 電話番号

- 06-4980-0444

トピックス(IT)

【記事の利用について】

タイトルと記事文章は、記事のあるページにリンクを張っていただければ、無料で利用できます。

※画像は、利用できませんのでご注意ください。

【リンクついて】

リンクフリーです。