生成AIの普及とセキュリティリスク、組織文化の重要性

生成AIの普及とセキュリティリスク

KnowBe4 Japanは、近年増加している生成AIの導入状況とそのセキュリティリスクに関する意識調査を実施しました。この調査の目的は、企業における生成AIの活用状況や、従業員が感じるリスク、そしてその対策についての実態を把握することです。調査の結果は、生成AIが急速に普及している一方で、情報漏洩や著作権侵害といったセキュリティリスクへの不安が広がっていることを明らかにしました。

生成AIの利用状況

調査によれば、62%の企業がすでに自社で生成AIを導入しており、73%が今後の利用拡大を見込んでいると回答しています。特に、1000人以上の大規模組織では、80%が生成AIを使用している一方、中小規模の組織ではその割合が46%に留まるなど、小規模組織に対する利用拡大の余地があることが分かります。

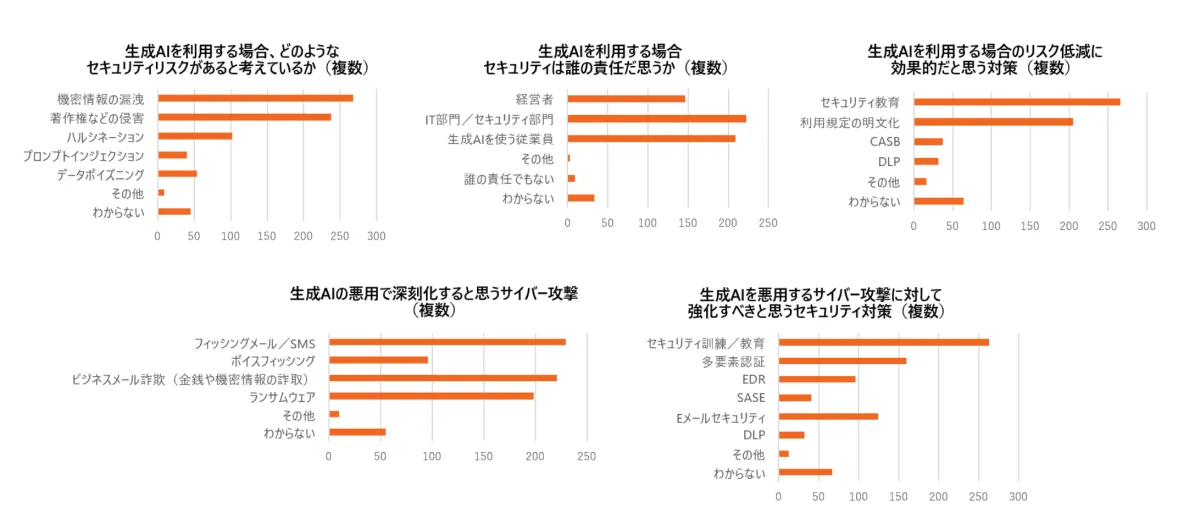

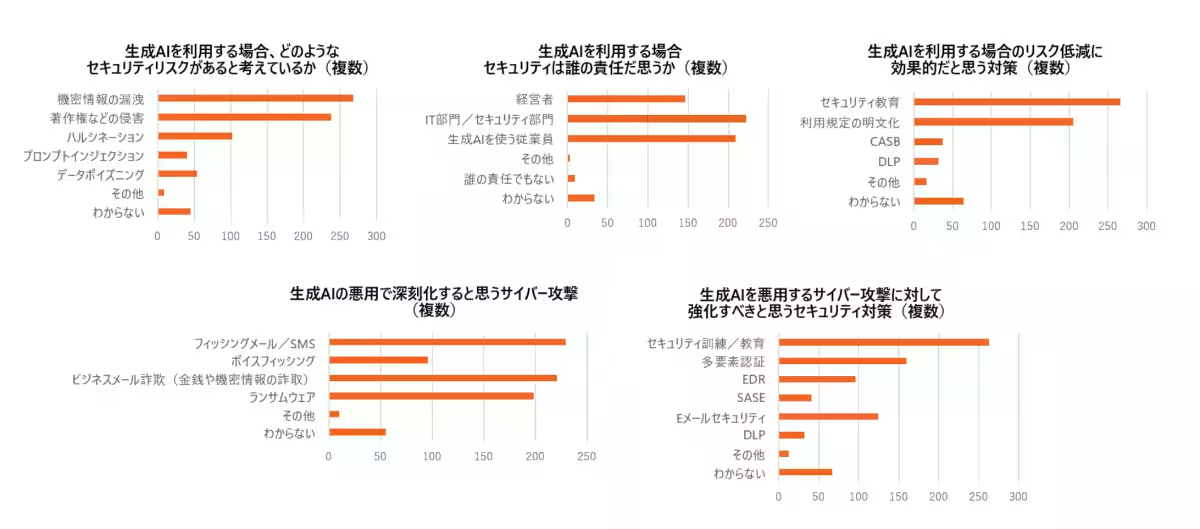

セキュリティリスクへの懸念

この調査では、70%が生成AIに対して何らかのセキュリティリスクを感じており、特に「機密情報の漏洩」や「著作権侵害」といったヒューマンエラーが主な懸念事項として挙げられました。しかし、生成AIを利用する際にリスクを理解していると回答した従業員はわずか32%であり、認識と実態のギャップが浮き彫りになっています。大規模組織では41%がリスクを理解していると答える一方、小規模組織では24%にとどまており、この意識の差が組織全体での取り組みの必要性を示しています。

セキュリティの責任

自己のセキュリティ責任を問う設問において、1,000人以上の大企業では「組織全体の責任」と考えられる傾向が強いですが、逆に小規模企業では「経営者が責任を負うべき」と捉える場合が多いという結果も出ました。異なる役職においては、経営者や役員は経営サイドに責任があるとし、一方で部長以下の一般社員は自分自身やIT部門に責任があると考える傾向が見受けられました。

AIの悪用への脅威

生成AIを用いたサイバー攻撃について、74%が「脅威」を感じているとの回答があり、「フィッシング」や「ビジネスメール詐欺」などのソーシャルエンジニアリング攻撃の高度化が特に懸念されています。

対策の強化

多くの業種において、セキュリティに関する「訓練や教育」を強化すべきだとの見解が示されており、技術的な面だけでなく「人」を中心に据えたアプローチが求められていることが分かります。教育の強化や報告しやすい環境づくりを行うことが、今後のセキュリティ対策の鍵となります。

調査結果の考察

この調査を通じて、生成AIが企業活動に欠かせない存在となりつつある中で、そのセキュリティリスクへの対応が十分でないことが浮き彫りになりました。「ヒューマンエラー」に起因するリスクへの認識はありますが、組織としての取り組みが遅れているのが実情です。生成AIの普及に伴い、今後ますますヒューマンリスクへの対応が重要な課題となるでしょう。

知識と理解に基づく教育や責任感を育むマネジメントが求められています。KnowBe4は今後も、ヒューマンリスクマネジメントの側面から組織のセキュリティ文化を醸成するための支援をしていく方針です。

調査概要

- - 調査名:セキュリティへの影響に関する意識調査

- - 調査期間:2025年1月21日〜3月17日

- - 対象:日本国内の企業、団体で働く従業員(回答数:364名)

- - 方法:日経クロステック Activeリサーチによるオンライン調査

KnowBe4について

KnowBe4は、従業員がより健全なセキュリティ判断ができるよう支援する企業です。世界中で70,000以上のお客様に支持され、セキュリティ文化を強化するための支援を行っています。ヒューマンリスクマネジメントに特化したプラットフォームを提供し、人的要因を起点にセキュリティを強化する取り組みを進めています。

会社情報

- 会社名

- KnowBe4 Japan 合同会社

- 住所

- 東京都港区赤坂9-7-1ミッドタウン・タワー 18F

- 電話番号

トピックス(IT)

【記事の利用について】

タイトルと記事文章は、記事のあるページにリンクを張っていただければ、無料で利用できます。

※画像は、利用できませんのでご注意ください。

【リンクついて】

リンクフリーです。