AIガバナンス協会が提言、制度設計に向けた意見書を発表しました

AIガバナンス協会が示す、AIに関する新しい制度設計の方向性

2024年10月3日、AIガバナンス協会(AIGA)は、AIリスクへの制度上の対応を議論するための意見書を公表しました。これは、政府の「AI事業者ガイドライン(第1.0版)」の提示を受けつつ、会員からの意見を集約したものです。AIGAは、AIに関する自主的な取り組みを支援し、ガバナンス体制を構築することを目的としています。

AIGAの基本姿勢

AIGAは、AI制度研究会の設置に伴い、法制度の必要性からAIの活用に伴うリスクを正しく理解し、適切な対策を講じる必要があると訴えています。AIには特有のリスクがあり、開発、提供、利用といった各層での対策は不可欠です。特に同研究会は、今後発表される中間取りまとめにおいて、AIに関する制度設計のあり方を示す予定です。

公表された意見書のポイント

公表された意見書では、次の3つの基本方針が示されました:

1. 技術中立性 - AIに課せられる規制は、人による侵害と同じく扱うべきだが、過剰な規制は避けるべきであるとしています。

2. リスクベースアプローチ - AIの利用にはさまざまなリスクが存在し、それぞれのユースケースに応じた慎重な検討が必要であると提言しています。

3. 国際的なイコールフッティング - 日本企業がグローバルに競争するため、海外の制度との整合性が求められ、そのための政策づくりが必要であるとしています。

これらの基本方針に沿った方向性として、基盤モデルのリスク管理や、学習データの透明性確保、さらにAIのビジネス活用を促進する方策が考えられています。

意見書の背景と関与したプロセス

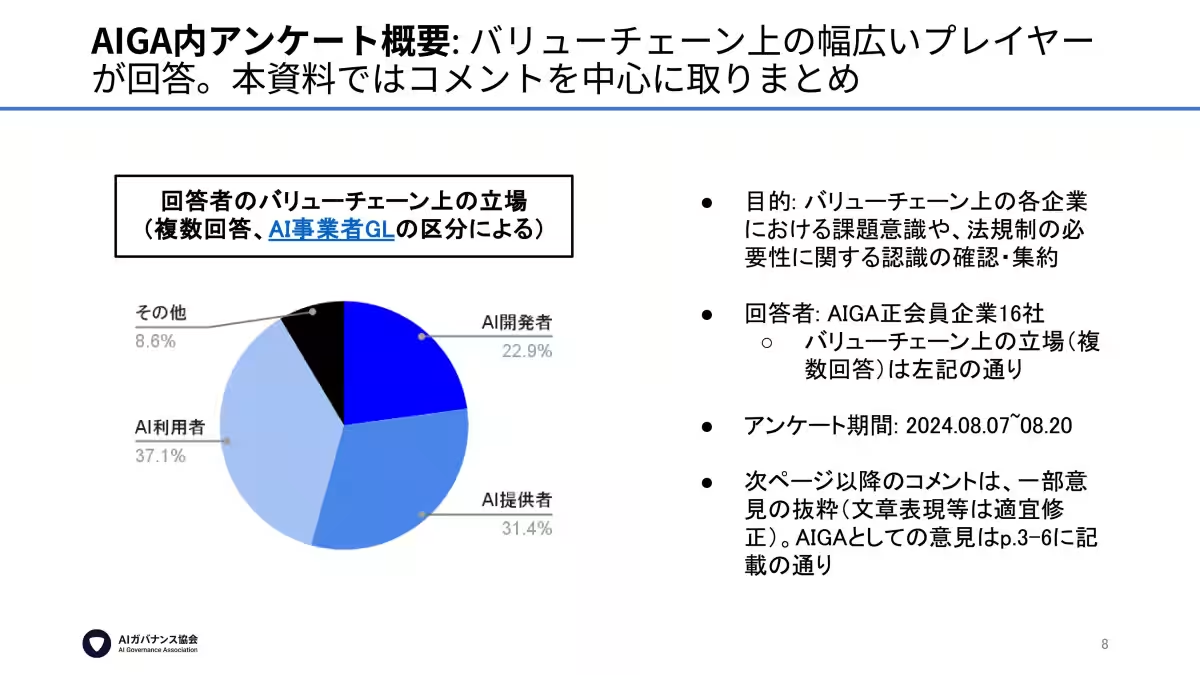

AIGAは、AIガバナンスに関する意見を集めるため、8月に会員アンケートを実施し、その結果を踏まえて意見書を取りまとめました。特に、ハードロー導入の是非や、既存法が対処するには難しいAIリスク領域についての意見が寄せられ、多様な観点からの意見が集まっています。

また、AIGA内での意見検討会では、約50名の会員が参加し、新規法規制の必要性やリスク判断の原則について意見を交わしました。このようなプロセスを経て、AIGAはAIに関する新たなガバナンスのしきたりを構築するための基盤を整えています。

AIガバナンス協会の役割

AIGAは、企業と社会が安全にAIを活用し、持続可能な成長をするための場を提供しています。70社以上の多様な業界からの参加があり、産業横断的なディスカッションが進められています。この活動を通じて、AIGAは企業のAIガバナンスに関する共通理解を促進し、政策提言を行っていく考えです。

この意見書は、AI制度研究会を中心とした今後の議論の深化に寄与するものであり、他関係者の見解にも影響を与えることが期待されています。

参考資料

意見書の全文は【こちら】で確認できます。

AIガバナンスに関する意見書

今後のAI制度研究会の進展から目が離せません。

会社情報

- 会社名

- AIガバナンス協会

- 住所

- 電話番号

トピックス(IT)

【記事の利用について】

タイトルと記事文章は、記事のあるページにリンクを張っていただければ、無料で利用できます。

※画像は、利用できませんのでご注意ください。

【リンクついて】

リンクフリーです。