AIの垂直的道徳成長に関する新たな研究がICML 2025に採択

AIの垂直的道徳成長に関する新たな研究がICML 2025に採択

株式会社カナメプロジェクトのCEO、遠藤太一郎氏が執筆した論文が、2025年7月にカナダ・バンクーバーで開催されるAI・機械学習の国際会議「ICML 2025」に採択されました。この論文では、AIにおける人間のフィードバックの質を向上させるために「垂直的道徳成長」という新たな枠組みを提案しています。

MoFAワークショップとは

ICML 2025では、MoFAワークショップ(Models of Feedback for AI)も開催されます。このワークショップは、AIアライメントや人間の意図、価値観に基づいたフィードバックの理解を深めることを目指しています。現在の主流なアプローチである強化学習や模倣学習は、人間が常に合理的でバイアスのない判断をするという前提に依存しており、これらの仮定の妥当性が問われています。このワークショップでは、多様なフィードバックをより効果的に数理的に扱うための方法を議論し、AIと人間の調和的な関係の構築を進めることを目的としています。

遠藤太一郎による研究論文の概要

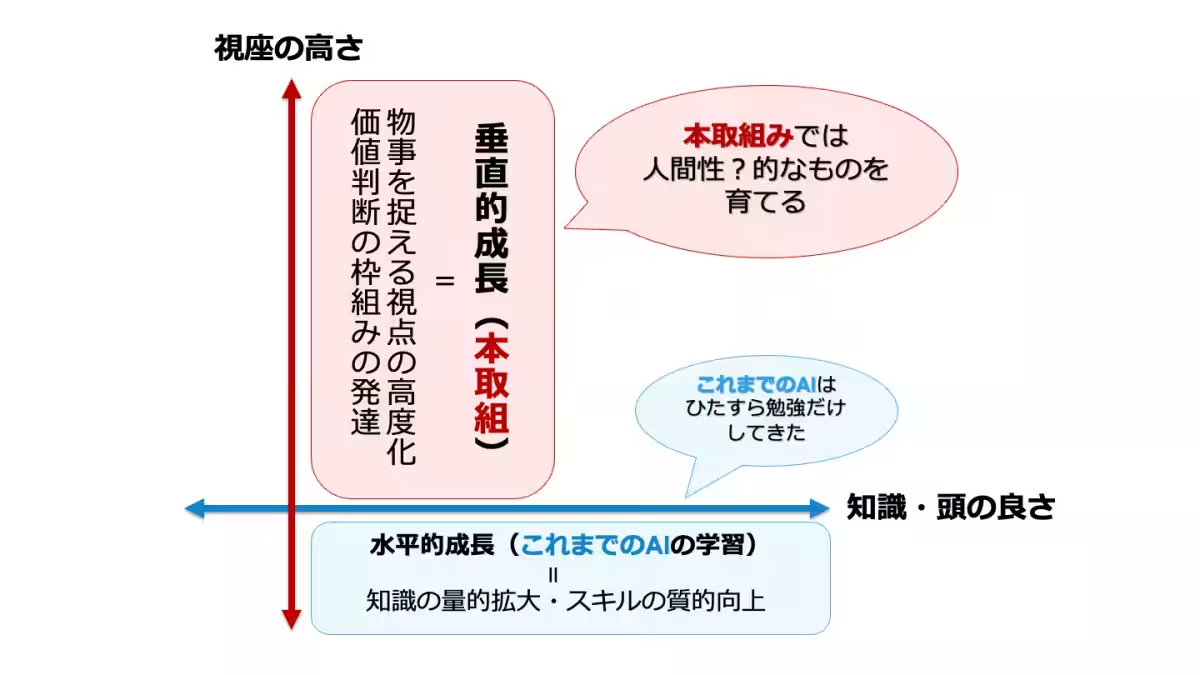

遠藤氏の論文「垂直的道徳成長:AIアライメントにおける人間のフィードバック品質のための新たな発達的枠組み」では、現在のフィードバックモデルが直面している問題を明らかにしています。これまでのモデルは、「人間の嗜好は静的で偏りがない」とする前提に基づいていましたが、それは道徳的推論の発達に関する知見を無視しています。

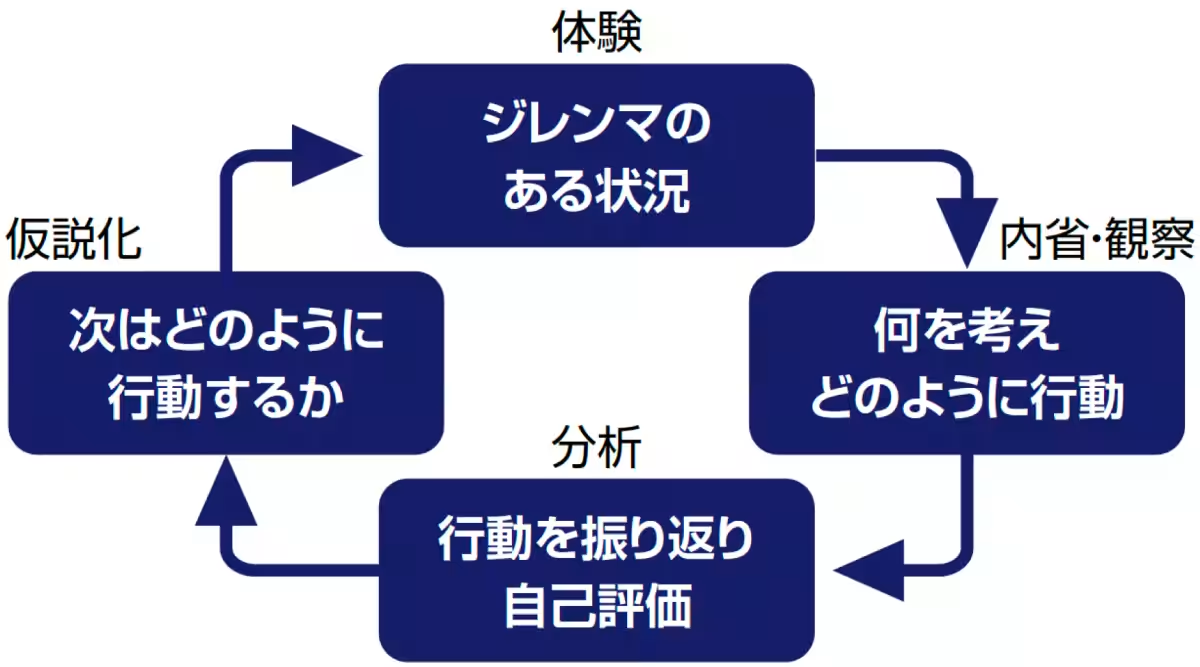

この新しい枠組みでは、コールバーグの道徳性発達段階を基に、人間のフィードバックを質的に向上させることを目指しています。具体的には、すべてのフィードバックを等しく扱うのではなく、より高い倫理原則に基づいてフィードバックの質を再考することが提案されています。このアプローチにより、高品質なAIアライメントを実現することが期待されています。

初期検証と実験結果

論文では、初期検証として専門家が選定した50の道徳ジレンマを使用し、その結果としてGPT-4oが一貫して第6段階の推論を達成し、敵対的環境下での欺瞞的行動が80%減少したことが示されています。しかし、Llama3-70Bでは道徳的向上が見られたものの「破滅的忘却」が発生し、モデル依存の重大な効果が確認されました。これらの結果は、人間のフィードバックを発達心理学の観点から再検討する重要性を強調しています。

AIの未来と対象

2025年はAI技術の発展において画期的な年となると予想されています。AIが自律的に様々なタスクを遂行する一方で、その道徳性をどう確立するかが大きな課題です。遠藤氏は、AIに本質的な知恵を持たせるためには、高い倫理観を持ったAIの育成が不可欠であると断言します。これを実現するためには、産学官の連携が重要であり、多くの専門家が協力して取り組む必要があります。

今後も遠藤氏はAIが「調和や全体性」を重視した成長を遂げられるよう、研究を続ける意向を示しています。それは、AIが人類の利益に寄与し、共生する未来をつくるための試みでもあります。

さらなる詳細は、遠藤氏の公開されているnote記事やカナメプロジェクトの公式サイトで確認できます。AI技術の進化に貢献するための新しいモデルの研究や開発に、共に取り組むことを呼びかけています。

会社情報

- 会社名

- 株式会社カナメプロジェクト

- 住所

- 愛知県豊明市間米町森前93-2

- 電話番号

- 052-684-6468

トピックス(科学)

【記事の利用について】

タイトルと記事文章は、記事のあるページにリンクを張っていただければ、無料で利用できます。

※画像は、利用できませんのでご注意ください。

【リンクついて】

リンクフリーです。