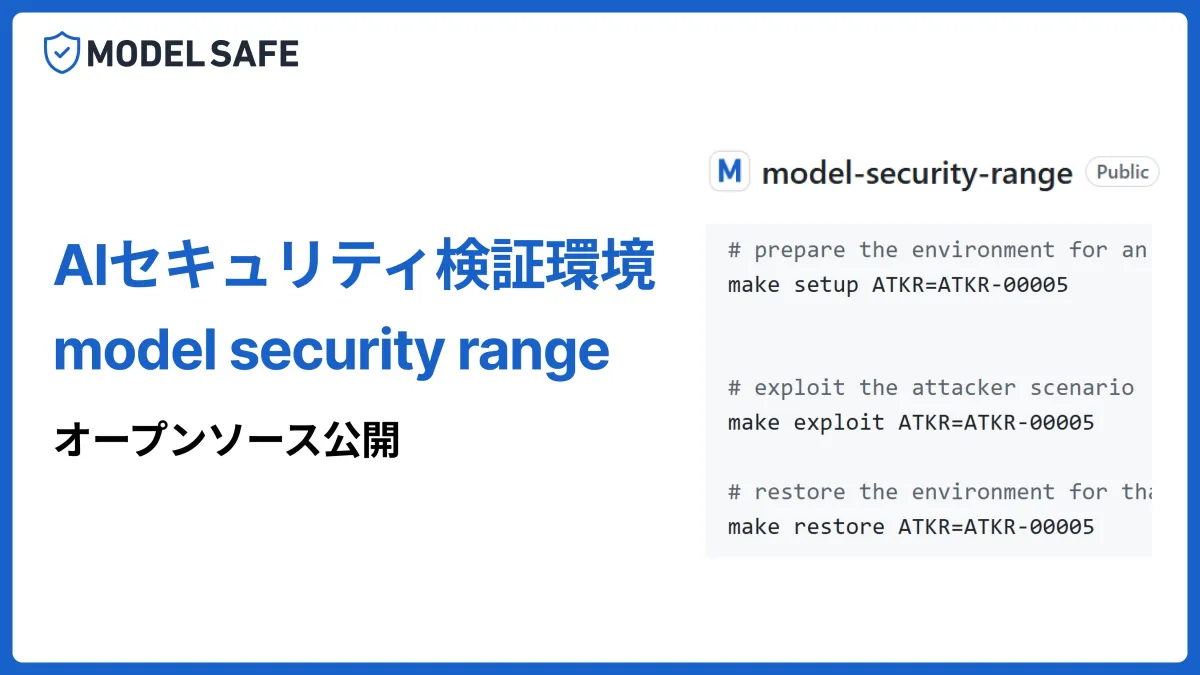

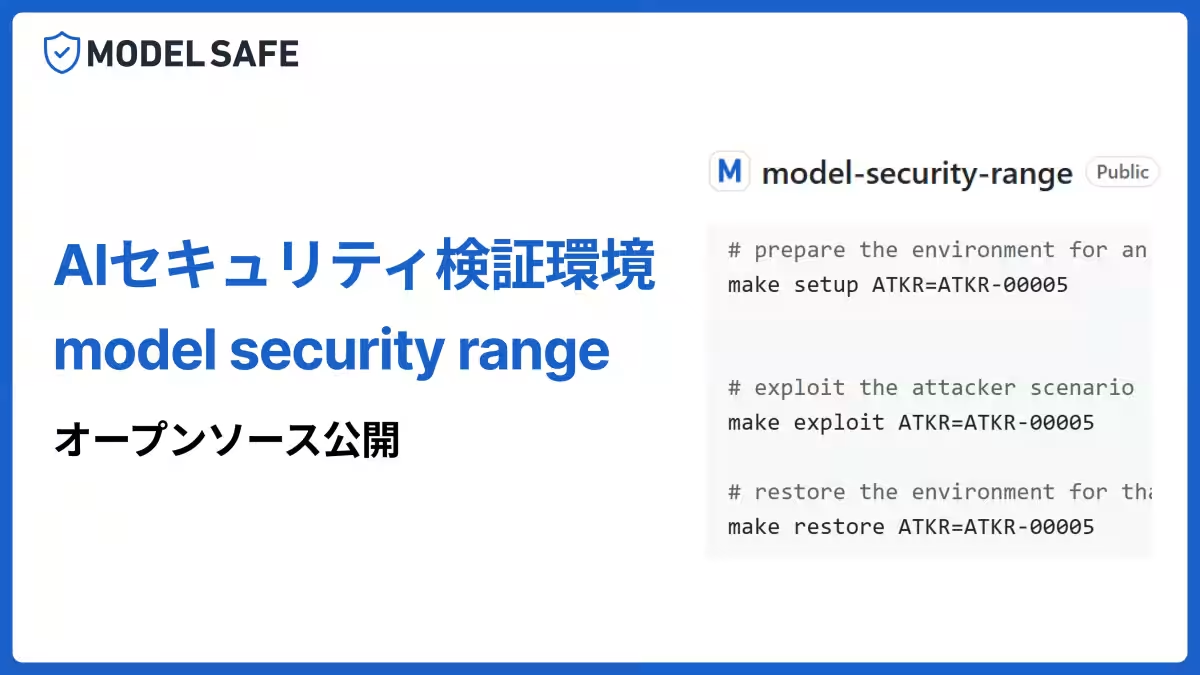

AIセキュリティ検証環境「Model Security Range」のオープンソース公開

AIセキュリティ検証環境「Model Security Range」の魅力

近年、生成AIの利用が進む中で、そのセキュリティ問題も重要視されています。株式会社MONO BRAINが公開した「Model Security Range」は、AIアプリケーションに対する実践的なセキュリティ検証環境です。本稿では、この新たなフレームワークの機能と重要性について詳しく解説します。

Model Security Rangeとは?

「Model Security Range」は、意図的に脆弱なAIアプリケーションを利用し、攻撃から評価、復旧までの一連の過程を再現可能な環境を提供します。主な機能にはプロンプトインジェクション、ツール権限悪用、モデル汚染などの攻撃手法が含まれ、実際の業務運用での評価が可能です。このフレームワークは、GitHubで無料公開されています。

公開の背景

AI技術の導入が進む中、従来のWebセキュリティ対策だけでは、AI特有の脅威に対抗しきれない現実があります。たとえば、内部情報の漏洩や過剰権限を持つツールの悪用といったリスクが増加しています。これに対処するため、専門家たちは「モデルセキュリティ」を確立しなければなりませんが、現状では攻撃の再現が難しいという課題が存在しています。「Model Security Range」は、誰でも同じ条件で検証できる環境を提供し、AIセキュリティのハードルを下げる役割を果たします。

機能の詳細

このフレームワークは、様々な攻撃シナリオを通じてAIの脆弱性を洗い出すことを目的としています。

- - 実行可能なAI脆弱性シナリオ:攻撃コードとアプリ本体がセットで公開され、誰でも実行できる。

- - 高い再現性:標準化された手順により、攻撃実行から復旧までを一貫して行える。

- - 横断的評価:RAGやOCRといった多様なAIモデルを評価対象に、「Model Security Range」は柔軟に対応します。

また、本フレームワークは、生成AIのプロダクト開発者やAIセキュリティ評価を進める専門家にとって、理想的な検証基盤となります。

実際の利用場面

「Model Security Range」は、以下のようなシチュエーションで活用可能です。

- - リリース前の社内AIアプリケーションのセキュリティ検証。

- - レッドチームとブルーチームの合同演習。

- - 開発者教育や研究用の攻撃再現。

- - 対策実装後の確認作業。

誰にとって必要か

このフレームワークは、生成AIを開発・運用しているエンジニア、AIのセキュリティ評価基準を整理したいセキュリティ担当者、AIリスクの研究を進める学生や研究者に特に適しています。さらに、AIガバナンスや監査に関わる実務担当者にも役立つでしょう。

利用にあたっての注意点

本プロジェクトは教育や検証を目的として公開されていますが、攻撃シナリオには意図的な脆弱性が含まれていますので、使用する際には適用法令や組織のポリシーを遵守することが求められます。特に、本番環境や許可のない対象に対する攻撃行為は禁止されています。

未来のAIセキュリティに向けて

「Model Security Range」は、AI開発・運用の安全性を確保し、実務的なセキュリティ対策を強化する重要なツールです。新しい技術が進化する速度に追いつくために、ぜひ本プロジェクトを活用してみてください。

さらに、「MODEL SAFE」というAIセキュリティプラットフォームもあり、AIの運用やリスク管理を総合的に支援しています。詳しくは公式サイトをご覧ください。商業組織や研究機関の皆様からのご問い合わせをお待ちしております。

会社情報

- 会社名

- 株式会社MONO BRAIN

- 住所

- 東京都渋谷区道玄坂1丁目10番8号渋谷道玄坂東急ビル2F−C

- 電話番号

関連リンク

サードペディア百科事典: 東京都 渋谷区 AIセキュリティ MONO BRAIN Model Security Range

Wiki3: 東京都 渋谷区 AIセキュリティ MONO BRAIN Model Security Range

トピックス(IT)

【記事の利用について】

タイトルと記事文章は、記事のあるページにリンクを張っていただければ、無料で利用できます。

※画像は、利用できませんのでご注意ください。

【リンクついて】

リンクフリーです。